Erhalte unsere neuesten Artikel und Updates bequem per E-Mail

OpenAI hat GPT-5.4 veröffentlicht – ein Modell, das Reasoning, Coding und erstmals native Computersteuerung in einem einzigen System vereint. Für Unternehmen ist primär relevant: GPT-5.4 erstellt Spreadsheets, Präsentationen und Dokumente auf einem Niveau, das laut OpenAIs eigenen Tests in 83 % der Fälle mit menschlichen Fachkräften mithält oder sie übertrifft. Gleichzeitig launcht OpenAI ChatGPT für Excel und Google Sheets. Der Launch kommt zu einem heiklen Zeitpunkt – mitten im Reputationsschaden durch den Pentagon-Deal.

GPT-5.4 existiert in drei Varianten. GPT-5.4 Thinking ist ab sofort für alle zahlenden ChatGPT-Nutzer verfügbar (Plus, Team, Pro). GPT-5.4 Pro – die leistungsstärkste Version – ist auf ChatGPT Pro (200 USD/Monat) und Enterprise-Kunden beschränkt. Über die API ist das Modell mit einem Kontextfenster von bis zu 1 Million Tokens nutzbar.

Die zentrale technische Neuerung: GPT-5.4 ist das erste allgemeine OpenAI-Modell mit nativer Computer-Use-Fähigkeit. Es kann Desktop-Umgebungen über Screenshots erfassen, Maus und Tastatur steuern und eigenständig mehrstufige Arbeitsabläufe über verschiedene Anwendungen hinweg ausführen. Auf dem OSWorld-Verified-Benchmark erreicht GPT-5.4 eine Erfolgsrate von 75 % – und übertrifft damit sowohl die menschliche Referenz (72,4 %) als auch Anthropics Claude Opus 4.6 (72,7 %), wie heise.de in einem detaillierten Vergleich zeigt.

Für Entwickler besonders relevant: Das neue Tool-Search-System lädt Werkzeug-Definitionen erst bei Bedarf, statt sie komplett in den Prompt zu packen. Laut OpenAI reduziert das den Token-Verbrauch um bis zu 47 % bei gleichbleibender Genauigkeit. In Umgebungen mit vielen API-Integrationen – etwa bei MCP-Servern – ist das ein erheblicher Kosteneffekt.

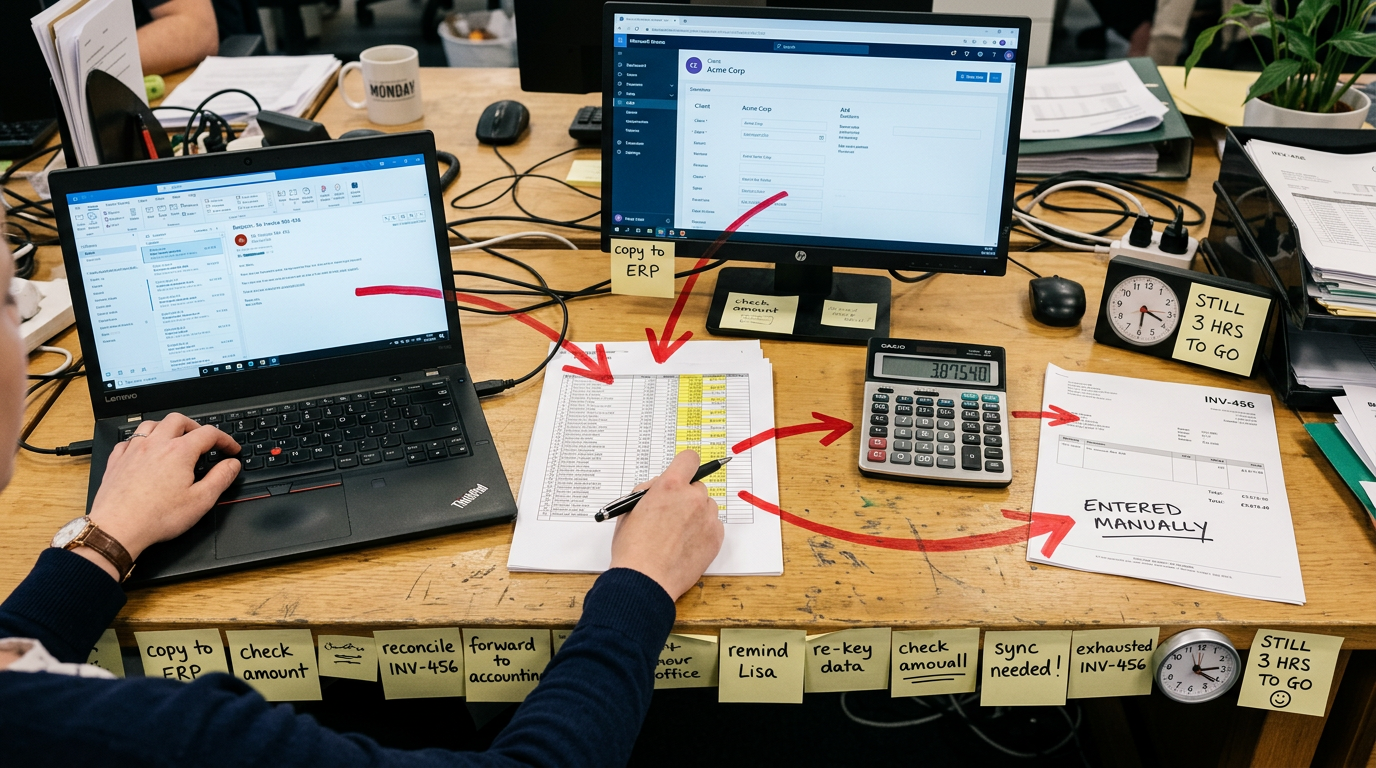

OpenAI positioniert GPT-5.4 nicht als besseren Chatbot, sondern als Arbeitsmaschine für professionelle Aufgaben. Die Zahlen sind beeindruckend: Auf einem internen Benchmark für Spreadsheet-Modellierung – vergleichbar mit Aufgaben eines Junior-Investment-Banking-Analysten – erreicht GPT-5.4 einen Score von 87,3 %, gegenüber 68,4 % bei GPT-5.2. Bei Präsentationen bevorzugten menschliche Bewerter die GPT-5.4-Ergebnisse in 68 % der Fälle aufgrund besserer Ästhetik und Bildgestaltung.

Gleichzeitig startet OpenAI „ChatGPT for Excel“ und eine Google-Sheets-Integration als Beta. Damit lässt sich ChatGPT direkt in Tabellenkalkulationen einbetten, um Finanzmodelle zu erstellen, zu analysieren und zu aktualisieren. Ergänzt wird das durch Integrationen mit FactSet, MSCI, Third Bridge und Moody’s – also den Datenanbietern, die im Finanzsektor Standard sind. Auf einem internen Investment-Banking-Benchmark stieg die Modellleistung von 43,7 % (GPT-5) auf 88 % (GPT-5.4 Thinking).

Für Fortune war dieser Launch ein klares Signal: OpenAI tritt damit in direkte Konkurrenz zu Anthropics „Claude for Financial Services“, das seit Juli 2025 verfügbar ist und zuletzt durch die Cowork-Plug-ins für einen SaaS-Ausverkauf an den Börsen sorgte. Der Wettlauf um Enterprise-Kunden im Finanzsektor verschärft sich.

GPT-5.4 liefert starke Benchmark-Ergebnisse. Aber wie heise.de in einer sorgfältigen Gegenüberstellung zeigt, gibt es keinen eindeutigen Gesamtsieger im Vergleich mit Claude Opus 4.6 und Googles Gemini 3.1 Pro. GPT-5.4 führt bei der Desktop-Steuerung (OSWorld) und bei Knowledge-Work-Aufgaben (GDPval). Claude Opus 4.6 liegt bei der Web-Recherche (BrowseComp: 84 % vs. 82,7 %) und beim Code-Benchmark Terminal-Bench 2.0 vorn. Gemini 3.1 Pro dominiert beim abstrakten Reasoning (ARC-AGI-2) und bietet ein größeres Kontextfenster zu einem niedrigeren Preis.

Auch bei der Faktentreue gibt es Fortschritte, aber keine Perfektion. OpenAI selbst beziffert die Verbesserung: Einzelaussagen sind 33 % seltener falsch, Gesamtantworten enthalten 18 % weniger Fehler als bei GPT-5.2. DataCamp kommt nach eigenen Hands-on-Tests zu dem Schluss, dass GPT-5.4 trotzdem „noch menschliche Aufsicht benötigt“. Das deckt sich mit der Einschätzung von Mercors CEO, der die besten KI-Modelle auf dem APEX-Agents-Benchmark aktuell mit „einem Praktikanten, der in 25 % der Fälle richtig liegt“ vergleicht.

Entscheidend für Unternehmen: Benchmarks messen isolierte Aufgaben unter Laborbedingungen. Ob sich die Verbesserungen im realen Arbeitsablauf genauso auswirken, hängt vom konkreten Einsatzszenario ab. Die Spreadsheet- und Präsentations-Benchmarks sind OpenAI-intern und nicht unabhängig repliziert.

GPT-5.4 kostet über die API 2,50 USD pro Million Input-Tokens und 15 USD pro Million Output-Tokens. Damit liegt es deutlich unter Claude Opus 4.6, das 5 USD und 25 USD berechnet. Ab 272.000 Input-Tokens greift bei OpenAI ein Aufschlag – bei Anthropic bereits ab 200.000. OpenAI argumentiert zusätzlich, dass die höhere Token-Effizienz von GPT-5.4 die Gesamtkosten weiter senkt: Für manche Aufgaben benötigt das Modell bis zu 47 % weniger Tokens als seine Vorgänger.

Für Unternehmen, die aktuell KI-Budgets kalkulieren, ist die Kombination aus Leistung und Kosteneffizienz das stärkste Argument. Allerdings fehlt bisher ein unabhängiger Vergleich der tatsächlichen Kosten pro Aufgabe unter realen Bedingungen – die Token-Effizienz-Werte stammen ausschließlich von OpenAI.

GPT-5.4 wird in einem Moment veröffentlicht, in dem OpenAI unter erheblichem Reputationsdruck steht. Nur Stunden nach der Einstufung von Anthropic als Supply-Chain-Risiko durch das Pentagon hatte OpenAI den freigewordenen Militärvertrag übernommen. Gizmodo berichtet, dass OpenAI infolge der Pentagon-Entscheidung rund 1,5 Millionen Nutzer verloren habe – während Anthropic gleichzeitig über eine Million neue Nutzer pro Tag verzeichnete.

Der GPT-5.4-Launch wirkt wie ein bewusster Versuch, die Aufmerksamkeit von der Kontroverse auf die Produktinnovation zu lenken. Die Geschwindigkeit ist bemerkenswert: GPT-5.3 Instant erschien am Montag, GPT-5.4 am Donnerstag. Zwei signifikante Modell-Releases in einer Woche gab es bei OpenAI noch nie. The Next Web kommentiert, dass die Frage sei, ob diese Geschwindigkeit in nachhaltige Enterprise-Adoption münde – oder einfach den ohnehin schnellen Benchmark-Turnover beschleunige, der es kaum einem Modell erlaube, eine dauerhafte Führungsposition zu halten.

Kurzfristig wird sich zeigen, ob ChatGPT for Excel und die Financial-Services-Integrationen in der Praxis halten, was die Benchmarks versprechen. Für Unternehmen, die bereits mit KI in Finanzprozessen arbeiten, lohnt sich ein direkter Vergleich mit Anthropics Angebot. GPT-5.4 ist günstiger, Claude Opus 4.6 führt bei bestimmten Aufgabentypen. Die Entscheidung ist kein Entweder-oder – Multi-Modell-Strategien werden zunehmend zum Standard.

Mittelfristig stellt sich die Frage, wie Googles Gemini 3.1 Pro reagiert. Das Modell führt beim abstrakten Reasoning und bietet ein kompetitives Preismodell. Ein Update wurde von Analysten bereits für März erwartet. Der Benchmark-Wettbewerb wird sich weiter beschleunigen – was für Unternehmen bedeutet, dass die Wahl des KI-Modells keine einmalige Entscheidung mehr ist, sondern ein laufender Evaluierungsprozess.

Wenn Sie GPT-5.2 oder GPT-5.3 im Einsatz haben: Testen Sie GPT-5.4 in Ihren tatsächlichen Arbeitsabläufen, nicht nur auf Basis der Benchmarks. Die Verbesserungen bei Spreadsheets und Präsentationen sind substanziell und im Enterprise-Kontext sofort nutzbar. Wenn Sie im Finanzbereich arbeiten: Prüfen Sie die ChatGPT-for-Excel-Beta und die Datenintegrationen mit FactSet, MSCI und Moody’s als Alternative oder Ergänzung zu bestehenden KI-Tools. Und unabhängig vom Anbieter: Investieren Sie in eine Multi-Modell-Architektur, die es Ihnen erlaubt, zwischen GPT-5.4, Claude Opus 4.6 und Gemini 3.1 Pro zu wechseln, je nach Aufgabentyp und Kostenprofil.

Sed at tellus, pharetra lacus, aenean risus non nisl ultricies commodo diam aliquet arcu enim eu leo porttitor habitasse adipiscing porttitor varius ultricies facilisis viverra lacus neque.