Erhalte unsere neuesten Artikel und Updates bequem per E-Mail

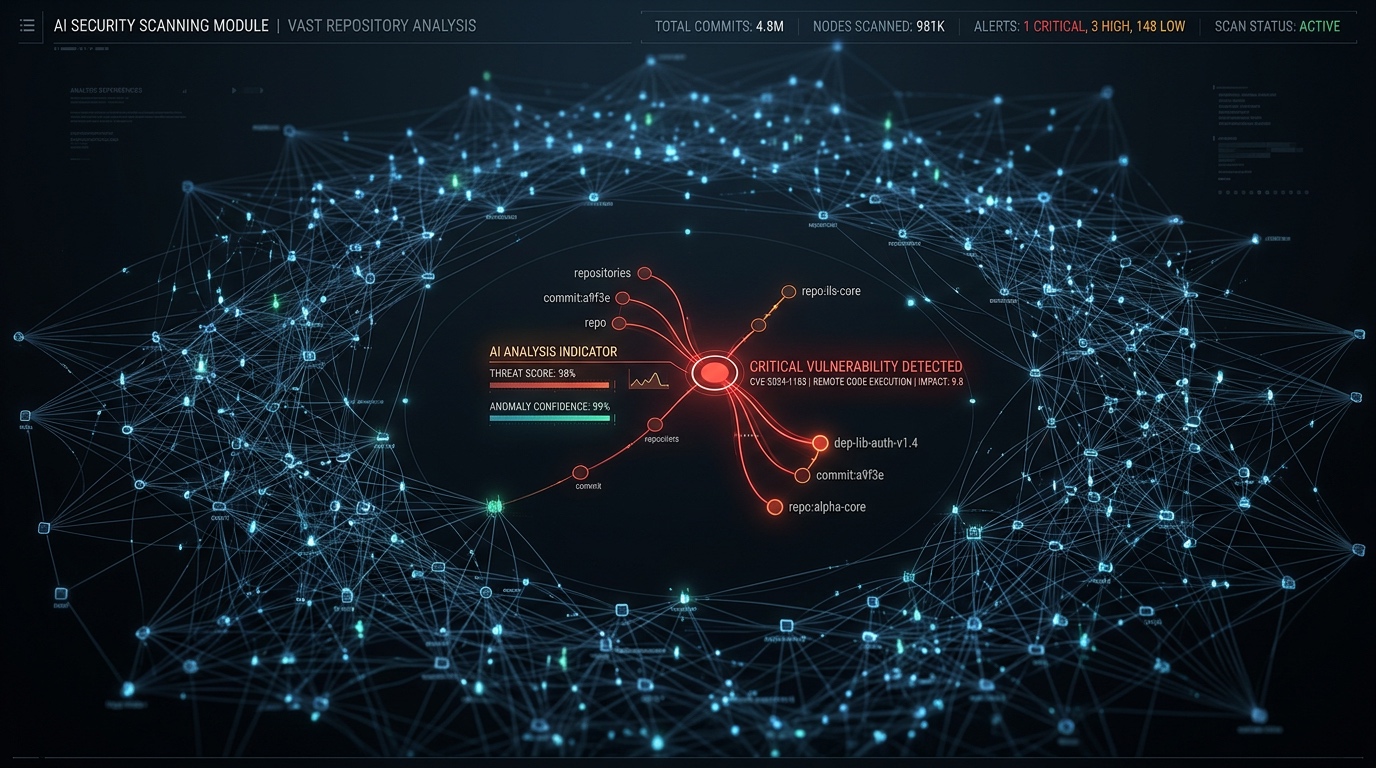

OpenAI bringt mit Codex Security ein neues Beispiel dafür, wie KI-gestützte Sicherheitsprüfung für Software praktisch aussehen kann. Laut The Decoder hat OpenAI den Sicherheitsagenten am 6. März 2026 vorgestellt. Das System soll Schwachstellen in Software-Projekten identifizieren, projektspezifische Bedrohungsmodelle erstellen und gefundene Probleme in isolierten Testumgebungen prüfen. Für Unternehmen ist das keine abstrakte Modell-Demo, sondern ein klar umrissener Use Case im Secure-Development-Workflow.

Die wichtigsten Zahlen aus der Betaphase sind bemerkenswert. Wie The Decoder berichtet, konnte Codex Security Fehlalarme um über 50 Prozent und überflüssige Meldungen um 84 Prozent reduzieren. Genau an diesem Punkt scheitern viele klassische Security-Tools im Alltag. Sie finden zwar viel, erzeugen aber so viel Rauschen, dass Teams Warnungen ignorieren oder Security-Backlogs wachsen lassen.

Noch relevanter ist die operative Größenordnung. Laut The Decoder wurden in den letzten 30 Tagen mehr als 1,2 Millionen Commits gescannt und 792 kritische Schwachstellen identifiziert. OpenAI hat außerdem Sicherheitslücken in Open-Source-Projekten wie OpenSSH, GnuTLS, GOGS, Thorium und Chromium gemeldet. Bisher wurden laut The Decoder 14 CVEs vergeben. Das ist der Punkt, an dem aus einem interessanten Tool ein belastbarer Praxisbeleg wird.

Für Entscheider ist die Kernaussage einfach. KI in der Software-Sicherheit ist dann wertvoll, wenn sie nicht nur mehr Findings produziert, sondern bessere Priorisierung, weniger Fehlalarme und schnellere Verifikation liefert. Genau diese drei Punkte adressiert Codex Security laut The Decoder. Der Nutzen liegt also nicht nur in der Erkennung, sondern in der Entlastung des Teams und in einer besseren Entscheidungsqualität.

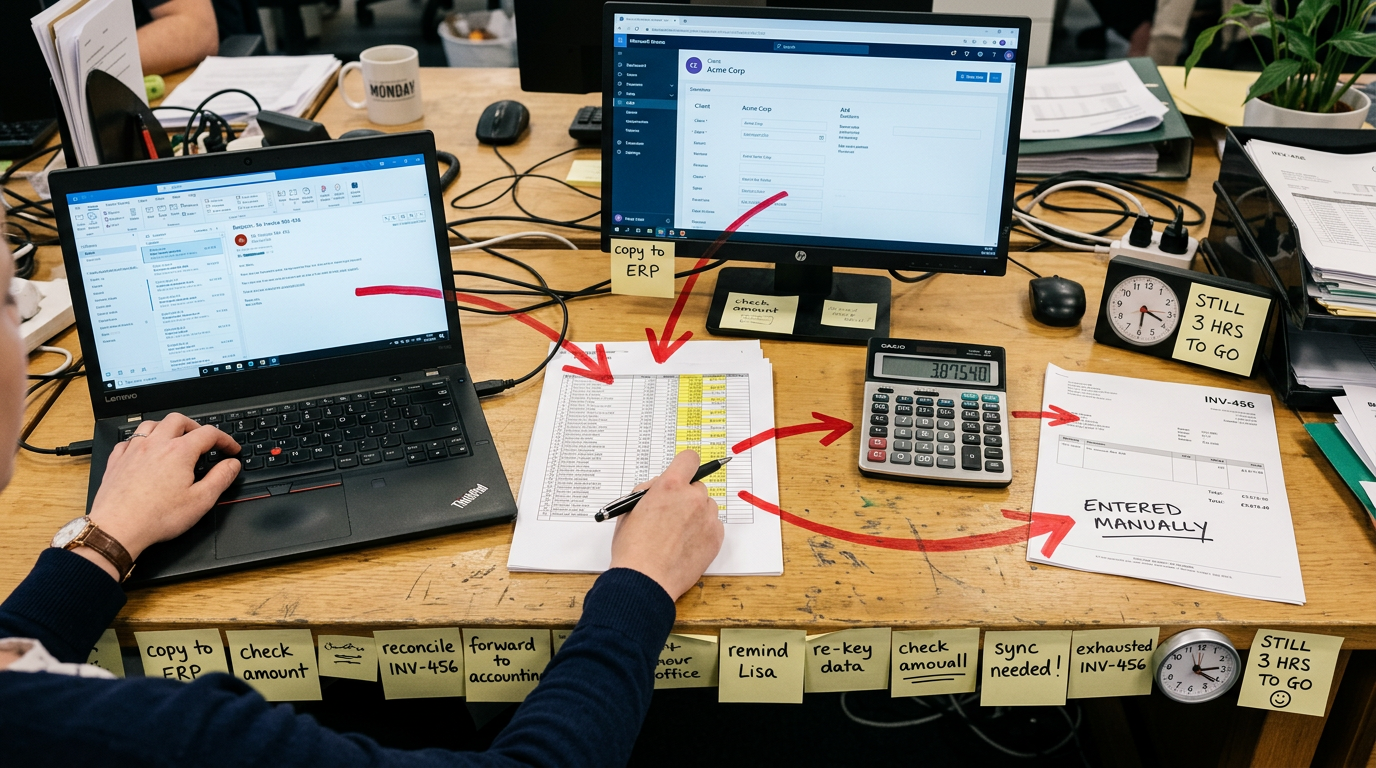

Die meisten Unternehmen haben heute kein grundsätzliches Erkenntnisproblem bei Software-Sicherheit. Sie haben ein Umsetzungsproblem. In vielen Entwicklungsorganisationen laufen bereits SAST-, DAST-, Dependency- und Container-Scans. Trotzdem bleiben kritische Lücken oft zu lange offen, weil die Zahl der Meldungen hoch ist, die Priorisierung unscharf bleibt und Entwickler nicht sicher wissen, welche Findings wirklich ausnutzbar sind.

Genau hier setzt die Idee eines KI-gestützten Sicherheitsagenten an. Statt nur statische Regeln auf Code anzuwenden, soll das System laut The Decoder ganze Code-Repositories analysieren, ein projektspezifisches Bedrohungsmodell aufbauen und potenzielle Schwachstellen in isolierten Testumgebungen prüfen. Das ist ein anderer Ansatz als reine Pattern-Erkennung. Er verbindet Kontextverständnis, Hypothesenbildung und Verifikation in einem Workflow.

Für Unternehmen mit mehreren Produktteams ist das besonders relevant. Je größer die Codebasis, desto stärker steigen die Kosten für manuelle Triage. Security Engineers verbringen dann einen erheblichen Teil ihrer Zeit nicht mit echter Risikoreduktion, sondern mit Sortieren, Rückfragen und Abstimmung. Wenn ein System diese Vorarbeit sauber übernimmt, verschiebt sich der Engpass von der Erkennung zur Behebung. Das ist ein deutlich produktiveres Problem.

Hinzu kommt ein organisatorischer Aspekt. In vielen Firmen arbeiten Security und Entwicklung noch immer in getrennten Takten. Security meldet, Entwicklung priorisiert später, und dazwischen gehen Kontext und Dringlichkeit verloren. Ein Tool wie Codex Security ist deshalb nicht nur ein Scanner. Es ist potenziell ein Bindeglied zwischen Code, Risiko und konkreter Handlungsempfehlung.

Klassische Security-Tools scheitern selten an fehlender technischer Kompetenz. Sie scheitern an ihrer Einbettung in reale Entwicklungsprozesse. Wenn ein Tool hunderte Findings pro Sprint erzeugt, aber nur ein kleiner Teil davon relevant ist, entsteht Frust. Entwickler lernen schnell, dass viele Warnungen keine echte Priorität haben. Security verliert damit Glaubwürdigkeit im Tagesgeschäft.

Der zweite Schwachpunkt ist fehlender Projektkontext. Ein generischer Scanner erkennt möglicherweise ein riskantes Muster, versteht aber nicht, ob der betroffene Code tatsächlich erreichbar ist, welche Schutzmechanismen im Projekt bereits existieren oder wie ein realistischer Angriffsweg aussieht. Laut The Decoder erstellt Codex Security projektspezifische Bedrohungsmodelle. Genau das adressiert diese Lücke. Die Qualität eines Findings steigt, wenn das System nicht nur den Code, sondern auch die Architektur und den Nutzungskontext berücksichtigt.

Der dritte Punkt ist die fehlende Verifikation. Viele Security-Teams kennen das Problem: Ein Tool markiert eine potenzielle Schwachstelle, aber niemand weiß sofort, ob sie praktisch ausnutzbar ist. Dann beginnt manuelle Analyse. Laut The Decoder prüft Codex Security gefundene Schwachstellen in isolierten Testumgebungen. Das ist operativ wichtig, weil es die Distanz zwischen Verdacht und belastbarer Einschätzung verkürzt.

Die Zahlen aus der Betaphase unterstreichen genau diesen Nutzen. The Decoder berichtet von über 50 Prozent weniger Fehlalarmen und 84 Prozent weniger überflüssigen Meldungen. Diese Werte sind nicht nur technische Benchmarks. Sie sind ein Hinweis darauf, dass der eigentliche Mehrwert in der Signalqualität liegt. Für Unternehmen bedeutet das weniger Reibung zwischen Security und Entwicklung.

Codex Security ist laut The Decoder ein KI-gestützter Sicherheitsagent, der früher unter dem Namen Aardvark bekannt war. OpenAI positioniert das System derzeit als Forschungsvorschau für ChatGPT-Enterprise-, Business- und Edu-Kunden. Im ersten Monat ist das Angebot laut The Decoder kostenlos verfügbar. Das senkt die Hürde für erste Tests deutlich, vor allem in Organisationen, die bereits mit ChatGPT im Unternehmenskontext arbeiten.

Technisch interessant ist die Kombination aus Repository-Analyse, Bedrohungsmodellierung und isolierter Prüfung. Diese drei Bausteine sind zusammen stärker als jeder einzelne für sich. Ein reiner Code-Scan liefert Hinweise. Ein Bedrohungsmodell liefert Priorität. Eine isolierte Testumgebung liefert Verifikation. Erst diese Kette macht aus einer Vermutung eine belastbare Arbeitsgrundlage für Security- und Entwicklungsteams.

Dass OpenAI bereits konkrete Schwachstellen in Open-Source-Projekten wie OpenSSH, GnuTLS, GOGS, Thorium und Chromium gemeldet hat, ist laut The Decoder ein wichtiger Vertrauensindikator. Noch wichtiger ist die Zahl der vergebenen CVEs. The Decoder nennt hier 14 CVEs. Das zeigt, dass das System nicht nur intern plausible Ergebnisse erzeugt, sondern Findings hervorbringt, die in etablierten Sicherheitsprozessen anerkannt werden.

Für Unternehmen ist das die eigentliche Relevanz. Sie müssen nicht bewerten, ob das Modell beeindruckend klingt. Sie müssen bewerten, ob es im eigenen Workflow bessere Entscheidungen ermöglicht. Wenn ein Tool kritische Schwachstellen mit weniger Rauschen identifiziert und diese schneller verifizierbar macht, dann verbessert es Time-to-Remediation, Teamfokus und Risikosteuerung zugleich.

Der erste Schritt ist nicht die breite Einführung, sondern eine saubere Auswahl des Pilotbereichs. Unternehmen sollten mit einem Repository starten, das drei Eigenschaften mitbringt: geschäftliche Relevanz, aktive Entwicklung und ein bereits bekanntes Security-Aufkommen. Ein totes Nebenprojekt eignet sich nicht. Ein geschäftskritisches Kernsystem mit chaotischer Governance ist für den Anfang ebenfalls riskant. Ziel ist ein Bereich, in dem Ergebnisse schnell sichtbar und organisatorisch handhabbar sind.

Im zweiten Schritt braucht es eine klare Baseline. Bevor ein Team Codex Security testet, sollte es dokumentieren, wie viele Findings bestehende Tools erzeugen, wie hoch der manuelle Triage-Aufwand ist und wie lange kritische Schwachstellen im Schnitt bis zur Behebung offen bleiben. Ohne diese Ausgangswerte bleibt jede Bewertung subjektiv. Die Zahlen aus der Betaphase von OpenAI sind ein guter Referenzpunkt, ersetzen aber keine eigene Messung im Unternehmenskontext.

Der dritte Schritt ist die technische und organisatorische Einbindung. Laut The Decoder analysiert Codex Security Code-Repositories und prüft Schwachstellen in isolierten Testumgebungen. Daraus folgt direkt, dass Unternehmen Zugriffsrechte, Testumgebungen und Freigabeprozesse sauber definieren müssen. Wer diese Grundlagen nicht vorbereitet, erzeugt neue Risiken. Gerade bei sicherheitskritischem Code braucht es klare Regeln, welche Repositories angebunden werden dürfen und wie Ergebnisse intern verarbeitet werden.

Im vierten Schritt sollte das Team den Output nicht sofort automatisiert in Tickets umwandeln. Sinnvoller ist zunächst ein moderierter Review-Prozess mit Security Lead, verantwortlichem Entwickler und gegebenenfalls einem Product Owner. So lässt sich schnell erkennen, ob die Findings tatsächlich relevant sind, wie gut die Priorisierung funktioniert und wo das System noch falsch liegt. Erst wenn diese Qualität stimmt, lohnt sich eine stärkere Automatisierung in Richtung Ticketing oder Pull-Request-Workflows.

Der fünfte Schritt ist die Integration in bestehende Security-KPIs. Ein Pilot ist nur dann belastbar, wenn er auf Management-Ebene auswertbar wird. Dazu gehören Kennzahlen wie kritische Findings pro 1.000 Commits, Anteil verifizierter Findings, durchschnittliche Zeit bis zur Triage und durchschnittliche Zeit bis zur Behebung. The Decoder berichtet, dass in den letzten 30 Tagen über 1,2 Millionen Commits gescannt wurden und 792 kritische Schwachstellen identifiziert wurden. Diese Größenordnung zeigt, dass Commit-basierte Auswertungen sinnvoll sind.

Der sechste Schritt ist die Governance für den produktiven Einsatz. Ein KI-Sicherheitsagent darf nicht als Black Box in die Entwicklungsorganisation gestellt werden. Unternehmen sollten festlegen, wer Findings freigibt, wie mit potenziell sensiblen Codebereichen umgegangen wird und welche Eskalationswege bei kritischen Funden gelten. Gerade wenn ein System reale Schwachstellen in produktionsnahen Komponenten erkennt, braucht es klare Verantwortlichkeiten. Sonst steigt zwar die Transparenz, aber nicht die Handlungsfähigkeit.

Die erste Lehre ist, dass KI-gestützte Sicherheitsprüfung für Software kein Ersatz für Security-Teams ist. Der Wert entsteht nicht dadurch, dass Menschen aus dem Prozess verschwinden. Der Wert entsteht dadurch, dass Menschen weniger Zeit mit irrelevanten Meldungen verbringen. Die von The Decoder genannten Reduktionen bei Fehlalarmen und überflüssigen Meldungen zeigen genau diesen Effekt. Gute KI in Security ist ein Multiplikator für knappe Expertenzeit.

Die zweite Lehre betrifft den Scope. Viele Unternehmen starten KI-Projekte zu breit und zu diffus. Bei Security funktioniert das selten. Der bessere Weg ist ein eng definierter Workflow mit klarer Metrik. Codex Security ist dafür ein gutes Beispiel, weil der Use Case präzise ist: Schwachstellen erkennen, kontextualisieren und verifizieren. Diese Fokussierung macht den Nutzen messbar.

Die dritte Lehre ist strategischer Natur. Wer Security nur als Compliance-Thema behandelt, wird den Nutzen solcher Systeme unterschätzen. Ein Tool, das kritische Schwachstellen früher und präziser erkennt, schützt nicht nur Audit-Ergebnisse. Es reduziert reale Geschäftsrisiken. Das betrifft Ausfallzeiten, Incident-Kosten, Reputationsschäden und die Belastung von Teams im Ernstfall.

Die vierte Lehre ist, dass belastbare Praxisbelege wichtiger sind als Modellversprechen. The Decoder verweist auf 14 vergebene CVEs und gemeldete Lücken in bekannten Open-Source-Projekten. Das ist für Entscheider relevanter als jede abstrakte Aussage über Modellfähigkeiten. Wer KI-Tools bewertet, sollte immer fragen: Welche nachweisbaren Ergebnisse liegen außerhalb der eigenen Demo-Umgebung vor?

Der Ansatz eignet sich besonders für Unternehmen mit eigener Softwareentwicklung, mehreren aktiven Repositories und einem spürbaren Triage-Aufwand in der Security. Dazu gehören SaaS-Anbieter, Plattformunternehmen, Fintechs, Healthtechs, Industrieunternehmen mit Softwareanteil und größere IT-Abteilungen im Mittelstand. Überall dort, wo Releases schnell erfolgen und Security-Teams nicht im gleichen Tempo wachsen, entsteht ein klarer Hebel.

Auch Unternehmen mit starkem Open-Source-Bezug sollten aufmerksam sein. The Decoder berichtet, dass OpenAI Schwachstellen in Projekten wie OpenSSH, GnuTLS und Chromium gemeldet hat und ein Programm für Open-Source-Maintainer ausbauen will. Das zeigt, dass der Ansatz nicht nur für proprietäre Enterprise-Software relevant ist. Wer viele Open-Source-Komponenten nutzt oder selbst Maintainer-Rollen hat, kann doppelt profitieren: bei der Absicherung eigener Produkte und bei der Bewertung externer Abhängigkeiten.

Weniger geeignet ist der Ansatz dort, wo kaum eigener Code entsteht oder Security-Prozesse organisatorisch noch nicht anschlussfähig sind. Wenn ein Unternehmen weder saubere Repository-Strukturen noch definierte Verantwortlichkeiten für Findings hat, wird ein KI-Agent die Probleme nicht lösen. Er macht sie eher sichtbarer. Das kann trotzdem wertvoll sein, sollte aber nicht mit unmittelbarer Effizienzsteigerung verwechselt werden.

Für regulierte Branchen ist die Übertragbarkeit grundsätzlich hoch, aber an Bedingungen geknüpft. Dort zählen Nachvollziehbarkeit, Datenzugriff, Freigaben und Auditierbarkeit besonders stark. Ein Pilot kann trotzdem sinnvoll sein, wenn er in einer klar abgegrenzten Umgebung stattfindet. Entscheidend ist, dass Governance und technische Integration von Anfang an mitgedacht werden und nicht erst nach einem erfolgreichen Testlauf.

Der sinnvollste erste Schritt ist kein Tool-Rollout, sondern ein strukturierter Eignungscheck. Wählen Sie ein aktives Repository aus, erfassen Sie die letzten drei bis sechs Monate an Security-Findings und dokumentieren Sie, wie viel Aufwand aktuell in Triage, Rückfragen und Verifikation fließt. Wenn Ihr Team regelmäßig unter zu vielen Warnungen leidet oder kritische Findings erst spät sauber einordnen kann, ist der Use Case grundsätzlich passend.

Im zweiten Schritt sollten Sie die Bewertungskriterien vorab festlegen. Dazu gehören mindestens vier Fragen: Sinkt die Zahl irrelevanter Meldungen, steigt die Qualität der Priorisierung, verkürzt sich die Zeit bis zur Verifikation und entstehen daraus schneller umsetzbare Tickets für Entwickler. Die von The Decoder genannten Werte von über 50 Prozent weniger Fehlalarmen und 84 Prozent weniger überflüssigen Meldungen sind dafür ein guter Referenzrahmen. Entscheidend bleibt aber, ob Ihr eigener Workflow ähnliche Effekte zeigt.

Im dritten Schritt definieren Sie einen begrenzten Pilot mit klarer Laufzeit, etwa vier bis sechs Wochen. In diesem Zeitraum sollten Security und Entwicklung gemeinsam auswerten, welche Findings wirklich relevant waren, welche Prozesse angepasst werden mussten und ob der zusätzliche Kontext des Systems die Zusammenarbeit verbessert hat. Erst danach ergibt eine Entscheidung über breitere Einführung Sinn. So vermeiden Sie, dass ein vielversprechendes Tool an fehlender Prozessreife scheitert.

Wenn Sie bereits ChatGPT Enterprise, Business oder Edu nutzen, ist die Einstiegshürde laut The Decoder aktuell besonders niedrig, weil Codex Security als Forschungsvorschau verfügbar ist und im ersten Monat kostenlos angeboten wird. Das macht einen begrenzten Test wirtschaftlich attraktiv. Trotzdem gilt: Der eigentliche Aufwand liegt nicht in der Lizenz, sondern in der sauberen Einbettung in Ihren Security- und Entwicklungsprozess.

Das Beispiel Codex Security zeigt sehr klar, wo der reale Nutzen von KI in der Software-Sicherheit liegt. Nicht in mehr Alarmen, sondern in besserem Kontext, weniger Rauschen und schnellerer Verifikation. Unternehmen, die diesen Bereich prüfen wollen, sollten deshalb nicht mit einer breiten Tool-Diskussion starten, sondern mit einem eng gefassten Pilot-Workflow und belastbaren Kennzahlen.

Gerade bei Security entscheidet nicht das Modellversprechen, sondern die Prozessqualität rund um den Einsatz. Wer den Pilot sauber aufsetzt, erkennt schnell, ob ein KI-Agent das eigene Team wirklich entlastet oder nur einen weiteren Analysekanal schafft. Eine strukturierte Bewertung der eigenen Repositories, Security-Backlogs und Freigabeprozesse verkürzt diesen Weg deutlich und verhindert teure Fehlstarts.

Sed at tellus, pharetra lacus, aenean risus non nisl ultricies commodo diam aliquet arcu enim eu leo porttitor habitasse adipiscing porttitor varius ultricies facilisis viverra lacus neque.