Erhalte unsere neuesten Artikel und Updates bequem per E-Mail

Automatisierte Business-Research-Berichte sind für viele Unternehmen kein Zukunftsthema, sondern eine sehr konkrete Effizienzfrage. Wer regelmäßig Firmen recherchiert, Märkte bewertet, Wettbewerber beobachtet oder Vorqualifizierungen für Vertrieb, M&A, Einkauf oder Partnerschaften erstellt, kennt das Muster. Die eigentliche Denkarbeit ist wertvoll, aber ein großer Teil der Zeit fließt in das Sammeln, Strukturieren und Verdichten von Informationen. Genau dort entsteht ein klarer Hebel für Automatisierung.

Die aktuelle Workflow-Vorlage von n8n mit dem Titel Generate business research reports with Claude, web search and Google Drive zeigt sehr konkret, was heute möglich ist. Laut n8n akzeptiert der Workflow ein Forschungsthema oder einen Firmennamen, sammelt autonom Daten aus verschiedenen Live-Quellen wie Websuche, Newsfeeds und Finanz-APIs, führt eine mehrstufige Analyse mit Claude AI durch und liefert einen strukturierten, professionellen Bericht ohne menschliches Eingreifen. n8n beziffert den Nutzen dabei mit 4 bis 8 Stunden Analystenzeit pro Bericht und einer Lieferzeit von weniger als 3 Minuten.

Diese Zahlen sind für Entscheider relevant, weil sie den Unterschied zwischen punktueller Unterstützung und operativer Entlastung markieren. Wenn ein Team jede Woche mehrere Research-Anfragen bearbeitet, summiert sich der Aufwand schnell auf Dutzende Stunden. Gleichzeitig erwarten interne Stakeholder schnelle Antworten, saubere Quellenlage und konsistente Berichtsformate. Automatisierte Business-Research-Berichte setzen genau an dieser Schnittstelle an: Geschwindigkeit, Standardisierung und Skalierbarkeit.

Wichtig ist aber die richtige Einordnung. Das Potenzial liegt nicht nur darin, einen Bericht schneller zu erzeugen. Der eigentliche Mehrwert entsteht, wenn Research als wiederholbarer Prozess gedacht wird. Dann wird aus einer einzelnen Rechercheleistung ein belastbarer Workflow, der Anfragen annimmt, Datenquellen orchestriert, Ergebnisse strukturiert, Ausnahmen erkennt und Berichte in bestehende Systeme zurückspielt.

Relevant ist das Thema für Unternehmen, die regelmäßig externe Informationen in Entscheidungen übersetzen müssen. Dazu gehören Vertriebsorganisationen, die Zielkunden vorqualifizieren, Private-Equity- und M&A-nahe Teams, die Firmenprofile aufbereiten, Einkaufsabteilungen mit Lieferantenbewertung, Business-Development-Teams, die Märkte und Partner prüfen, sowie Operations- oder Strategieeinheiten, die Wettbewerbsbeobachtung systematisieren wollen. Auch Agenturen und Beratungen mit hohem Rechercheanteil profitieren stark.

Besonders interessant wird das Thema dort, wo Research zwar geschäftskritisch ist, aber nicht als Kernprodukt verkauft wird. In vielen mittelständischen Unternehmen erledigen Sales Ops, Assistenz, Marketing oder Fachabteilungen diese Arbeit nebenbei. Das führt zu Medienbrüchen, uneinheitlicher Qualität und langen Durchlaufzeiten. Ein automatisierter Ansatz mit n8n und Claude kann diese Aufgaben bündeln und in einen klaren Prozess überführen.

Für IT-Entscheider ist das Thema relevant, weil es exemplarisch zeigt, wie moderne KI-Automatisierung in der Praxis funktioniert. Es geht nicht darum, ein Sprachmodell isoliert einzusetzen. Es geht um das Zusammenspiel aus Triggern, Datenquellen, API-Anbindungen, Entscheidungslogik, Dokumentenerstellung, Ablage und Monitoring. Genau diese Orchestrierung ist der Punkt, an dem aus einem KI-Experiment ein belastbarer Geschäftsprozess wird.

Für Geschäftsführer und Bereichsleiter ist die Frage noch einfacher. Wo heute qualifizierte Mitarbeiter mehrere Stunden pro Vorgang in Recherche und Aufbereitung investieren, lohnt sich die Prüfung fast immer. Wenn n8n für einen solchen Workflow von 4 bis 8 Stunden Zeitersparnis pro Bericht spricht, dann ist das kein nettes Extra. Dann ist das ein operativer Hebel mit direkter Auswirkung auf Kosten, Reaktionsgeschwindigkeit und Kapazität.

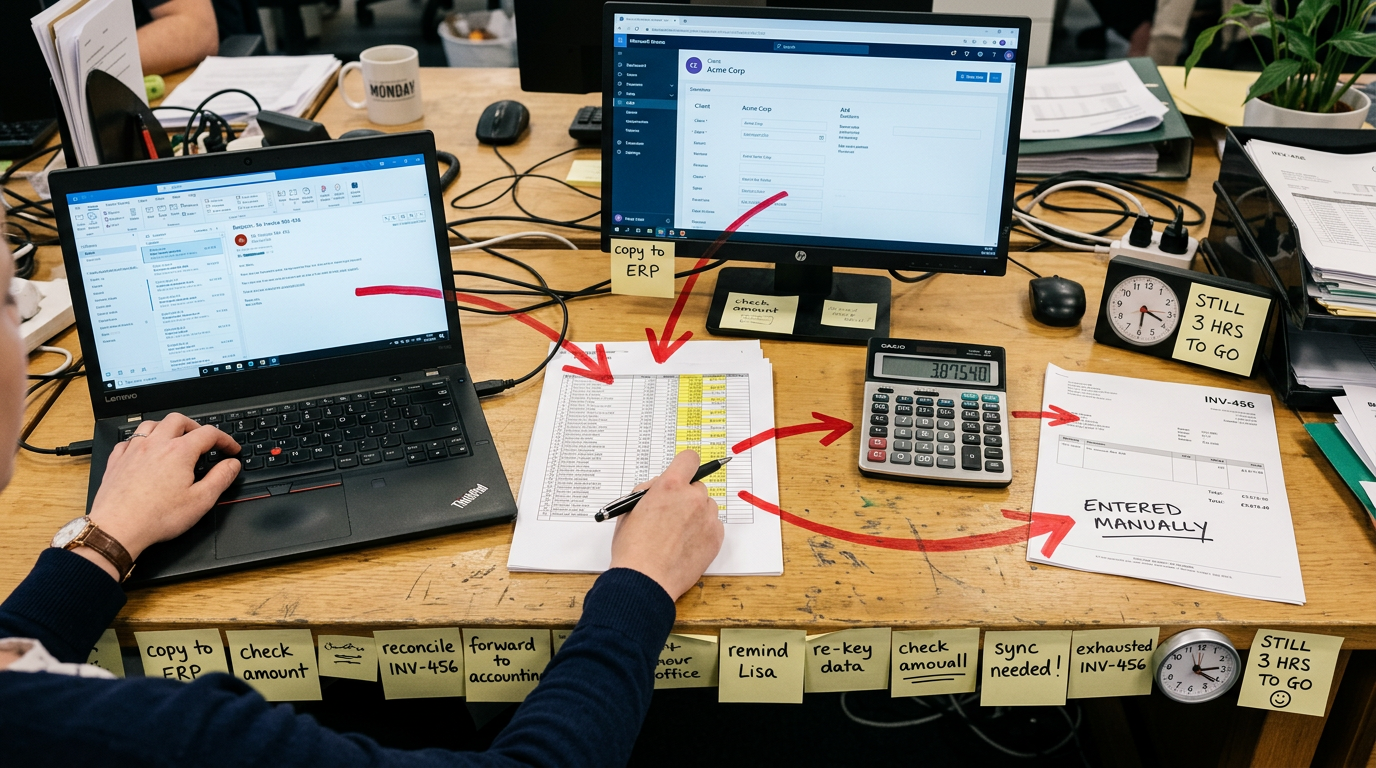

Manuelle Business-Recherche wirkt auf den ersten Blick beherrschbar. Eine Person sucht Informationen, prüft Quellen, kopiert relevante Daten in ein Dokument und formuliert daraus eine Zusammenfassung. Solange das nur gelegentlich passiert, fällt die Ineffizienz kaum auf. Sobald aber mehrere Anfragen pro Woche oder pro Tag eingehen, kippt das Modell.

Das erste Problem ist die Sucharbeit selbst. Informationen liegen verteilt über Suchmaschinen, Newsseiten, Unternehmenswebsites, Datenbanken, Finanzquellen und interne Systeme. Mitarbeiter springen zwischen Tabs, prüfen Dubletten, bewerten Relevanz und versuchen, aus heterogenen Quellen ein konsistentes Bild zu bauen. Dieser Aufwand ist repetitiv, fehleranfällig und teuer, weil er von qualifizierten Personen erledigt wird.

Das zweite Problem ist die fehlende Standardisierung. Jeder recherchiert etwas anders, setzt andere Schwerpunkte und formuliert Berichte in eigener Struktur. Das erschwert Vergleichbarkeit und Weiterverarbeitung. Wenn ein Team zehn Berichte erstellt, entstehen oft zehn unterschiedliche Qualitätsniveaus, zehn verschiedene Gliederungen und zehn Varianten der Quellenbewertung.

Das dritte Problem ist die Geschwindigkeit. Interne Stakeholder wollen Entscheidungen nicht in zwei Tagen, wenn die relevanten Informationen prinzipiell heute verfügbar sind. Vertrieb will vor einem Termin ein sauberes Firmenprofil. Einkauf braucht eine schnelle Einschätzung zu einem Lieferanten. Management will bei einer Marktbewegung rasch ein Briefing. Ein manueller Prozess skaliert hier nicht, weil er linear an Personenzeit gebunden bleibt.

Hinzu kommt ein Qualitätsproblem, das oft unterschätzt wird. Unter Zeitdruck sinkt die Sorgfalt bei Quellenprüfung, Aktualität und Struktur. Relevante Signale gehen verloren, weil niemand Zeit hat, mehrere Quellen systematisch gegeneinander zu prüfen. Genau deshalb ist die Kombination aus Automatisierung und KI so interessant: nicht nur schneller, sondern auch konsistenter.

Ein sinnvoller Ansatz für automatisierte Business-Research-Berichte besteht aus mehreren klar getrennten Bausteinen. n8n übernimmt dabei die Rolle des Orchestrators. Der Workflow startet über einen Trigger, etwa durch ein Formular, einen CRM-Eintrag, einen manuellen Request oder einen eingehenden Webhook. Danach sammelt das System Informationen aus definierten Quellen, strukturiert die Daten, übergibt sie an Claude zur Analyse und erzeugt anschließend ein standardisiertes Ergebnisdokument.

Die von n8n veröffentlichte Vorlage beschreibt genau dieses Muster. Laut n8n werden ein Forschungsthema oder ein Firmenname entgegengenommen, anschließend Daten aus Live-Quellen wie Websuche, Newsfeeds und Finanz-APIs gesammelt und in einer mehrstufigen Analyse mit Claude AI verarbeitet. Das Ergebnis ist ein struktururierter, professioneller Bericht, der ohne menschliches Eingreifen erstellt wird und in Google Drive abgelegt werden kann. Diese Beschreibung ist wichtig, weil sie zeigt, dass nicht ein einzelner Prompt den Wert erzeugt, sondern die Kette aus Datenerhebung, Analyse und Auslieferung.

Konzeptionell besteht die Architektur meist aus fünf Ebenen. Erstens braucht es eine saubere Eingabelogik mit klaren Parametern, damit das System weiß, ob es ein Unternehmen, einen Markt, einen Wettbewerber oder ein Thema analysieren soll. Zweitens folgt die Datenakquise über externe Quellen und gegebenenfalls interne Systeme. Drittens werden die Rohdaten normalisiert, dedupliziert und für die Analyse vorbereitet. Viertens erstellt das KI-Modell daraus eine strukturierte Bewertung. Fünftens wird das Ergebnis in ein Zielsystem überführt, etwa Dokumentenablage, CRM, Ticketsystem oder internes Wissenssystem.

Genau an dieser Stelle wird oft zu simpel gedacht. Viele Unternehmen sehen nur den KI-Teil und unterschätzen die Prozessarchitektur. Ein brauchbarer Bericht entsteht nicht dadurch, dass man Claude einfach bittet, etwas über eine Firma zu schreiben. Ein belastbarer Bericht entsteht erst dann, wenn Quellenzugriff, Datenqualität, Analyse-Logik, Formatvorgaben, Fehlerbehandlung und Übergabe an Folgeprozesse sauber zusammenspielen.

Ein professioneller Research-Workflow braucht mehr als eine lineare Abfolge von Schritten. Er muss Entscheidungen treffen. Welche Quellen sind für diesen Use Case relevant. Welche Ergebnisse sind aktuell genug. Welche Signale sind belastbar und welche nur schwache Hinweise. Welche Informationen fehlen und wie geht das System mit Lücken um. Diese Logik entscheidet darüber, ob ein Bericht im Alltag nutzbar ist oder nur gut aussieht.

Gerade bei Business Research ist Kontext entscheidend. Ein Vertriebsbriefing braucht andere Schwerpunkte als eine Lieferantenprüfung oder ein Markt-Screening. Deshalb muss die Architektur konzeptionell zwischen verschiedenen Berichtstypen unterscheiden können. Das betrifft nicht nur die Struktur des Outputs, sondern auch die Gewichtung von Quellen, die Tiefe der Analyse und die Art der Zusammenfassung. Ohne diese Differenzierung bleibt das Ergebnis generisch.

Hinzu kommt die Frage der Priorisierung. Wenn mehrere Quellen widersprüchliche Informationen liefern, muss der Workflow Regeln kennen. Wenn aktuelle News eine ältere Unternehmensdarstellung relativieren, darf das System nicht einfach beides gleichwertig nebeneinanderstellen. Wenn Finanzdaten fehlen, muss der Bericht das transparent machen, statt Lücken mit plausibel klingendem Text zu kaschieren. Solche Regeln lassen sich konzeptionell definieren, aber ihre saubere Umsetzung erfordert Erfahrung.

Auch die Ausgabe ist Teil der Entscheidungslogik. Ein Bericht ist nur dann operativ wertvoll, wenn er im richtigen Format ankommt. Manche Teams brauchen ein Management-Briefing mit klaren Kernaussagen. Andere benötigen strukturierte Felder für CRM oder Due-Diligence-Vorlagen. Wieder andere wollen eine Kombination aus narrativer Zusammenfassung, Quellenliste und Risikohinweisen. Ein guter Workflow denkt diese Zielstruktur von Anfang an mit.

Genau hier scheitern viele Eigenimplementierungen. Der erste typische Fehler ist die Überschätzung des Modells und die Unterschätzung der Datenbasis. Wenn Quellen unsauber ausgewählt, doppelt vorhanden oder inhaltlich schwach sind, produziert auch ein starkes Modell keinen belastbaren Bericht. Das Ergebnis wirkt dann sprachlich überzeugend, ist aber fachlich lückenhaft oder nicht ausreichend nachvollziehbar.

Der zweite Fehler liegt in der fehlenden Fehlerbehandlung. Externe APIs liefern nicht immer konsistente Antworten. Newsfeeds ändern Formate. Webquellen sind temporär nicht erreichbar. Suchergebnisse enthalten irrelevante Treffer. Wenn ein Workflow solche Fälle nicht sauber abfängt, bricht er entweder ab oder erstellt Berichte mit stillen Qualitätsmängeln. Gerade bei automatisierten Business-Research-Berichten ist das kritisch, weil Nutzer dem fertigen Dokument oft mehr Vertrauen schenken als einem Rohdatensatz.

Der dritte Fehler betrifft Governance und Nachvollziehbarkeit. Wer hat den Bericht angefordert. Welche Quellen wurden genutzt. Welche Daten waren zum Zeitpunkt der Erstellung verfügbar. Welche Annahmen hat das System getroffen. Ohne diese Transparenz wird es schwer, Ergebnisse intern zu vertreten oder später zu prüfen. Das ist nicht nur ein technisches Thema, sondern ein Prozess- und Verantwortungsproblem.

Ein weiterer häufiger Irrtum ist die Annahme, dass ein funktionierender Demo-Workflow bereits produktionsreif ist. Zwischen Proof of Concept und belastbarem Betrieb liegen Themen wie Rate Limits, API-Kosten, Rechtekonzepte, Logging, Versionierung, Monitoring, Eskalationspfade und Qualitätskontrollen. Genau deshalb ist die Umsetzung kein Copy-Paste-Thema. Sie verlangt Erfahrung mit Prozessdesign, API-Architektur und robuster Fehlerbehandlung.

Auch Prompt Engineering allein löst diese Probleme nicht. Gute Prompts helfen bei Struktur und Ausgabequalität, aber sie ersetzen keine saubere Systemarchitektur. Wenn Eingabedaten unvollständig sind, Quellen nicht priorisiert werden oder Ausnahmefälle nicht definiert sind, bleibt das Ergebnis fragil. Unternehmen, die hier zu schnell selbst bauen, investieren oft mehrfach: zuerst in einen schnellen Prototyp, später in eine aufwendige Stabilisierung.

Automatisierte Business-Research-Berichte sind kein isolierter Use Case. Sie sind ein Baustein für mehrere Geschäftsprozesse. Im Vertrieb lassen sich Account Briefings, Lead-Qualifizierung, Wettbewerbsvergleiche und Terminvorbereitungen automatisieren. Im Einkauf sind Lieferanten-Screenings, Marktüberblicke und Vorbewertungen denkbar. In Strategie und Business Development geht es um Marktbeobachtung, Partneranalysen und Opportunity-Screenings. Realistisch ist dabei nicht nur eine Zeitersparnis, sondern auch eine deutlich schnellere Erstbewertung mit konsistenter Struktur.

Die n8n-Vorlage liefert dafür einen greifbaren Referenzpunkt. Wenn laut n8n pro Bericht 4 bis 8 Stunden Analystenzeit eingespart werden und Ergebnisse in unter 3 Minuten vorliegen, dann wird aus Research ein Prozess, der sich in operative Abläufe integrieren lässt. Ein Vertriebsmitarbeiter kann vor einem Erstgespräch automatisch ein Briefing erhalten. Ein Einkaufsteam kann bei neuen Anbietern sofort ein standardisiertes Profil anfordern. Ein Management-Team kann bei Marktveränderungen schneller reagieren, weil die Informationsaufbereitung nicht erst manuell angestoßen werden muss.

Die Umsetzung erfordert allerdings mehr als das Verbinden einiger Tools. Wer solche Prozesse sauber automatisieren will, muss Trigger, Datenquellen, Rollen, Freigaben, Ausnahmefälle und Zielsysteme gemeinsam denken. Dazu kommen API-Architektur, Datenmapping, Dokumentenlogik und Fehlerszenarien. Genau an diesen Punkten scheitern Eigenimplementierungen häufig: Quellen liefern unvollständige Daten, Berichte landen im falschen Kontext, Dubletten werden nicht erkannt oder Folgeprozesse werden nicht sauber angestoßen.

Deshalb ist eine strukturierte Prozessanalyse der sinnvollste erste Schritt. Sie klärt, welche Entscheidungen der Bericht unterstützen soll, welche Datenquellen wirklich relevant sind, wie Qualität gemessen wird und an welcher Stelle menschliche Prüfung sinnvoll bleibt. Erst auf dieser Basis lässt sich entscheiden, ob ein vollautomatischer Ablauf sinnvoll ist oder ob ein Human-in-the-Loop-Modell die bessere Variante darstellt. Diese Vorarbeit spart später deutlich mehr Zeit als ein vorschneller technischer Start.

Professionelle Begleitung ist vor allem dann sinnvoll, wenn der Use Case geschäftskritisch ist oder mehrere Systeme betrifft. Sobald Berichte in Vertriebsprozesse, Management-Entscheidungen, Lieferantenfreigaben oder strategische Bewertungen einfließen, reicht ein netter Prototyp nicht mehr aus. Dann braucht es belastbare Datenflüsse, klare Verantwortlichkeiten und einen Workflow, der auch unter realen Bedingungen stabil läuft.

Sie ist auch dann sinnvoll, wenn Unternehmen bereits erste KI-Experimente gemacht haben, aber an der Operationalisierung hängen bleiben. Das ist ein typisches Muster. Ein Team testet ein Modell, erzielt gute Einzelergebnisse und merkt dann, dass die eigentliche Herausforderung in Integration, Standardisierung und Betrieb liegt. Genau dort bringt Erfahrung mit n8n, API-Anbindungen und Prozessautomatisierung den größten Hebel.

Ein externer Blick hilft außerdem, den Scope richtig zu schneiden. Nicht jeder Research-Prozess sollte sofort vollständig automatisiert werden. Manchmal ist ein fokussierter Einstieg sinnvoller, etwa für Sales Briefings oder standardisierte Firmenprofile. In anderen Fällen lohnt sich direkt eine breitere Architektur, weil mehrere Abteilungen auf denselben Research-Baustein zugreifen können. Diese Einordnung spart Budget und verkürzt die Zeit bis zum belastbaren Ergebnis.

Der entscheidende Punkt ist dabei nicht die Tool-Auswahl allein. Die Bausteine sind verfügbar. n8n zeigt mit seiner Vorlage, dass die technische Grundlage für automatisierte Business-Research-Berichte mit Claude, Websuche und Google Drive bereits existiert. Der Unterschied zwischen einer Demo und einem produktiven Prozess liegt in der sauberen Übersetzung des Geschäftsproblems in eine robuste Automatisierungsarchitektur.

Wer das Potenzial dieses Use Cases ernsthaft prüfen will, sollte nicht mit der Frage starten, welcher Prompt am besten funktioniert. Die bessere Frage lautet: Wo im Unternehmen entsteht heute wiederkehrender Research-Aufwand mit klaren Mustern, hohem Zeitverbrauch und standardisierbaren Ergebnissen. Genau dort liegt der wirtschaftliche Hebel. Erst wenn dieser Prozess sauber beschrieben ist, lohnt sich die technische Konzeption.

Eine gute Prozessanalyse betrachtet Eingaben, Datenquellen, Qualitätskriterien, Zielsysteme und Ausnahmen. Sie klärt, welche Berichtstypen gebraucht werden, welche Informationen zwingend enthalten sein müssen und an welchen Stellen menschliche Freigaben sinnvoll sind. Außerdem zeigt sie, wie sich der Workflow in bestehende Abläufe einfügt, statt als isoliertes KI-Experiment nebenher zu laufen.

Gerade bei automatisierten Business-Research-Berichten ist diese Vorarbeit entscheidend, weil der sichtbare Output nur die Spitze des Prozesses ist. Dahinter liegen Datenbeschaffung, Bewertung, Strukturierung, Dokumentenerstellung und Übergabe an Folgeprozesse. Wer diese Ebenen nicht gemeinsam plant, baut schnell einen Workflow, der im Demo gut aussieht, aber im Alltag zu viele Sonderfälle produziert. Eine strukturierte Analyse reduziert genau dieses Risiko.

Für Entscheider ist das die pragmatischste Perspektive. Das Potenzial ist klar belegt. n8n beschreibt einen Workflow, der Berichte in weniger als 3 Minuten erstellt und 4 bis 8 Stunden Analystenzeit pro Bericht spart. Die relevante Managementfrage lautet deshalb nicht, ob so etwas grundsätzlich möglich ist, sondern wie man es für den eigenen Prozess so aufsetzt, dass Qualität, Verlässlichkeit und Integration stimmen.

Automatisierte Business-Research-Berichte sind ein gutes Beispiel dafür, wie KI und Workflow-Automatisierung zusammen echten operativen Nutzen erzeugen. Die Recherche von n8n zeigt klar, dass sich Datensammlung, mehrstufige Analyse und strukturierte Berichtserstellung bereits in einem durchgängigen Prozess verbinden lassen. Der Hebel ist groß, aber produktive Ergebnisse entstehen erst durch sauberes Prozessdesign, belastbare Integrationen und Erfahrung in der Umsetzung.

Wenn Sie prüfen wollen, ob dieser Use Case in Ihrem Unternehmen wirtschaftlich sinnvoll ist, lohnt sich zuerst ein strukturierter Blick auf Volumen, Datenquellen, Qualitätsanforderungen und Folgeprozesse. Die Bausteine existieren bereits. Der Unterschied liegt darin, sie so zu kombinieren, dass aus einem interessanten Workflow ein verlässlicher Geschäftsprozess wird.

Sed at tellus, pharetra lacus, aenean risus non nisl ultricies commodo diam aliquet arcu enim eu leo porttitor habitasse adipiscing porttitor varius ultricies facilisis viverra lacus neque.