Erhalte unsere neuesten Artikel und Updates bequem per E-Mail

Die eigentliche Frage lautet nicht, ob Unternehmen KI und Automatisierung einsetzen sollten. Die entscheidende Frage ist, wie sich beides so in Geschäftsprozesse integrieren lässt, dass Produktivität steigt, ohne Datenschutz, Compliance und Haftung aus dem Ruder laufen zu lassen. Genau hier entsteht in vielen Unternehmen ein gefährlicher Zielkonflikt: Fachbereiche wollen schnelle Ergebnisse, während Datenschutz, IT und Geschäftsführung die Risiken tragen.

Das Problem verschärft sich, sobald KI nicht isoliert als einzelnes Tool genutzt wird, sondern Teil eines automatisierten Prozesses wird. Dann fließen Daten nicht mehr nur in eine Anwendung, sondern durch mehrere Systeme, Schnittstellen, Datenbanken, Freigaben und Entscheidungspunkte. Aus einer scheinbar harmlosen KI-Nutzung wird schnell eine verteilte Verarbeitung personenbezogener Daten mit rechtlichen, technischen und organisatorischen Folgen. Wer das unterschätzt, baut keine Effizienz auf, sondern neue Angriffsflächen.

Für Geschäftsführer und Operations-Verantwortliche ist das vor allem eine wirtschaftliche Frage. Wenn ein automatisierter Prozess schneller arbeitet, aber fehlerhafte Entscheidungen trifft, Daten in falsche Systeme schreibt oder Betroffenenrechte nicht sauber abbildet, entstehen Folgekosten. Diese Kosten zeigen sich selten sofort. Sie tauchen später als manuelle Nacharbeit, Eskalationen, Vertrauensverlust, Audit-Aufwand oder blockierte Digitalisierungsprojekte wieder auf.

Gleichzeitig ist das Potenzial enorm. KI-Automatisierung kann Anfragen vorsortieren, Dokumente klassifizieren, Stammdaten anreichern, interne Freigaben beschleunigen, Support-Prozesse entlasten oder Vertriebsabläufe strukturieren. Der wirtschaftliche Hebel entsteht aber nur dann, wenn Datenschutz nicht als nachträgliche Bremse behandelt wird, sondern als Designkriterium des Prozesses. Genau deshalb ist Datenschutz in der KI-Automatisierung keine juristische Randfrage, sondern eine Managemententscheidung mit direktem Einfluss auf Skalierbarkeit und ROI.

Viele Unternehmen reagieren auf das Thema mit vereinfachten Antworten. Die erste lautet: „Wir anonymisieren einfach alles.“ Die zweite: „Unser Anbieter ist DSGVO-konform.“ Die dritte: „Wir lassen einen Menschen final draufschauen, dann passt es schon.“ Keine dieser Antworten ist grundsätzlich falsch. Sie ist nur für sich genommen fast nie ausreichend.

Anonymisierung ist in der Praxis deutlich schwieriger, als es in Präsentationen klingt. In vielen Prozessen bleiben Daten durch Kombination mehrerer Merkmale weiterhin personenbeziehbar. Pseudonymisierung reduziert Risiken, beseitigt sie aber nicht. Wer hier unsauber arbeitet, wiegt sich in falscher Sicherheit und baut Prozesse auf Annahmen, die einer genaueren Prüfung nicht standhalten.

Auch die Aussage eines Anbieters, man sei DSGVO-konform, ersetzt keine eigene Bewertung. Unternehmen bleiben für die Rechtmäßigkeit ihrer Verarbeitung verantwortlich. Ein Auftragsverarbeitungsvertrag, eine Zertifizierung oder ein Hosting-Standort innerhalb der EU sind wichtige Bausteine, aber keine vollständige Entlastung. Entscheidend ist immer, welche Daten verarbeitet werden, zu welchem Zweck, mit welcher Logik, in welcher Systemkette und mit welchen Auswirkungen auf Betroffene.

Besonders riskant ist die Annahme, ein menschlicher Kontrollschritt löse automatisch alle Probleme rund um automatisierte Entscheidungen. Wenn der Mensch nur formal bestätigt, was die Maschine vorgegeben hat, ist das keine belastbare menschliche Prüfung. Gerade bei Entscheidungen mit erheblicher Wirkung auf Personen reicht ein symbolischer Freigabeschritt nicht aus. Unternehmen brauchen daher keine einfachen Beruhigungsformeln, sondern einen belastbaren Bewertungsrahmen für Prozesse, Datenflüsse und Entscheidungstiefe.

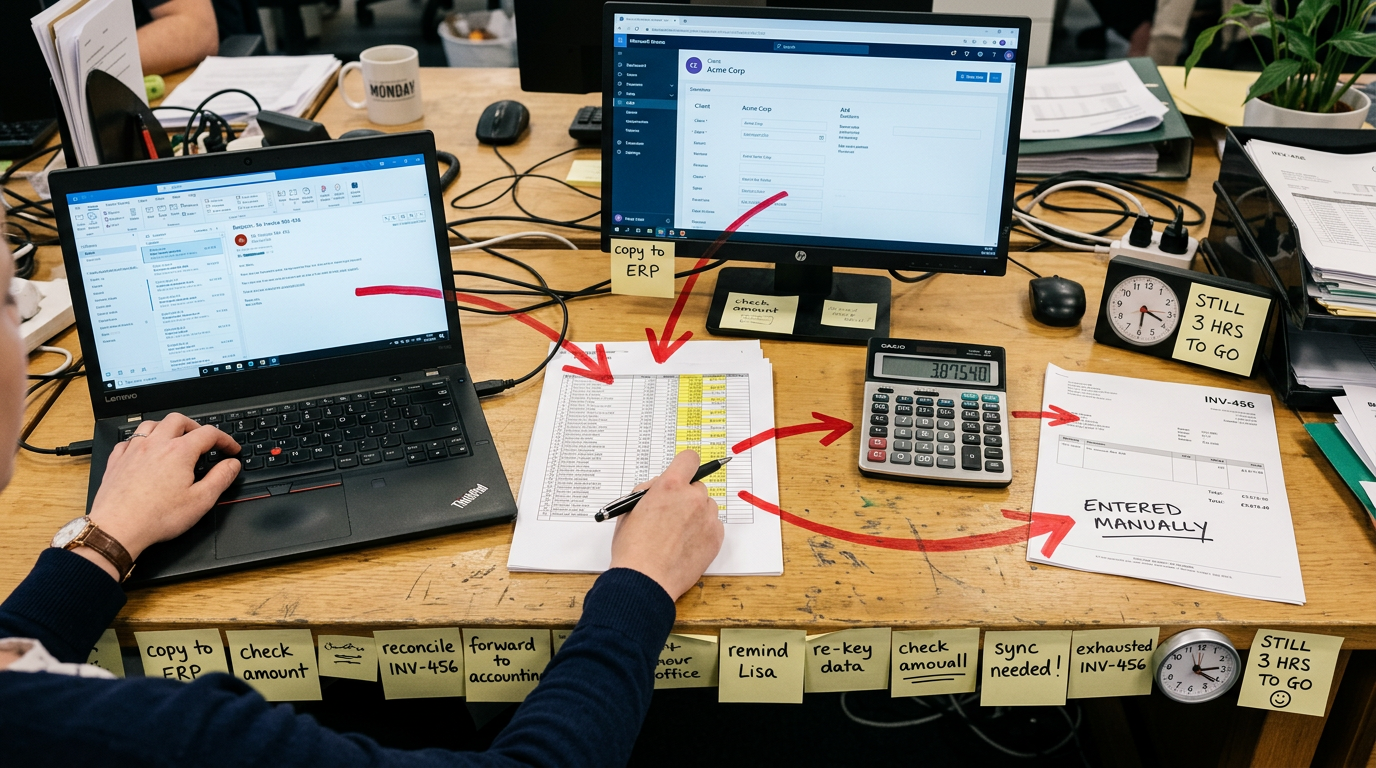

Die meisten Risiken entstehen nicht im offensichtlichen Teil des Projekts, sondern in den Übergängen. Ein KI-Modell allein ist selten das Hauptproblem. Kritisch wird es dort, wo Daten aus CRM, ERP, Ticketsystem, E-Mail, Dokumentenablage und Drittsystemen zusammengeführt werden. Genau an diesen Übergängen entstehen Fragen zu Rechtsgrundlage, Zweckbindung, Speicherfristen, Rollenverteilung, Zugriffen und Protokollierung.

Hinzu kommt, dass KI-Systeme oft probabilistisch arbeiten. Sie liefern keine deterministischen Ergebnisse wie klassische Business-Logik, sondern Wahrscheinlichkeiten, Klassifikationen oder generierte Inhalte. Das ist für viele Geschäftsprozesse nützlich, aber aus Datenschutz- und Governance-Sicht anspruchsvoll. Denn Unternehmen müssen nicht nur dokumentieren, dass Daten verarbeitet werden, sondern auch, wie Ergebnisse in Entscheidungen einfließen und welche Kontrollmechanismen greifen.

Ein weiterer blinder Fleck ist die Datenqualität. Viele Unternehmen diskutieren intensiv über Modelle, aber zu wenig über die Qualität der Eingangsdaten. Wenn personenbezogene Daten unvollständig, veraltet, doppelt oder falsch zugeordnet sind, skaliert eine Automatisierung nicht nur Effizienz, sondern auch Fehler. Datenschutz und Datenqualität sind deshalb enger verbunden, als viele Teams annehmen. Schlechte Daten führen nicht nur zu schlechten Ergebnissen, sondern auch zu unzulässigen oder unfairen Verarbeitungen.

Schließlich wird die operative Fehlerbehandlung oft unterschätzt. Was passiert, wenn ein API-Call fehlschlägt, ein Datensatz falsch gemappt wird, ein Modell eine sensible Information in ein Freitextfeld schreibt oder ein Löschersuchen mehrere verbundene Systeme betrifft? Genau diese Fragen entscheiden darüber, ob ein Prozess im Alltag tragfähig ist. Wer KI-Automatisierung ohne robuste Fehlerbehandlung plant, baut kein skalierbares System, sondern einen Störfall mit Verzögerung.

Unternehmen, die Datenschutz nur als Freigabeschritt am Ende eines Projekts behandeln, geraten fast zwangsläufig in Konflikte. Dann ist der Prozess bereits fachlich definiert, die Tool-Auswahl getroffen und die Erwartung im Management gesetzt. Datenschutz wird in diesem Modell zur Instanz, die spät auf Risiken hinweist und dadurch als Verhinderer wahrgenommen wird. Das ist organisatorisch unklug und wirtschaftlich teuer.

Deutlich wirksamer ist ein anderer Ansatz: Datenschutz wird von Beginn an als Architekturprinzip verstanden. Das bedeutet nicht, dass jedes Projekt langsamer wird. Im Gegenteil. Wenn früh geklärt ist, welche Daten wirklich benötigt werden, wo personenbezogene Informationen reduziert werden können, welche Systeme beteiligt sind und welche Entscheidungstiefe zulässig ist, sinkt der spätere Korrekturaufwand massiv.

Für die Praxis heißt das: Prozesse werden nicht nur nach Effizienz, sondern auch nach Datenlogik entworfen. Welche Daten sind für den Zweck erforderlich? Welche Felder können maskiert, pseudonymisiert oder getrennt verarbeitet werden? Wo ist ein menschlicher Review fachlich sinnvoll und rechtlich notwendig? Welche Informationen dürfen ein Modell überhaupt sehen? Diese Fragen gehören in die Prozessanalyse, nicht in die Schadensbegrenzung nach dem Go-live.

Gerade bei n8n-basierten Automatisierungen zeigt sich der Unterschied sehr deutlich. Die technische Flexibilität ist hoch, weil sich viele Systeme schnell verbinden lassen. Genau deshalb braucht es aber Erfahrung im Prozessdesign. Wer Datenflüsse sauber modelliert, kann Datenminimierung, Zweckbindung und kontrollierte Übergaben technisch abbilden. Wer nur schnell verbindet, produziert Schattenprozesse, unklare Verantwortlichkeiten und schwer beherrschbare Risiken.

Ein häufiger Denkfehler besteht darin, Datenschutz auf die Auswahl eines einzelnen Tools zu reduzieren. Dann wird gefragt, ob ein bestimmter KI-Anbieter DSGVO-konform sei. Diese Frage ist verständlich, aber zu eng. Denn selbst ein datenschutzfreundliches Tool kann in einem schlecht entworfenen Prozess zu einem Compliance-Problem werden.

Entscheidend ist nicht nur das Werkzeug, sondern die gesamte Verarbeitungskette. Wenn ein Unternehmen beispielsweise eingehende E-Mails automatisiert analysiert, Inhalte klassifiziert, Daten ins CRM überträgt, Aufgaben im Ticketsystem erzeugt und Ergebnisse an Drittsysteme weitergibt, dann ist die Compliance des Gesamtprozesses relevant. Jede Übergabe verändert den Risikokontext. Jede zusätzliche Schnittstelle erhöht Anforderungen an Dokumentation, Berechtigungskonzepte und Fehlerbehandlung.

Das gilt besonders für Auftragsverarbeitung und Drittlandtransfers. Ein AVV nach Art. 28 DSGVO ist wichtig, aber er beantwortet nicht automatisch alle Fragen. Unternehmen müssen prüfen, welche Unterauftragsverarbeiter beteiligt sind, wo Daten verarbeitet werden, welche technischen und organisatorischen Maßnahmen greifen und ob die tatsächliche Nutzung des Tools mit dem vereinbarten Zweck übereinstimmt. Papier allein schützt nicht vor operativen Fehlkonstruktionen.

Für Entscheider bedeutet das: Nicht die Tool-Liste entscheidet über das Risiko, sondern die Prozessarchitektur. Wer Datenschutz ernst nimmt, bewertet Datenflüsse, Rollen, Speicherorte, Protokollierung, Löschlogik und Eskalationspfade im Zusammenhang. Genau hier trennt sich eine professionelle Automatisierung von einem improvisierten Setup, das nur so lange funktioniert, bis der erste Sonderfall auftritt.

Sobald KI-Ergebnisse in Entscheidungen über Personen einfließen, steigt die regulatorische Sensibilität deutlich. Das betrifft nicht nur offensichtliche Fälle wie Kreditvergabe oder Bewerberauswahl. Auch Priorisierungen, Risikobewertungen, Eskalationsstufen, Freigabeempfehlungen oder automatische Ablehnungen können erhebliche Auswirkungen haben, wenn sie den weiteren Prozess maßgeblich steuern. Unternehmen sollten deshalb sehr genau prüfen, wo KI nur unterstützt und wo sie faktisch entscheidet.

Die Diskussion um Art. 22 DSGVO wird in vielen Projekten zu spät geführt. Dabei ist sie strategisch zentral. Wenn eine automatisierte Entscheidung rechtliche Wirkung entfaltet oder eine Person in ähnlicher Weise erheblich beeinträchtigt, reicht technische Machbarkeit nicht aus. Dann braucht es eine belastbare Bewertung, ob und wie menschliche Überprüfung, Transparenz und Widerspruchsmöglichkeiten gestaltet werden müssen. Ein rein formaler Freigabeschritt genügt in solchen Konstellationen regelmäßig nicht.

Das EuGH-Umfeld rund um automatisierte Scoring-Logiken zeigt, wie relevant diese Frage ist. Unternehmen sollten daraus keine Panik ableiten, aber eine klare Lehre ziehen: Sobald Scores, Klassifikationen oder Empfehlungen eine maßgebliche Rolle für Entscheidungen spielen, muss die Governance deutlich strenger werden. Das betrifft Dokumentation, Nachvollziehbarkeit, Rollenverteilung und die Frage, ob der Prozess fachlich überhaupt so gestaltet werden sollte.

In der Praxis ist oft ein hybrider Ansatz sinnvoll. KI kann vorsortieren, strukturieren, zusammenfassen oder Risiken markieren. Die finale Entscheidung bleibt dort beim Menschen, wo Auswirkungen erheblich sind oder die Datenlage unscharf ist. Dieser Ansatz ist jedoch nur dann belastbar, wenn der menschliche Review fachlich ernsthaft ausgestaltet ist. Genau diese Ausgestaltung ist komplex und lässt sich nicht mit einem simplen „Vier-Augen-Prinzip“ abhaken.

Viele Teams erleben Datenminimierung als Einschränkung. Fachlich wirkt es zunächst attraktiv, möglichst viele Daten in ein KI-System zu geben, um bessere Ergebnisse zu erhalten. In der Realität führt dieser Reflex oft zu unnötiger Komplexität. Mehr Daten bedeuten mehr Risiko, mehr Prüfaufwand, mehr Berechtigungsfragen und mehr potenzielle Fehlerquellen. Nicht jeder Informationsgewinn rechtfertigt diesen Preis.

Datensparsame Prozesse sind häufig nicht nur datenschutzfreundlicher, sondern auch operativ stabiler. Wenn ein Modell nur die wirklich erforderlichen Felder erhält, sinkt die Wahrscheinlichkeit, dass sensible Informationen unbeabsichtigt verarbeitet, gespeichert oder weitergegeben werden. Gleichzeitig werden Mapping, Logging, Löschkonzepte und Zugriffsrechte einfacher beherrschbar. Das reduziert nicht nur Compliance-Risiken, sondern auch Wartungsaufwand.

Pseudonymisierung und Trennung von Datenkontexten sind dabei wichtige Muster. Personenbeziehbare Merkmale müssen nicht in jedem Verarbeitungsschritt sichtbar sein. In vielen Automatisierungen reicht es aus, mit Referenzen, Kategorien oder abstrahierten Merkmalen zu arbeiten und den Personenbezug erst an klar definierten Stellen wieder herzustellen. Dieses Prinzip klingt einfach, ist in der Umsetzung aber anspruchsvoll, weil Datenmodelle, Prozesslogik und Berechtigungskonzepte sauber zusammenspielen müssen.

Gerade hier scheitern viele DIY-Ansätze. Sie verbinden Systeme schnell, ohne ein konsistentes Datenmodell zu definieren. Das Ergebnis sind redundante Datenspeicher, unklare Feldzuordnungen und Prozesse, in denen niemand mehr sicher sagen kann, welche personenbezogenen Daten wo liegen. Eine strukturierte Prozessanalyse ist deshalb kein Bürokratieakt, sondern die Voraussetzung dafür, Datenminimierung überhaupt technisch und organisatorisch belastbar umzusetzen.

Die DSGVO verlangt keine Offenlegung jedes mathematischen Details eines Modells. Sie verlangt aber, dass Unternehmen ihre Verarbeitung nachvollziehbar beschreiben und Betroffenenrechte praktisch handhabbar machen können. In KI-Automatisierungen ist das anspruchsvoll, weil Entscheidungen oft aus mehreren Teilschritten entstehen: Dateneingang, Vorverarbeitung, Klassifikation, Regelwerk, Übergabe an Fachsysteme und menschliche Freigabe. Ohne saubere Dokumentation lässt sich dieser Ablauf später kaum erklären.

Transparenz ist deshalb nicht nur eine juristische Pflicht, sondern ein operativer Schutzmechanismus. Wenn intern klar dokumentiert ist, welche Datenquellen genutzt werden, welche Logik greift, welche Schwellenwerte relevant sind und wo menschliche Eingriffe vorgesehen sind, sinkt die Abhängigkeit von Einzelpersonen. Gleichzeitig wird es einfacher, Audits zu bestehen, Vorfälle zu analysieren und Prozesse kontrolliert weiterzuentwickeln.

Explainable AI ist in diesem Zusammenhang kein Selbstzweck. Nicht jeder Prozess braucht maximale technische Erklärbarkeit. Aber jeder relevante Prozess braucht ein Erklärniveau, das zur Wirkung des Prozesses passt. Je stärker ein KI-Ergebnis Entscheidungen beeinflusst, desto höher sind die Anforderungen an Nachvollziehbarkeit, Dokumentation und Governance. Diese Abstufung sauber zu definieren, ist eine strategische Aufgabe und keine rein technische Detailfrage.

Unternehmen unterschätzen oft, wie viel Abstimmung dafür nötig ist. Fachbereich, Datenschutz, IT, Informationssicherheit und gegebenenfalls Betriebsrat oder Compliance müssen ein gemeinsames Verständnis entwickeln. Genau deshalb scheitern viele Projekte nicht an der Modellleistung, sondern an fehlender organisatorischer Anschlussfähigkeit. Wer Transparenz erst nachträglich herstellen will, zahlt fast immer doppelt.

Eine belastbare Entscheidung entsteht nicht aus Bauchgefühl, sondern aus klaren Kriterien. Der erste Prüfpunkt ist die Datenart. Werden ausschließlich unkritische Geschäftsdaten verarbeitet oder auch personenbezogene, sensible oder besonders schützenswerte Informationen? Je höher die Sensibilität, desto strenger müssen Architektur, Zugriffskonzept, Dokumentation und Kontrollmechanismen ausfallen.

Der zweite Prüfpunkt ist die Wirkung des Prozesses. Unterstützt die KI lediglich interne Arbeitsschritte, oder beeinflusst sie Entscheidungen über Kunden, Mitarbeitende, Bewerber oder Partner? Prozesse mit erheblicher Außenwirkung verlangen ein anderes Governance-Niveau als reine Assistenzfunktionen. Wer diese Unterscheidung nicht sauber trifft, bewertet Risiken systematisch zu niedrig.

Der dritte Prüfpunkt ist die technische Prozesskette. Welche Systeme sind beteiligt? Wo entstehen Kopien? Welche APIs übertragen Daten? Welche Logs fallen an? Wie werden Fehler behandelt? Wie werden Löschfristen und Berichtigungen systemübergreifend umgesetzt? Gerade in Automatisierungsplattformen wie n8n liegt der Vorteil in der Integrationsfähigkeit. Gleichzeitig steigt damit die Verantwortung, Datenflüsse präzise zu modellieren und abzusichern.

Der vierte Prüfpunkt ist die organisatorische Reife. Gibt es klare Verantwortlichkeiten, ein abgestimmtes Freigabeverfahren, dokumentierte Richtlinien, Schulungen und ein realistisches Betriebsmodell? Viele Projekte scheitern nicht an der Idee, sondern an fehlender Betriebsfähigkeit. Ein guter Bewertungsrahmen betrachtet deshalb immer Recht, Technik, Prozess und Organisation gemeinsam. Erst aus dieser Gesamtsicht lässt sich entscheiden, welche Use Cases schnell realisierbar sind und welche zunächst konzeptionell nachgeschärft werden müssen.

KI-Automatisierung wirkt auf den ersten Blick oft einfacher, als sie im Betrieb tatsächlich ist. Ein Proof of Concept ist schnell gebaut. Ein belastbarer Geschäftsprozess ist etwas anderes. Sobald personenbezogene Daten, mehrere Systeme, Freigaben, Ausnahmen und Compliance-Anforderungen zusammenkommen, reicht technisches Basteln nicht mehr aus. Dann braucht es Erfahrung im Zusammenspiel von Prozessdesign, API-Architektur, Datenmodellierung und Fehlerbehandlung.

Genau hier liegt die typische Schwachstelle von Eigenimplementierungen. Der Fokus liegt häufig auf der Hauptlogik: Daten rein, KI-Ausgabe raus, nächster Schritt. Was fehlt, sind Retry-Strategien, Fallbacks, Monitoring, Versionierung, Rechtekonzepte, Audit-Trails und saubere Behandlung von Sonderfällen. Solange das Volumen niedrig ist, bleibt das oft unsichtbar. Mit wachsender Nutzung treten dann Inkonsistenzen, doppelte Datensätze, fehlerhafte Übergaben und manuelle Korrekturschleifen auf.

Auch datenschutzrechtlich sind diese Lücken kritisch. Wenn nicht klar ist, welche Daten an welcher Stelle verarbeitet oder gespeichert werden, lassen sich Auskunft, Berichtigung oder Löschung kaum zuverlässig umsetzen. Wenn Logs sensible Inhalte enthalten oder Fehlerpfade nicht dokumentiert sind, entstehen zusätzliche Risiken. Datenschutz scheitert in der Praxis selten an einem einzelnen großen Verstoß, sondern an vielen kleinen Architekturfehlern, die sich im Alltag summieren.

Deshalb ist eine strukturierte Prozessanalyse der sinnvollste erste Schritt. Sie klärt nicht nur, was automatisierbar ist, sondern auch, welche Daten wirklich benötigt werden, wo Risiken liegen, welche Kontrollpunkte notwendig sind und wie ein tragfähiges Betriebsmodell aussieht. Das spart nicht nur rechtliche Diskussionen, sondern vor allem Wochen oder Monate an Trial-and-Error in der Umsetzung.

Interner Aufbau kann sinnvoll sein, wenn ein Unternehmen bereits über starke Kompetenzen in Prozessmanagement, Integration, Datenschutz, Informationssicherheit und Betrieb verfügt. Dann lassen sich klar abgegrenzte Use Cases mit geringer Entscheidungstiefe und überschaubarem Datenrisiko intern entwickeln. Voraussetzung ist allerdings, dass nicht nur ein technikaffines Team vorhanden ist, sondern auch Governance, Dokumentation und Betrieb professionell aufgesetzt werden.

Schwierig wird es, wenn Unternehmen zwar den fachlichen Bedarf sehen, aber die Umsetzung als reines Tool-Thema behandeln. Dann wird erwartet, dass ein Workflow-Tool, ein KI-Modell und ein paar API-Verbindungen ausreichen. In der Realität fehlen oft belastbare Datenmodelle, klare Verantwortlichkeiten und Erfahrung mit Ausnahmefällen. Genau dann wird aus einem vermeintlich günstigen Eigenprojekt ein teurer Lernprozess mit unklarem Ergebnis.

Externe Begleitung ist besonders dann sinnvoll, wenn Prozesse mehrere Systeme verbinden, personenbezogene Daten enthalten, regulatorisch sensibel sind oder schnell in den Betrieb überführt werden sollen. Der Mehrwert liegt nicht nur in technischer Umsetzung, sondern vor allem in der Fähigkeit, Risiken früh zu erkennen, Architekturentscheidungen sauber zu treffen und einen Prozess so zu gestalten, dass er auch unter Last stabil bleibt. Das verkürzt die Zeit bis zum belastbaren Ergebnis erheblich.

Die ehrliche Einordnung lautet deshalb: Nicht jedes Unternehmen muss alles extern vergeben. Aber je höher Komplexität, Datenrisiko und Integrationsgrad sind, desto stärker zahlt sich Erfahrung aus. Wer KI-Automatisierung unter DSGVO-Bedingungen ernsthaft produktiv nutzen will, braucht mehr als gute Absichten. Er braucht ein Design, das fachlich funktioniert, technisch sauber ist und regulatorisch trägt.

Viele Unternehmen suchen nach dem einen großen KI-Use-Case. In der Praxis entsteht der größte Hebel oft durch mehrere klar definierte Prozesse mit hohem Volumen und wiederkehrender Logik. Dazu gehören etwa die Vorqualifizierung eingehender Anfragen, die Klassifikation von Dokumenten, die Extraktion strukturierter Informationen aus E-Mails und Anhängen, die Priorisierung von Tickets, die Vorbereitung interner Freigaben oder die Anreicherung von Stammdaten. In all diesen Fällen kann KI-Automatisierung Bearbeitungszeiten deutlich senken und manuelle Routinen reduzieren.

Realistisch sind je nach Prozess spürbare Effekte bei Durchlaufzeit, Fehlerquote und operativer Entlastung. Wenn Mitarbeitende heute täglich Informationen aus mehreren Quellen zusammensuchen, Inhalte manuell kategorisieren oder Standardfälle händisch weiterleiten, lassen sich oft zweistellige Prozentwerte an Zeitersparnis erzielen. Der wirtschaftliche Nutzen entsteht dabei nicht nur durch weniger Aufwand, sondern auch durch schnellere Reaktionszeiten, konsistentere Bearbeitung und bessere Skalierbarkeit bei wachsendem Volumen.

Genau an dieser Stelle wird Datenschutz zum Erfolgsfaktor. Denn dieselben Prozesse arbeiten häufig mit personenbezogenen Daten, Vertragsinformationen, Kommunikationsinhalten oder sensiblen Kontextdaten. Wer hier ohne sauberes Prozessdesign automatisiert, riskiert Dateninkonsistenzen, unzulässige Weitergaben oder intransparente Entscheidungen. Ein technisch funktionierender Workflow ist noch kein belastbarer Geschäftsprozess.

Die Umsetzung erfordert daher mehr als die Verbindung einzelner Tools. Nötig sind ein tragfähiges Datenmodell, klar definierte Übergabepunkte, robuste API-Architektur, Logging mit Augenmaß, Fehlerbehandlung und Monitoring. Genau hier scheitern viele DIY-Ansätze: Sie funktionieren im Demo-Fall, aber nicht im Alltag mit Ausnahmen, Lastspitzen, unvollständigen Daten und regulatorischen Anforderungen. Deshalb ist eine strukturierte Prozessanalyse fast immer der sinnvollste Startpunkt, bevor produktive KI-Automatisierung ausgerollt wird.

Wer Datenschutz in der KI-Automatisierung sauber lösen will, sollte nicht mit der Tool-Frage beginnen. Der richtige Startpunkt ist der Prozess. Welche Entscheidung soll verbessert werden? Welche Daten werden dafür wirklich benötigt? Welche Systeme sind beteiligt? Wo entstehen Risiken für Betroffene? Welche Fehler wären fachlich, wirtschaftlich oder regulatorisch besonders teuer? Erst wenn diese Fragen beantwortet sind, lässt sich sinnvoll über Architektur und Anbieter sprechen.

Aus dieser Perspektive wird auch klar, warum viele Projekte unnötig lange dauern. Teams diskutieren über Modelle, Anbieter und Features, bevor sie den Zielprozess sauber beschrieben haben. Dadurch werden technische Entscheidungen getroffen, ohne die spätere Betriebsrealität zu kennen. Das führt zu Nacharbeiten, Richtungswechseln und internen Reibungsverlusten, die sich mit einer strukturierten Voranalyse vermeiden ließen.

Ein belastbarer Handlungsrahmen verbindet deshalb vier Ebenen: Geschäftsprozess, Datenschutz, technische Architektur und Betrieb. Auf Prozessebene geht es um Zielbild, Ausnahmen und Verantwortlichkeiten. Auf Datenschutzebene um Rechtsgrundlage, Datenminimierung, Transparenz und Betroffenenrechte. Auf Architekturebene um Schnittstellen, Datenflüsse, Speicherorte und Kontrollpunkte. Auf Betriebsebene um Monitoring, Incident Handling, Audits und kontinuierliche Anpassung.

Unternehmen, die diesen Rahmen ernst nehmen, treffen bessere Entscheidungen und kommen schneller zu tragfähigen Ergebnissen. Nicht weil sie langsamer starten, sondern weil sie weniger Umwege gehen. Gerade bei KI-Automatisierung unter DSGVO-Bedingungen ist das der Unterschied zwischen einem kurzfristig beeindruckenden Pilot und einem Prozess, der dauerhaft produktiv, skalierbar und prüffest läuft.

Die Bausteine für datenschutzkonforme KI-Automatisierung sind verfügbar. Der Unterschied liegt selten im einzelnen Tool, sondern im Prozessdesign, in der Architektur und in der Erfahrung mit realen Ausnahmefällen. Eine strukturierte Analyse vor der Umsetzung spart meist deutlich mehr Zeit und Risiko, als sie am Anfang kostet.

Wenn ein Unternehmen dieses Thema ernsthaft angehen will, ist professionelle Begleitung oft der kürzere Weg. Nicht weil intern Know-how fehlt, sondern weil Datenschutz, API-Architektur, Fehlerbehandlung und Betriebsmodell gemeinsam gedacht werden müssen, damit aus einem KI-Pilot ein belastbarer Geschäftsprozess wird.

Sed at tellus, pharetra lacus, aenean risus non nisl ultricies commodo diam aliquet arcu enim eu leo porttitor habitasse adipiscing porttitor varius ultricies facilisis viverra lacus neque.