Erhalte unsere neuesten Artikel und Updates bequem per E-Mail

Microsofts neues Open-Source-Embedding-Modell Harrier unterstützt über 100 Sprachen und bietet ein Kontextfenster von 32.000 Tokens, was es zum leistungsstärksten Modell seiner Klasse macht. Genau das meldet The Decoder am 7. April 2026 unter Verweis auf das Bing-Team von Microsoft. Laut Bericht wurde Harrier als Open Source veröffentlicht und ist in mehreren Varianten verfügbar. Neben einem großen Modell mit 27 Milliarden Parametern gibt es auch kleinere Versionen mit 0,6 Milliarden und 270 Millionen Parametern für schwächere Hardware. Für Unternehmen ist das keine akademische Randnotiz, sondern eine direkte Verschiebung der technischen Machbarkeitsgrenze bei Suche, Abruf und Strukturierung von Informationen.

Der zweite Punkt ist fast noch wichtiger. Harrier wurde laut The Decoder mit mehr als zwei Milliarden Trainingsbeispielen trainiert. Zusätzlich kamen synthetische Daten von GPT-5 zum Einsatz. Microsoft gibt an, dass Harrier auf dem mehrsprachigen MTEB-v2-Benchmark den ersten Platz belegt und dabei proprietäre Modelle von OpenAI und Amazon übertrifft. Wenn diese Angaben in realen Unternehmensszenarien belastbar bleiben, dann reden wir nicht über ein kleines Upgrade, sondern über eine neue Qualitätsstufe für Systeme, die Informationen finden, sortieren und in den richtigen Kontext setzen müssen.

Der dritte Punkt betrifft die strategische Richtung. Das Bing-Team plant laut The Decoder, die Technologie künftig in Bing und neue Grounding-Dienste für KI-Agenten zu integrieren. Das ist ein klares Signal. Embeddings werden nicht nur für klassische Suche relevant, sondern für agentische Systeme, die eigenständig Informationen beschaffen, Zwischenergebnisse bewerten und ihren Kontext über mehrere Schritte aktualisieren. Für den DACH-Markt, gerade für KMU und Mittelstand mit gewachsenen Datenlandschaften, ist das hochrelevant. Denn genau dort scheitern viele Automatisierungsvorhaben heute noch an verstreuten Informationen, Sprachvielfalt und unvollständigem Kontext.

Embedding-Modelle arbeiten im Hintergrund. Sie schreiben keine E-Mails, erzeugen keine Bilder und wirken deshalb auf den ersten Blick unspektakulär. In der Praxis sind sie aber oft der Teil, der darüber entscheidet, ob ein KI-System überhaupt die richtigen Informationen findet. The Decoder beschreibt Embedding-Modelle als entscheidend für das Suchen, Abrufen und Ordnen von Informationen, damit KI-Systeme korrekte Antworten liefern können. Genau hier liegt der Kern. Wenn die Informationsbasis falsch oder unvollständig ist, hilft das beste Frontend nichts.

Harrier fällt aus drei Gründen auf. Erstens die Mehrsprachigkeit mit über 100 unterstützten Sprachen. Zweitens das große Kontextfenster von 32.000 Tokens. Drittens die starke Benchmark-Leistung auf MTEB-v2. Für Unternehmen bedeutet das konzeptionell: Mehr Dokumente, längere Inhalte und mehrsprachige Daten lassen sich potenziell konsistenter in Such- und Abrufprozesse einbinden. Das ist besonders relevant für Organisationen im DACH-Raum, die mit deutschsprachigen Dokumenten, englischen Produktdaten, internationalen Lieferanteninformationen und historisch gewachsenen Dateibeständen arbeiten.

Wichtig ist aber die Einordnung jenseits der Demo. Ein starkes Embedding-Modell allein automatisiert noch keinen Prozess. Zwischen Modellqualität und produktiver Nutzung liegen Datenbereinigung, Rechtekonzepte, Fehlerbehandlung, Aktualisierungslogik und die Frage, wie Ausnahmen behandelt werden. Genau daran scheitern viele interne Versuche. Ein Proof of Concept findet vielleicht Dokumente schneller. Eine produktive Lösung muss aber auch bei tausenden Anfragen, unterschiedlichen Datenquellen und unvollständigen Eingaben stabil funktionieren. Wer das unterschätzt, baut keinen robusten Prozess, sondern nur eine beeindruckende Vorführung.

Die Veröffentlichung als Open Source unter MIT-Lizenz ist mehr als ein technisches Detail. Sie verändert die ökonomische Logik. Wenn ein leistungsstarkes Modell dieser Klasse offen verfügbar ist, sinkt die Eintrittsbarriere für Unternehmen und Umsetzungspartner deutlich. Das heißt nicht, dass die Umsetzung trivial wird. Es heißt aber, dass die Wertschöpfung sich weiter verschiebt. Weg von reinen Lizenzfragen, hin zu Prozessdesign, Integration, Governance und operativer Stabilität. Genau dort entsteht im Mittelstand der eigentliche Hebel.

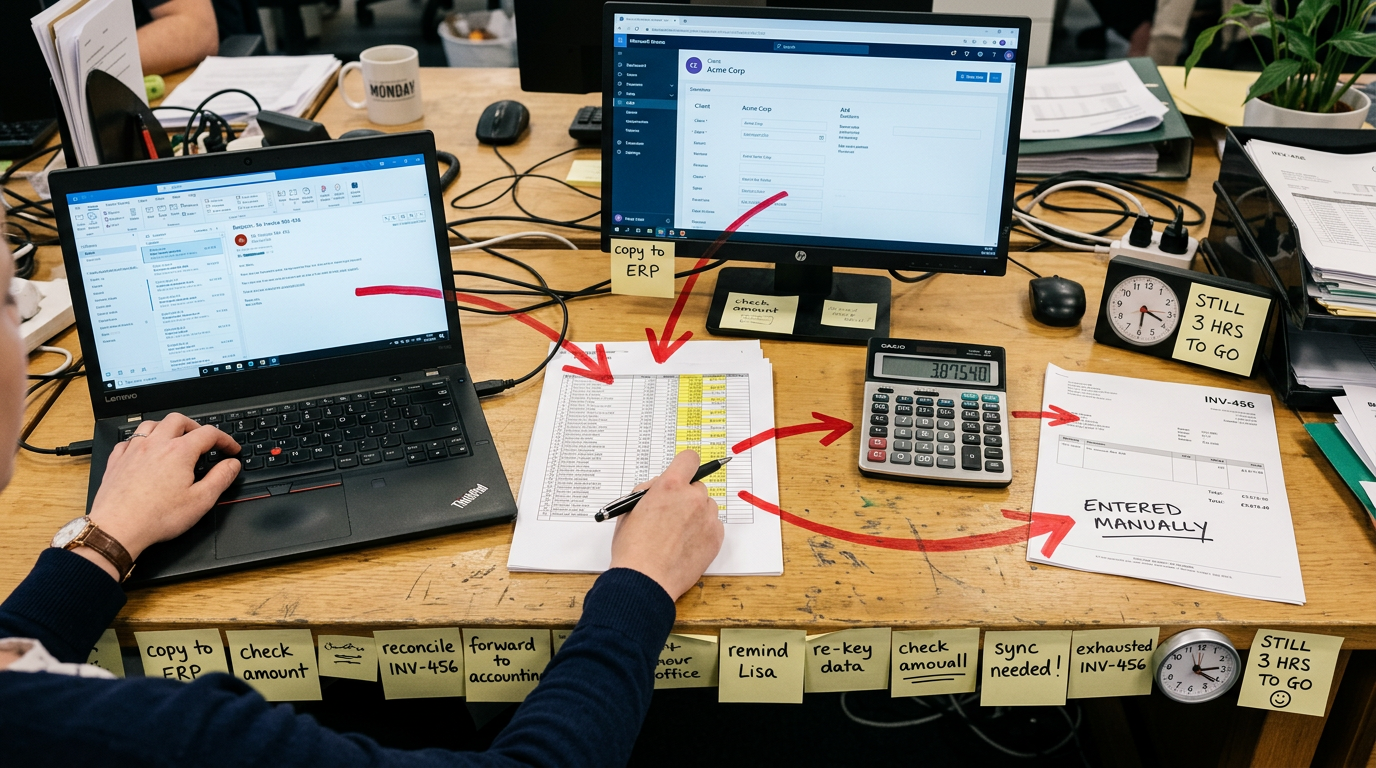

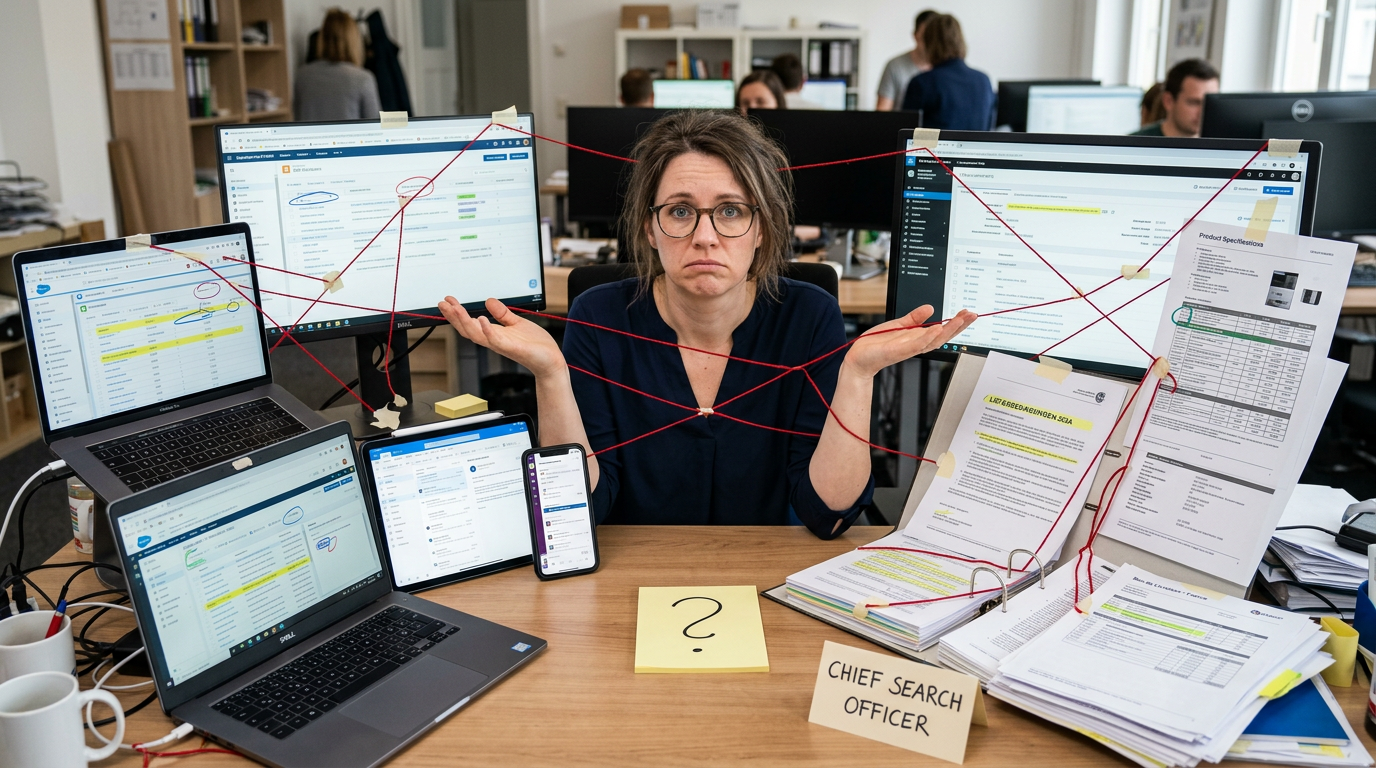

Für den DACH-Markt ist das besonders interessant. Viele Unternehmen mit 10 bis 200 Mitarbeitern haben kein Datenproblem im Sinne von zu wenig Daten. Sie haben ein Zugriffsproblem. Informationen liegen in E-Mails, PDFs, ERP-Exporten, Tickets, CRM-Notizen, Wissensdatenbanken und Freitextfeldern. Zwei bis fünf Systeme sind im Einsatz, aber sie sprechen nicht sauber miteinander. Mitarbeiter suchen, kopieren, prüfen und gleichen ab. Das kostet jede Woche Stunden, obwohl die Informationen längst vorhanden sind. KI-gestützte Datenverarbeitung wird in solchen Umgebungen dann wertvoll, wenn sie sich an bestehende Abläufe anpasst statt neue Reibung zu erzeugen.

Harrier passt in einen größeren Trend. Mit der wachsenden Bedeutung von KI-Agenten steigt der Bedarf an verlässlichem Grounding. Ein Agent, der eigenständig Informationen sucht, braucht eine belastbare Grundlage für jeden Zwischenschritt. Sonst skaliert nicht die Produktivität, sondern der Fehler. Genau deshalb ist die Nachricht relevant. Sie zeigt, dass die Basistechnologie für bessere Informationsabrufe schneller reift als viele Unternehmen ihre Prozesse anpassen. Wer heute noch mit manueller Datensuche, Copy-Paste und Einzelfallwissen arbeitet, verliert nicht nur Zeit. Er verliert Anschluss an eine neue Prozessqualität, die bereits technisch möglich ist.

Die direkte Auswirkung liegt bei Prozessen, in denen Informationen aus mehreren Quellen zusammengeführt werden müssen. Das betrifft zum Beispiel Angebotsvorbereitung, Kundenservice, Reklamationsbearbeitung, interne Wissenssuche, Dokumentenklassifikation oder die Vorprüfung von Anfragen. In all diesen Fällen hängt die Qualität des Ergebnisses davon ab, ob relevante Informationen vollständig und schnell gefunden werden. Ein stärkeres Embedding-Modell erhöht die Chance, dass genau diese Informationssuche robuster wird. Nicht nur bei klar formulierten Suchanfragen, sondern auch bei unstrukturierten Eingaben, langen Dokumenten und mehrsprachigen Inhalten.

Für Unternehmen heißt das konkret: Prozesse, die bisher an Informationsbrüchen hängen, werden eher automatisierbar. Wenn ein System Inhalte zuverlässiger findet und semantisch besser einordnen kann, lassen sich Folgeaktionen sauberer auslösen. Dann kann aus einer eingehenden Anfrage nicht nur ein Suchtreffer werden, sondern ein vollständiger Ablauf mit Priorisierung, Kontextanreicherung und Übergabe an den richtigen Bearbeitungsschritt. Das ist der Unterschied zwischen einer netten Suchfunktion und echter Prozessautomatisierung. Die Technologie wird besser. Aber der geschäftliche Nutzen entsteht erst, wenn sie in den realen Ablauf eingebettet wird.

Genau hier liegt auch die Grenze von Standardlösungen. Sie decken oft den einfachen Hauptfall ab, aber nicht die Ausnahmen. In der Praxis gibt es Sonderfälle, Freigaben, historische Datenformate, abweichende Kundengruppen und individuelle Regeln. Diese 20 Prozent machen oft 80 Prozent des Aufwands aus. Individuelle Automatisierung setzt deshalb nicht auf ein starres Schema, sondern bildet den gesamten Prozess ab, inklusive Ausnahmen und Systembrüchen. Für Unternehmen im DACH-Raum ist das entscheidend. Niemand will seine funktionierende Arbeitsweise komplett umbauen, nur damit eine Automatisierung in ein vorgegebenes Raster passt.

Wenn Ihr Team Informationen heute noch manuell zusammensucht, ist die Nachricht sofort relevant. Nehmen wir ein konservatives Beispiel. Drei Mitarbeiter verbringen jeweils nur 45 Minuten pro Arbeitstag damit, Daten aus E-Mails, Dokumenten, internen Notizen und verschiedenen Systemen zusammenzutragen. Das sind 2,25 Stunden pro Tag. Bei 20 Arbeitstagen im Monat entstehen 45 Stunden. Rechnet man mit internen Vollkosten von 45 Euro pro Stunde, liegen Sie bei 2.025 Euro pro Monat. Und das für reine Such-, Prüf- und Übergabearbeit, die keinen direkten Mehrwert schafft.

In vielen Unternehmen liegt der reale Aufwand höher. Gerade in Service, Operations, Vertrieb oder Backoffice summieren sich manuelle Zwischenschritte schnell auf 5 bis 20 Stunden pro Woche. Dann reden wir nicht mehr über ein kleines Effizienzthema, sondern über 900 bis 3.600 Euro pro Monat pro Prozessbereich. Dazu kommen Folgekosten. Bearbeitungszeiten steigen. Antworten kommen später. Fehler schleichen sich ein. Wissen bleibt an einzelne Personen gebunden. Geschäftschancen werden verpasst, weil Informationen zu spät oder gar nicht gefunden werden. Der Status quo ist nicht neutral. Er kostet jeden Monat Geld.

Die gute Nachricht ist: Diese Lücke lässt sich heute deutlich besser schließen als noch vor einem Jahr. Modelle wie Harrier zeigen, dass KI-gestützte Datenverarbeitung bei Mehrsprachigkeit, langen Kontexten und semantischer Suche einen großen Sprung macht. Die schlechte Nachricht ist: Eigenimplementierung scheitert oft an der Realität. Nicht weil die Technologie fehlt, sondern weil Prozesslogik, Datenzugriffe, Berechtigungen und Ausnahmebehandlung sauber zusammenspielen müssen. Eine Prozessanalyse klärt, wo in Ihrem Unternehmen das größte Potenzial liegt, welche Datenquellen wirklich relevant sind und welcher Ablauf sich wirtschaftlich zuerst automatisieren lässt.

Wenn Ihr Team Informationen aus mehreren Quellen zusammensucht, verlieren Sie wahrscheinlich bereits heute messbar Zeit, Marge und Reaktionsgeschwindigkeit. Eine strukturierte Prozessanalyse zeigt, wo bei Ihrer KI-gestützten Datenverarbeitung der größte Hebel liegt und welcher Ablauf sich zuerst lohnt. Jetzt Analyse anfragen →

Die Schlagzeile klingt einfach. Ein starkes Open-Source-Modell ist verfügbar. Also müsste man es nur noch anschließen und loslegen. Genau so entstehen teure Fehlstarts. Denn zwischen einem guten Modell und einem funktionierenden Unternehmensprozess liegen mehrere Ebenen, die in der Berichterstattung oft zu kurz kommen. Daten müssen erreichbar, aktuell und sinnvoll segmentiert sein. Zugriffsrechte müssen eingehalten werden. Ergebnisse müssen nachvollziehbar bleiben. Und das System muss mit unvollständigen, widersprüchlichen oder veralteten Informationen umgehen können.

Besonders kritisch wird es bei Ausnahmen. Ein Modell kann in Benchmarks hervorragend abschneiden und trotzdem im Alltag scheitern, wenn Dokumente falsch benannt sind, Felder fehlen oder mehrere Datenquellen unterschiedliche Wahrheiten liefern. Genau deshalb dauert Eigenimplementierung in Unternehmen oft drei Mal so lange wie geplant. Das Team testet an sauberen Beispieldaten, stößt dann auf reale Sonderfälle und beginnt wieder von vorn. Am Ende steht kein stabiler Prozess, sondern eine halbfertige Lösung, die intern niemand zuverlässig betreiben will. Das Problem ist selten das Modell. Das Problem ist fast immer die Prozessarchitektur.

Für KMU und Mittelstand ist deshalb ein anderer Ansatz sinnvoll. Nicht mit einem Tool starten und dann den Prozess passend machen. Sondern zuerst den bestehenden Ablauf analysieren und dann eine individuelle Automatisierung darauf aufsetzen. So bleibt die Arbeitsweise erhalten, während die manuellen Reibungsverluste verschwinden. Genau das ist im DACH-Markt oft der entscheidende Unterschied zwischen einer Lösung, die nach vier Wochen wieder abgeschaltet wird, und einer Lösung, die ab dem ersten Monat messbar Zeit spart.

Erstens wird entscheidend sein, wie gut sich Harrier außerhalb von Benchmarks in realen Unternehmensszenarien schlägt. The Decoder verweist auf die Spitzenposition im mehrsprachigen MTEB-v2-Benchmark. Das ist ein starkes Signal, aber Benchmarks sind nicht Produktion. Relevant wird, wie stabil die Qualität bei heterogenen Datenbeständen, langen Dokumenten und mehrstufigen Abrufketten bleibt. Gerade für Unternehmen mit gewachsenen Prozessen ist diese Frage wichtiger als jede Modellrangliste.

Zweitens sollte man beobachten, wie schnell die angekündigte Integration in Bing und neue Grounding-Dienste für KI-Agenten konkrete Anwendungsfälle hervorbringt. Wenn Microsoft diese Technologie breit in agentische Systeme einbettet, wird der Druck auf Unternehmen steigen, ihre Informationsprozesse sauberer zu strukturieren. Denn je leistungsfähiger die Basistechnologie wird, desto sichtbarer werden die internen Schwächen bei Datenqualität, Zuständigkeiten und Prozesslogik. Viele Unternehmen werden dann merken, dass nicht die KI ihr Engpass ist, sondern der eigene Ablauf.

Drittens wird Open Source den Markt weiter verschieben. Wenn leistungsstarke Basismodelle offen verfügbar sind, sinkt die Relevanz reiner Modellbeschaffung. Entscheidend wird, wer Prozesse so automatisieren kann, dass sie im Alltag funktionieren, inklusive Sonderfällen, Rechtekonzepten und laufender Anpassung. Für Unternehmen im DACH-Raum ist das eine Chance. Sie müssen nicht auf starre Standardprodukte setzen und auch keine überdimensionierten Transformationsprojekte starten. Sie können gezielt dort ansetzen, wo heute 5 bis 20 Stunden pro Woche in manueller Datenarbeit verschwinden, und eine individuelle Lösung auf ihre bestehenden Abläufe aufbauen.

Bevor manuelle Datensuche, lange Bearbeitungszeiten und Informationsbrüche weiter jeden Monat Kosten verursachen, lohnt sich ein klarer Blick auf den größten Hebel in Ihrem Ablauf. Eine kostenlose Prozessanalyse zeigt, wo KI-gestützte Datenverarbeitung in Ihrem Unternehmen schnell messbaren Nutzen bringt und welche Schritte sich realistisch automatisieren lassen. Kostenlose Prozessanalyse anfragen →

Sed at tellus, pharetra lacus, aenean risus non nisl ultricies commodo diam aliquet arcu enim eu leo porttitor habitasse adipiscing porttitor varius ultricies facilisis viverra lacus neque.