Erhalte unsere neuesten Artikel und Updates bequem per E-Mail

10 Stunden pro Woche für Datenerfassung, Freigaben, Rückfragen und Nachpflege klingen harmlos. Bei einem internen Vollkostenansatz von 45 Euro pro Stunde entstehen daraus 23.400 Euro pro Jahr - für einen einzigen Prozess, der keinen zusätzlichen Umsatz erzeugt. In vielen KMU und mittelständischen Unternehmen laufen jedoch nicht ein, sondern fünf bis zehn solcher Abläufe parallel. Genau deshalb sind die Kosten manueller Prozesse in Unternehmen selten ein kleines Effizienzproblem, sondern ein stiller Ergebnisfresser.

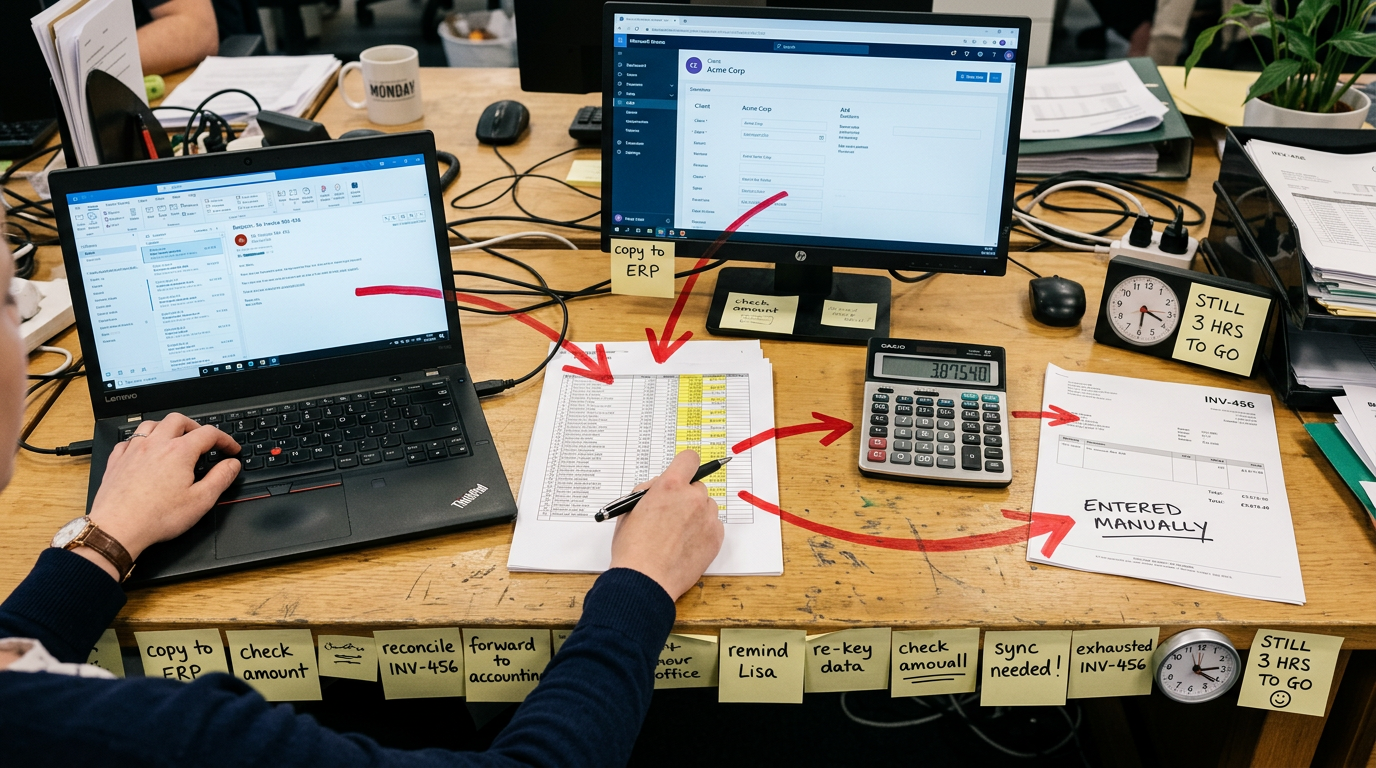

Der gefährliche Teil liegt nicht in der sichtbaren Arbeitszeit allein. Manuelle Übergaben zwischen E-Mail, ERP, CRM, Tabellen, PDF-Dokumenten und Freigaben erzeugen Wartezeiten, Fehler, Rückfragen und Medienbrüche. Diese Verluste tauchen in keiner einzelnen Kostenstelle sauber auf. Sie verteilen sich auf Sachbearbeitung, Vertrieb, Buchhaltung, Operations und Management. Am Ende fehlt nicht nur Zeit, sondern Marge, Reaktionsgeschwindigkeit und Skalierbarkeit.

Viele Beiträge zum Thema bleiben an der Oberfläche. Sie sagen, dass Automatisierung Zeit spart, Fehler reduziert und Abläufe beschleunigt. Das stimmt, hilft einem Entscheider aber nur begrenzt. Die eigentliche Frage lautet: Was kostet der Status quo in Euro, welche Prozesse verursachen den größten Schaden und warum scheitern Standardlösungen oft genau an den letzten 20 Prozent des realen Ablaufs? Erst wenn diese Fragen beantwortet sind, wird aus einem abstrakten Digitalisierungsvorhaben eine belastbare Geschäftsentscheidung.

Für Unternehmen im DACH-Raum mit 5 bis 500 Mitarbeitern ist das besonders relevant. Dort sind Prozesse meist nicht chaotisch, sondern gewachsen. Sie funktionieren irgendwie, aber sie skalieren nicht sauber. Zwei bis fünf Systeme sind im Einsatz, doch sie sprechen nur teilweise miteinander. Genau in dieser Lücke entstehen manuelle Prozesskosten, die Monat für Monat akzeptiert werden, obwohl sie sich mit einer passenden Workflow-Optimierung oft deutlich senken lassen.

Wer die betriebliche Effizienz verbessern will, sollte deshalb nicht mit Technologie beginnen, sondern mit einer ehrlichen Prozesskostenanalyse. Nicht die Frage "Was kann man automatisieren?" steht am Anfang, sondern "Wo verlieren wir heute konkret Geld?" Diese Perspektive verändert die Prioritäten. Statt überall ein bisschen zu digitalisieren, konzentriert man sich auf die wenigen Prozesse, bei denen Prozesskostenreduktion und ROI der Automatisierung am schnellsten sichtbar werden.

Die erste Standardantwort lautet oft: "Wir brauchen einfach ein besseres Tool." Das klingt logisch, greift aber zu kurz. Ein Tool kann Aufgaben strukturieren, Daten erfassen oder Freigaben abbilden. Es löst jedoch nicht automatisch die gewachsenen Sonderfälle, Ausnahmen, Verantwortungswechsel und Systembrüche, die in echten Unternehmensprozessen den größten Aufwand verursachen. Genau dort bleiben dann wieder manuelle Schritte bestehen.

Die zweite Standardantwort lautet: "Wir digitalisieren das intern Schritt für Schritt." Auch das ist nachvollziehbar, scheitert aber häufig an Kapazität und Prozessdesign. Fachabteilungen kennen ihren Alltag sehr gut, aber nicht immer die Logik einer robusten End-to-End-Automatisierung. IT-Teams können Systeme anbinden, haben jedoch selten die Zeit, jede Ausnahme, Eskalation und Fehlerbehandlung im Detail zu modellieren. Das Ergebnis sind halbfertige Lösungen, die 70 bis 80 Prozent des Prozesses abdecken und den Rest an Menschen zurückgeben.

Die dritte Standardantwort lautet: "Wir warten, bis das Thema größer wird." Genau das ist teuer. Denn manuelle Prozesskosten wachsen nicht linear, sondern oft überproportional. Mehr Aufträge bedeuten mehr Rückfragen, mehr Abstimmungen, mehr Korrekturen und mehr Koordinationsaufwand. Was bei 50 Vorgängen pro Woche noch tragbar wirkt, wird bei 200 Vorgängen zum Engpass. Unternehmen merken das meist erst dann, wenn Servicelevel sinken, Mitarbeiter überlastet sind oder Umsatz liegen bleibt.

Hinzu kommt ein Denkfehler in vielen Wirtschaftlichkeitsbetrachtungen. Es wird nur die direkte Bearbeitungszeit betrachtet, nicht aber die Opportunitätskosten. Wenn qualifizierte Mitarbeiter repetitive Aufgaben übernehmen, fehlt ihre Zeit an anderer Stelle. Vertrieb bearbeitet keine Leads, Buchhaltung klärt Ausnahmen statt Liquidität zu steuern, Operations verwaltet statt zu verbessern. Die vermeintlich kleinen manuellen Prozesskosten blockieren damit genau die Arbeit, die Wachstum ermöglicht.

Eine realistische Bewertung braucht deshalb mehr als eine grobe Schätzung. Sie braucht einen strategischen Blick auf Durchlaufzeiten, Fehlerquoten, Übergaben, Ausnahmen und Skalierung. Erst dann wird sichtbar, warum Workflow-Automatisierung nicht nur ein Effizienzthema ist, sondern ein Hebel für Marge, Geschwindigkeit und Stabilität. [INTERNAL_LINK: Prozessanalyse für KMU]

Nehmen wir einen typischen Ablauf aus dem Mittelstand: Eingehende Anfragen werden per E-Mail empfangen, manuell geprüft, in ein System übertragen, intern weitergeleitet, mit Rückfragen ergänzt und anschließend nachverfolgt. Pro Vorgang fallen im Schnitt nur 12 Minuten aktive Bearbeitung an. Bei 1.000 Vorgängen im Monat sind das 200 Stunden. Bei 45 Euro Vollkosten pro Stunde entstehen 9.000 Euro pro Monat oder 108.000 Euro pro Jahr. Und das ist nur die sichtbare Arbeitszeit.

Jetzt kommen die versteckten Kosten hinzu. Wenn bei 8 Prozent der Vorgänge Rückfragen entstehen, bei 3 Prozent Daten korrigiert werden müssen und bei 2 Prozent Fristen reißen, steigen die tatsächlichen Kosten deutlich. Denn jede Ausnahme erzeugt neue Schleifen. Ein Mitarbeiter sucht Informationen, ein anderer wartet auf Freigabe, ein Kunde fragt nach dem Status, eine Führungskraft greift ein. Aus einem scheinbar einfachen Prozess wird ein Netz aus Unterbrechungen. Genau diese Unterbrechungen machen manuelle Prozesskosten so teuer.

In einer belastbaren Prozesskostenanalyse werden deshalb mindestens fünf Kostenarten betrachtet: direkte Bearbeitungszeit, Wartezeit, Fehlerkosten, Koordinationsaufwand und Opportunitätskosten. Viele Unternehmen erfassen nur den ersten Punkt. Die anderen vier bleiben unsichtbar, obwohl sie oft höher sind als die eigentliche Bearbeitung. Wer nur auf Minuten pro Vorgang schaut, unterschätzt den Schaden systematisch.

Besonders teuer wird es, wenn manuelle Prozesse an kundenrelevanten Stellen sitzen. Dann geht es nicht mehr nur um interne Effizienzsteigerung, sondern um Conversion, Lieferfähigkeit und Kundenzufriedenheit. Eine verzögerte Angebotserstellung kostet nicht nur Arbeitszeit, sondern potenziell Aufträge. Eine langsame Freigabe im Einkauf kostet nicht nur Nerven, sondern Liefertermine. Eine manuelle Nachpflege im Service kostet nicht nur Stunden, sondern Vertrauen.

Die betriebliche Effizienz leidet außerdem doppelt. Erstens steigt der Aufwand pro Vorgang. Zweitens sinkt die Steuerbarkeit des Prozesses. Führungskräfte sehen oft nicht in Echtzeit, wo Vorgänge hängen, welche Ausnahmen zunehmen oder welche Teams überlastet sind. Ohne Transparenz wird aus Prozessmanagement reines Reagieren. Das kostet Geld, weil Probleme erst dann sichtbar werden, wenn sie bereits Auswirkungen haben.

Eine strukturierte Prozessanalyse zeigt in wenigen Stunden, welche Abläufe in Ihrem Unternehmen die höchsten versteckten Kosten verursachen und wo sich Workflow-Automatisierung am schnellsten rechnet. Statt Vermutungen erhalten Sie eine belastbare Priorisierung mit konkretem Hebel. Kostenlose Analyse anfragen →

Viele Unternehmen interpretieren manuelle Arbeit als Frage von Disziplin oder Personaleinsatz. Wenn Rückstände entstehen, wird mehr priorisiert, enger nachgehalten oder zusätzliches Personal eingeplant. Kurzfristig kann das helfen. Langfristig verschiebt es das Problem nur. Denn der Engpass liegt nicht in der Motivation der Mitarbeiter, sondern in der Struktur des Prozesses. Solange Informationen mehrfach erfasst, Entscheidungen per E-Mail getroffen und Ausnahmen außerhalb des Systems gelöst werden, bleibt der Aufwand hoch.

Das ist der Punkt, an dem Workflow-Optimierung strategisch wird. Es geht nicht darum, Menschen aus Prozessen zu entfernen. Es geht darum, wiederholbare Schritte, Datenflüsse, Prüfregeln und Übergaben so zu organisieren, dass Menschen nur dort eingreifen, wo ihr Urteil wirklich nötig ist. Dadurch sinkt nicht nur der Aufwand. Auch die Qualität steigt, weil Standards konsistent umgesetzt werden und Ausnahmen gezielt sichtbar werden.

Für Entscheider ist das wichtig, weil sich damit ein Zielkonflikt auflöst. Viele glauben, sie müssten zwischen Flexibilität und Effizienz wählen. In Wahrheit entsteht Ineffizienz oft gerade dort, wo Prozesse historisch flexibel gewachsen sind, aber nie sauber modelliert wurden. Eine gute Automatisierung zwingt Unternehmen nicht in starre Abläufe. Sie bildet den realen Prozess ab, inklusive Freigaberegeln, Sonderfällen und Eskalationen. Genau deshalb kann sie bestehende Arbeitsweisen unterstützen, statt sie zu zerstören.

Im DACH-Markt ist diese Perspektive besonders relevant. Viele KMU und mittelständische Unternehmen haben funktionierende Prozesse, die über Jahre angepasst wurden. Diese Realität passt selten in starre Standardlogiken. Wer nur auf fertige Lösungen setzt, erlebt oft das gleiche Muster: Der Standardfall funktioniert, aber die Sonderfälle laufen weiter manuell. Damit bleibt der größte Zeitfresser bestehen. Die strategische Aufgabe besteht deshalb nicht darin, irgendeine Automatisierung einzuführen, sondern die richtige Tiefe der Automatisierung zu wählen.

Eine saubere Prozesskostenreduktion beginnt also nicht mit Features, sondern mit Prozessarchitektur. Welche Daten entstehen wo? Welche Entscheidungen folgen welchen Regeln? Welche Ausnahmen treten regelmäßig auf? Welche Systeme müssen Informationen austauschen? Wer diese Fragen nicht beantwortet, baut bestenfalls Teilautomatisierung. Wer sie beantwortet, schafft die Grundlage für echte Effizienzsteigerung und einen belastbaren ROI der Automatisierung.

Versteckte Kosten entstehen selten in spektakulären Großprojekten. Sie entstehen in alltäglichen Routinen. Ein Mitarbeiter kopiert Daten aus einer E-Mail in ein System. Eine Kollegin prüft, ob Pflichtfelder vollständig sind. Ein Teamleiter gibt per Nachricht frei. Danach wird ein PDF abgelegt, eine Tabelle aktualisiert und ein Kunde informiert. Jeder einzelne Schritt wirkt klein. In Summe entsteht daraus ein Prozess, der teuer, fehleranfällig und schwer skalierbar ist.

Besonders kritisch sind vier Muster. Erstens doppelte Datenerfassung. Wenn Informationen mehrfach in verschiedene Systeme eingegeben werden, steigt nicht nur der Zeitaufwand, sondern auch die Fehlerquote. Zweitens manuelle Freigaben ohne klare Regeln. Dann entstehen Wartezeiten, Rückfragen und Intransparenz. Drittens Medienbrüche zwischen Dokumenten, E-Mails und Fachsystemen. Diese Brüche verhindern einen sauberen End-to-End-Prozess. Viertens fehlende Fehlerbehandlung. Dann werden Ausnahmen ad hoc gelöst, statt systematisch abgefangen.

Diese Muster finden sich branchenübergreifend. Im E-Commerce betrifft es Bestellungen, Retouren und Rechnungen. In Dienstleistungsunternehmen sind es Anfragen, Angebote, Onboarding und Abrechnung. In Agenturen geht es um Briefings, Freigaben und Ressourcenplanung. In der Produktion betrifft es Bestellungen, Prüfprozesse, Dokumentation und Abstimmungen mit Lieferanten. Die Branchen unterscheiden sich, die Engpässe ähneln sich. Genau deshalb ist die Frage nach den Kosten manueller Prozesse in Unternehmen so universell.

Ein weiterer Kostenblock wird oft übersehen: Managementaufwand. Je manueller ein Prozess ist, desto häufiger müssen Führungskräfte eingreifen. Sie priorisieren Vorgänge, lösen Eskalationen, klären Verantwortlichkeiten und kontrollieren Status. Diese Zeit taucht selten in der Prozessrechnung auf, obwohl sie teuer ist. Wenn hochbezahlte Entscheider operative Reibung ausgleichen, ist das ein klares Signal für strukturelle Ineffizienz.

Wer diese Kosten sichtbar macht, erkennt schnell, dass Automatisierungsvorteile weit über Zeitersparnis hinausgehen. Es geht um weniger Fehler, kürzere Durchlaufzeiten, bessere Nachvollziehbarkeit und höhere Planbarkeit. Genau diese Faktoren verbessern die betriebliche Effizienz dauerhaft. [INTERNAL_LINK: Workflow-Automatisierung im Mittelstand]

Workflow-Automatisierung ersetzt nicht einfach manuelle Arbeit durch Software. Wirtschaftlich relevant wird sie erst dann, wenn sie den gesamten Ablauf stabiler macht. Das bedeutet: Informationen werden automatisch erfasst oder übernommen, Regeln prüfen Vollständigkeit und Zuständigkeit, Vorgänge werden an die richtige Stelle geleitet, Fristen werden überwacht und Ausnahmen gezielt markiert. Menschen greifen nur noch dort ein, wo Entscheidungsspielraum oder Fachwissen erforderlich ist.

Der erste wirtschaftliche Effekt ist direkte Zeitersparnis. Wenn ein Prozess statt 12 Stunden pro Woche nur noch 20 Minuten Kontrolle benötigt, ist der Hebel sofort sichtbar. Der zweite Effekt ist Fehlervermeidung. Falsch übertragene Daten, vergessene Freigaben oder unvollständige Vorgänge verursachen Nacharbeit, Reklamationen und Verzögerungen. Der dritte Effekt ist Geschwindigkeit. Schnellere Prozesse verbessern Servicelevel, interne Abstimmung und oft auch Umsatzchancen.

Der vierte Effekt ist Skalierung ohne proportionalen Personalaufbau. Genau hier liegt für viele Unternehmen der größte Hebel. Solange Prozesse manuell wachsen, steigen Kosten mit jedem zusätzlichen Vorgang. Eine gut konzipierte Automatisierung kann Volumen deutlich besser abfangen. Das bedeutet nicht, dass kein Mensch mehr beteiligt ist. Es bedeutet, dass das Verhältnis zwischen Vorgangsmenge und Aufwand sich grundlegend verbessert.

Der fünfte Effekt ist Transparenz. Automatisierte Prozesse machen sichtbar, wo Vorgänge hängen, welche Ausnahmen auftreten und welche Bearbeitungszeiten realistisch sind. Diese Transparenz ist für die Workflow-Optimierung entscheidend, weil sie nicht nur den Ist-Zustand verbessert, sondern auch kontinuierliche Anpassungen ermöglicht. Unternehmen gewinnen damit Steuerbarkeit zurück, die in manuellen Abläufen oft verloren geht.

Genau deshalb sollte der ROI der Automatisierung nicht nur über eingesparte Stunden berechnet werden. Eine vollständige Betrachtung umfasst auch Fehlerkosten, Durchlaufzeit, Kapazitätsgewinn, bessere Conversion und geringeren Koordinationsaufwand. Erst diese Gesamtsicht zeigt, warum Automatisierungsvorteile in vielen Fällen schon ab dem ersten Monat messbar werden können.

Ein typisches Vorher-Nachher-Szenario zeigt den Unterschied deutlicher als jede Theorie. Vorher: Ein Team verarbeitet eingehende Vorgänge manuell. Daten werden aus Dokumenten übernommen, intern verteilt, geprüft, ergänzt und nachverfolgt. Der Aufwand liegt bei 12 Stunden pro Woche, dazu kommen Rückfragen, Wartezeiten und Fehlerkorrekturen. Nachher: Repetitive Schritte laufen automatisch, Zuständigkeiten werden regelbasiert zugewiesen, Pflichtangaben geprüft und Ausnahmen markiert. Der manuelle Aufwand sinkt auf 20 Minuten Kontrolle pro Woche.

Der entscheidende Punkt ist jedoch nicht nur die Zeitersparnis. Der Prozess läuft nach der Automatisierung nicht anders, sondern sauberer. Bestehende Abläufe, Freigaben und Sonderregeln bleiben erhalten. Genau das unterscheidet individuelle Automatisierung von starren Standardansätzen. Unternehmen müssen ihre Arbeitsweise nicht verbiegen, damit die Lösung funktioniert. Die Automatisierung passt sich an den realen Prozess an, inklusive Ausnahmen, Eskalationen und Systembrüchen.

Warum scheitern Fertiglösungen oft an den letzten 20 Prozent? Weil diese 20 Prozent in der Praxis die schwierigsten sind. Ein Standardfall lässt sich fast immer abbilden. Die Realität besteht aber aus Sonderfreigaben, abweichenden Datenformaten, unvollständigen Eingaben, kundenspezifischen Regeln, Teilschritten in verschiedenen Systemen und historisch gewachsenen Verantwortlichkeiten. Genau dort sitzt der größte Zeitfresser. Wenn diese Fälle manuell bleiben, bleibt auch der wirtschaftliche Schmerz.

Hinzu kommt die versteckte Komplexität im Betrieb. Was passiert bei fehlerhaften Daten? Wie werden Dubletten erkannt? Wie reagiert der Prozess auf Ausfälle eines Drittsystems? Wie werden neue Varianten integriert, wenn das Volumen steigt? Diese Fragen entscheiden darüber, ob eine Automatisierung im Alltag trägt oder nur in einer Demo gut aussieht. Eine strukturierte Prozessanalyse klärt in wenigen Stunden, wo das größte Automatisierungspotenzial liegt.

Für Unternehmen im DACH-Raum ist das ein pragmatischer Weg. Statt ein großes Transformationsprojekt zu starten, wird zuerst der Prozess mit dem höchsten wirtschaftlichen Hebel identifiziert. Dort zeigt sich schnell, ob die erwartete Prozesskostenreduktion realistisch ist. Wenn das sauber gemacht wird, entsteht nicht nur ein besserer Ablauf, sondern ein belastbares Muster für weitere Prozesse. [INTERNAL_LINK: Individuelle Prozessautomatisierung]

Auf dem Papier wirkt eine interne Umsetzung oft attraktiv. Der Prozess ist bekannt, die Systeme sind vorhanden und die Fachabteilung weiß, wo es hakt. In der Praxis unterschätzen Unternehmen jedoch regelmäßig den Aufwand für Analyse, Modellierung, Ausnahmebehandlung, Tests und laufende Betreuung. Was als kleines Automatisierungsprojekt startet, zieht sich über Monate, weil zwischen Tagesgeschäft, Abstimmungen und technischen Abhängigkeiten immer neue Fragen auftauchen.

Ein häufiger Fehler ist der Start mit dem sichtbaren Teil des Prozesses. Es wird automatisiert, was leicht zu greifen ist: Datentransfer, Benachrichtigungen, einfache Freigaben. Die schwierigen Teile werden auf später verschoben. Genau dort sitzen aber die Risiken. Wenn Sonderfälle nicht sauber behandelt werden, entstehen manuelle Umgehungslösungen. Dann muss das Team parallel mit Automatisierung und Handarbeit leben. Das erhöht Komplexität statt sie zu senken.

Ein zweiter Fehler ist fehlende Robustheit. Eine Automatisierung funktioniert im Test mit idealen Daten. Im Alltag kommen unvollständige Eingaben, doppelte Datensätze, abweichende Formate, geänderte Zuständigkeiten und unerwartete Volumina hinzu. Ohne saubere Fehlerbehandlung wird aus einem Effizienzprojekt schnell ein Störfaktor. Mitarbeiter verlieren Vertrauen, umgehen den Prozess und kehren zu manuellen Routinen zurück.

Ein dritter Fehler ist die falsche Wirtschaftlichkeitslogik. Interne Projekte werden oft als günstig bewertet, weil keine externen Rechnungen anfallen. Tatsächlich binden sie aber wertvolle Kapazität in Fachbereich und IT. Diese Kapazität fehlt für Kernthemen. Wenn sich ein Projekt über Monate zieht, steigen die Opportunitätskosten massiv. Der vermeintlich günstige Eigenweg wird dadurch oft teurer als eine professionelle Umsetzung.

Deshalb ist die Frage nicht nur, ob ein Unternehmen etwas selbst bauen kann. Die wichtigere Frage lautet, wie schnell, robust und wirtschaftlich es live geht. Wer Prozessdesign, Ausnahmebehandlung und Skalierung von Anfang an sauber denkt, spart nicht nur Zeit in der Umsetzung. Er vermeidet auch die typischen Folgekosten halbautomatisierter Prozesse.

Nicht jeder Prozess ist sofort ein guter Kandidat. Ein sinnvoller Bewertungsrahmen beginnt mit Volumen und Wiederholbarkeit. Je häufiger ein Ablauf vorkommt und je standardisierter seine Grundstruktur ist, desto größer ist meist der Hebel. Das heißt nicht, dass nur einfache Prozesse geeignet sind. Gerade komplexe Prozesse mit wiederkehrenden Mustern bieten oft hohes Potenzial, wenn die Ausnahmen sauber berücksichtigt werden.

Der zweite Faktor ist wirtschaftlicher Schaden. Hier geht es nicht nur um Bearbeitungszeit, sondern um die Gesamtkosten des Status quo. Wie hoch sind Fehlerkosten, Wartezeiten, Rückfragen und Opportunitätskosten? Welche Auswirkungen hat der Prozess auf Kunden, Umsatz oder Lieferfähigkeit? Eine gute Prozesskostenanalyse priorisiert nicht nach Bauchgefühl, sondern nach realem Verlust.

Der dritte Faktor ist Systemnähe. Prozesse mit mehreren beteiligten Systemen, Dokumenten und Kommunikationskanälen verursachen oft hohe Reibung. Genau dort entstehen Medienbrüche und manuelle Übergaben. Gleichzeitig ist dort der Nutzen einer sauberen Integration besonders hoch. Entscheidend ist jedoch, dass die Automatisierung nicht nur Daten verschiebt, sondern den realen Ablauf inklusive Regeln und Ausnahmen abbildet.

Der vierte Faktor ist Umsetzbarkeit. Manche Prozesse haben hohen Nutzen, sind aber organisatorisch oder technisch noch nicht reif. Andere lassen sich schneller realisieren und erzeugen früh sichtbare Ergebnisse. Für viele KMU ist ein gestufter Einstieg sinnvoll: zuerst ein Prozess mit klarem ROI der Automatisierung, danach schrittweise Ausbau. So entsteht Vertrauen im Unternehmen und die Workflow-Optimierung wird nicht als abstraktes Projekt, sondern als messbarer Geschäftshebel erlebt.

Wenn diese vier Faktoren zusammen betrachtet werden, entsteht eine belastbare Priorisierung. Genau das fehlt in vielen Unternehmen. Stattdessen werden Prozesse automatisiert, weil sie gerade laut sind oder weil eine Abteilung besonders engagiert ist. Strategisch sinnvoll ist jedoch die Reihenfolge, die den größten wirtschaftlichen Effekt bei vertretbarer Komplexität erzeugt.

Diese Entscheidung wird oft ideologisch geführt. Entweder man will alles intern kontrollieren oder man erwartet von externen Partnern eine Komplettlösung ohne eigene Beteiligung. Beides ist unpraktisch. Erfolgreiche Automatisierung entsteht fast immer aus einer Kombination: Das Unternehmen bringt Prozesswissen, Prioritäten und Fachlogik ein. Externe Expertise bringt Struktur, Erfahrung, Architekturdenken und die Fähigkeit, aus einem realen Prozess eine belastbare Lösung zu machen.

Für KMU und Mittelstand ist das besonders relevant. Große Beratungsansätze sind oft zu schwer, zu langsam und zu teuer. Reine Standardprodukte sind oft zu starr. Der wirtschaftlich sinnvolle Weg liegt meist dazwischen: eine individuelle Lösung, die sich an bestehende Prozesse anpasst, schnell umsetzbar ist und keine unnötige Abhängigkeit erzeugt. Genau das reduziert Risiko und beschleunigt den Nutzen.

Ein weiterer Vorteil externer Begleitung liegt in der Erfahrung mit typischen Stolpersteinen. Wer ähnliche Prozesse mehrfach umgesetzt hat, erkennt früh, wo Sonderfälle lauern, welche Freigaben kritisch sind und welche Integrationspunkte später Probleme machen. Diese Erfahrung verkürzt die Zeit bis zum produktiven Einsatz erheblich. Sie verhindert auch, dass Unternehmen erst teuer lernen müssen, warum ein scheinbar einfacher Prozess in der Realität komplex ist.

Wichtig ist dabei die richtige Erwartung. Externe Begleitung ersetzt nicht die Mitarbeit des Unternehmens. Sie macht diese Mitarbeit aber wirksamer. Statt monatelang intern zu diskutieren, wird der Prozess strukturiert analysiert, wirtschaftlich bewertet und zielgerichtet umgesetzt. Das ist kein Luxus, sondern oft der kürzere und günstigere Weg zu echter Prozesskostenreduktion.

Wer die Kosten manueller Prozesse in Unternehmen ernsthaft senken will, sollte deshalb nicht nur fragen, was technisch möglich ist. Er sollte fragen, welcher Weg am schnellsten zu einem stabilen, messbaren Ergebnis führt. In vielen Fällen ist professionelle Begleitung genau deshalb keine Zusatzkostenposition, sondern ein Beschleuniger für ROI.

Zu den versteckten Kosten zählen nicht nur Bearbeitungszeit, sondern auch Wartezeiten, Rückfragen, Fehlerkorrekturen, Koordinationsaufwand und Opportunitätskosten. Besonders teuer werden Medienbrüche zwischen Systemen, manuelle Freigaben und fehlende Transparenz über den Status von Vorgängen. Eine saubere Prozesskostenanalyse macht diese Faktoren sichtbar und zeigt, wo die größten Verluste entstehen.

Der ROI der Automatisierung ergibt sich aus dem Verhältnis zwischen Investition und eingesparten Kosten beziehungsweise zusätzlichem Nutzen. Berücksichtigt werden sollten direkte Zeitersparnis, geringere Fehlerkosten, kürzere Durchlaufzeiten, weniger Koordinationsaufwand und mögliche Umsatzwirkungen. Wer nur eingesparte Stunden betrachtet, unterschätzt den wirtschaftlichen Effekt oft deutlich.

Profitieren können nahezu alle Branchen, weil sich die Engpässe oft ähneln. Besonders hoch ist das Potenzial dort, wo wiederkehrende Abläufe, mehrere Systeme und viele Übergaben zusammenkommen, etwa in E-Commerce, Dienstleistung, Agenturen oder Produktion. Entscheidend ist weniger die Branche als die Wiederholbarkeit, Komplexität und wirtschaftliche Relevanz des Prozesses.

Geeignet sind Prozesse mit hohem Volumen, wiederkehrenden Schritten, klaren Regeln und spürbaren manuellen Prozesskosten. Zusätzlich sollte geprüft werden, wie stark Fehler, Wartezeiten und Systembrüche den Ablauf belasten. Eine strukturierte Analyse priorisiert die Prozesse, bei denen Effizienzsteigerung und Prozesskostenreduktion am schnellsten messbar werden.

Die wichtigere Frage ist meist nicht, welches Tool geeignet ist, sondern welcher Automatisierungsansatz zum realen Prozess passt. Standardlösungen decken oft nur den Hauptfall ab, während Sonderfälle und Ausnahmen manuell bleiben. Für Unternehmen mit gewachsenen Abläufen ist deshalb häufig eine individuelle Umsetzung sinnvoller, weil sie bestehende Prozesse abbildet statt sie in starre Logiken zu pressen.

Bevor manuelle Übergaben, Rückfragen und Fehler weiter Monat für Monat Marge kosten, lohnt sich ein klarer Blick auf den wirtschaftlich stärksten Hebel in Ihrem Unternehmen. Eine strukturierte Prozessanalyse zeigt, wo sich Workflow-Automatisierung für Sie am schnellsten rechnet, welche Ausnahmen berücksichtigt werden müssen und wie hoch das reale Einsparpotenzial ist. Kostenlose Prozessanalyse anfragen →

Sed at tellus, pharetra lacus, aenean risus non nisl ultricies commodo diam aliquet arcu enim eu leo porttitor habitasse adipiscing porttitor varius ultricies facilisis viverra lacus neque.