Erhalte unsere neuesten Artikel und Updates bequem per E-Mail

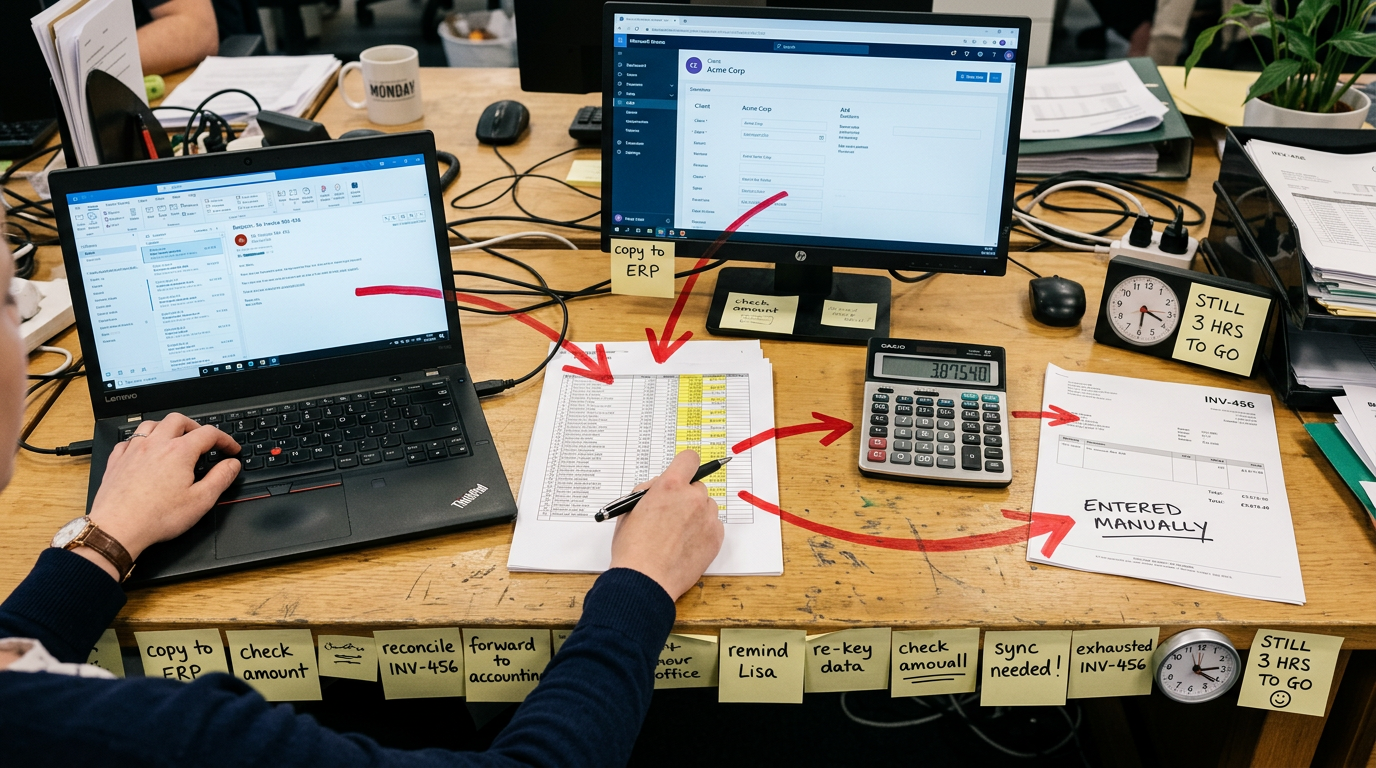

308.000 Euro direkte Personalkosten plus 57.600 Euro Fehlerkosten pro Jahr - und dazu ein Produktivitätsverlust von 15 bis 20 Prozent durch ständige Aufgabenwechsel. Diese Größenordnung entsteht bereits, wenn 20 Mitarbeiter täglich zwei Stunden mit wiederkehrender manueller Arbeit verbringen und monatlich 2.000 Datensätze mit einer Fehlerquote von 8 Prozent bearbeitet werden. Wer über Make-or-Buy-Automatisierung nachdenkt, entscheidet deshalb nicht zuerst über Technik, sondern über die Frage, wie lange dieser Abfluss an Zeit, Marge und Fokus noch akzeptabel ist.

Für viele Unternehmen wirkt der Status quo harmlos, weil die Kosten über mehrere Teams verteilt sind. Ein Teil steckt im Backoffice, ein Teil in Korrekturschleifen, ein Teil in verzögerten Freigaben und ein weiterer Teil in entgangenem Umsatz, weil Mitarbeiter ihre Zeit nicht für Vertrieb, Kundenservice oder Projektarbeit einsetzen. Auf dem Papier sieht der Prozess oft stabil aus. In der täglichen Arbeit bremst er Wachstum, bindet Liquidität und macht jede Skalierung teurer als nötig.

Die eigentliche strategische Frage lautet daher nicht nur, ob automatisiert werden soll. Sie lautet: Soll die Lösung intern aufgebaut werden, soll ein externer Partner die Umsetzung übernehmen oder ist eine Mischform wirtschaftlicher? Make-or-Buy-Automatisierung ist eine Managemententscheidung über Total Cost of Ownership, Umsetzungsgeschwindigkeit und Kontrolle über kritische Abläufe.

Wer diese Entscheidung nur nach Anschaffungskosten trifft, landet häufig in der teuersten Variante. Eine günstige Eigenentwicklung kann Monate später hohe Wartungskosten verursachen. Ein scheinbar schneller Zukauf kann an gewachsenen Freigabelogiken scheitern. Und Nichtstun bleibt fast immer die teuerste Option, weil der laufende Verlust jeden Monat weiterläuft.

In kleineren und mittleren Unternehmen entstehen Engpässe selten durch fehlende Nachfrage. Sie entstehen, weil funktionierende Prozesse nicht mitwachsen. Sobald mehrere Systeme parallel genutzt werden, Daten doppelt erfasst werden oder Freigaben per E-Mail, Excel und Telefon laufen, steigt der Aufwand nicht linear, sondern sprunghaft.

Das zeigt sich besonders deutlich in Unternehmen mit 15 bis 120 Mitarbeitern. Dort gibt es meist kein großes internes Automatisierungsteam, aber bereits genug Prozessvolumen, damit manuelle Arbeit teuer wird. Ein zusätzlicher Auftrag, ein neuer Standort oder mehr Rechnungen pro Monat erhöhen dann nicht nur die Auslastung, sondern auch die Fehleranfälligkeit.

Prozessanalyse für KMU ist in diesem Kontext kein theoretisches Thema. Es ist die Grundlage, um sichtbar zu machen, welche Abläufe sich wirtschaftlich automatisieren lassen und welche besser bewusst manuell bleiben.

Make-or-Buy-Automatisierung beschreibt die Entscheidung, ob ein Unternehmen Automatisierung intern konzipiert und entwickelt, extern einkauft oder in einer hybriden Form umsetzt. Der Kern der Entscheidung liegt in vier Dimensionen: Kosten, Tempo, Anpassungsfähigkeit und langfristige Kontrolle. Wer nur auf den Einmalpreis schaut, blendet die wirtschaftlich wichtigsten Folgen aus.

Im Alltag wird Make oft mit voller Eigenentwicklung gleichgesetzt und Buy mit dem Kauf einer Standardlösung. Diese Verkürzung führt in die Irre. Zwischen beiden Polen liegen mehrere sinnvolle Varianten, etwa externe Umsetzung auf offener Basis, interne Prozessverantwortung bei externer technischer Realisierung oder ein gestufter Aufbau mit klarer Übergabe.

Die beste Option hängt nicht davon ab, was theoretisch möglich ist. Sie hängt davon ab, wie standardisiert der Prozess ist, wie hoch die Ausnahmequote ausfällt, wie kritisch Fehler sind und wie schnell ein Ergebnis gebraucht wird. Ein Unternehmen mit stabilen Stammdaten und klaren Regeln kann intern mehr leisten als ein Unternehmen mit vielen Sonderfällen, Medienbrüchen und historisch gewachsenen Freigaben.

Entscheider unterschätzen häufig, dass Automatisierung nicht aus einzelnen Schritten besteht, sondern aus Prozessdesign, Datenlogik, Fehlerbehandlung, Monitoring und laufender Anpassung. Wer Make-or-Buy sauber bewertet, betrachtet deshalb nicht nur die Erstellung, sondern den gesamten Lebenszyklus.

In der Praxis gibt es drei belastbare Entscheidungswege. Erstens die Eigenentwicklung: Das Unternehmen baut Logik, Schnittstellen und Betrieb selbst auf. Zweitens der Zukauf einer standardisierten Lösung: Der Prozess wird an die vorhandene Produktlogik angepasst. Drittens die individuelle externe Umsetzung: Die Automatisierung wird an bestehende Abläufe angepasst, ohne dass das Unternehmen selbst ein Entwicklungsteam aufbauen muss.

Der dritte Weg wird in vielen Diskussionen übersehen, obwohl er für den Mittelstand oft wirtschaftlich am sinnvollsten ist. Er verbindet kurze Umsetzungszeiten mit hoher Passgenauigkeit und vermeidet gleichzeitig die dauerhafte Abhängigkeit von starren Lizenzmodellen. Gerade bei Prozessen mit Ausnahmen, Freigabestufen und mehreren beteiligten Systemen ist diese Zwischenform häufig der pragmatischere Weg.

Ein Rechnungsprozess kann technisch automatisierbar sein und wirtschaftlich trotzdem ungeeignet für Eigenentwicklung. Der Grund liegt in Prioritäten. Interne Teams sollen Umsatz, Kundenprojekte und Betrieb absichern. Wenn dieselben Mitarbeiter zusätzlich Prozesslogik modellieren, Schnittstellen testen und Eskalationspfade definieren sollen, verschiebt sich der Aufwand in Bereiche, die im ursprünglichen Business Case oft nicht auftauchen.

Hinzu kommt ein organisatorischer Effekt: Sobald Fachbereich, IT und Management unterschiedliche Ziele verfolgen, verlängert sich die Umsetzung. Fachbereiche wollen Entlastung, IT will Stabilität, die Geschäftsführung will schnelle Ergebnisse. Ohne klare Entscheidungsmatrix wird aus einer Automatisierung schnell ein internes Nebenprojekt mit offenem Ende.

Eine belastbare Kostenanalyse trennt direkte Personalkosten, Fehlerfolgekosten und Opportunitätskosten. Erst diese drei Ebenen zusammen zeigen, ob Make-or-Buy-Automatisierung wirtschaftlich sinnvoll ist. Wer nur Arbeitsstunden rechnet, unterschätzt den Schaden systematisch.

Für ein konservatives Beispiel nehmen wir die Werte aus den vorliegenden Benchmarks: 20 Mitarbeiter verbringen täglich zwei Stunden mit manueller Prozessarbeit. Das ergibt 8.800 Stunden pro Jahr. Bei 35 Euro internen Kosten pro Stunde entstehen 308.000 Euro direkte Kosten. Kommen monatlich 2.000 Datensätze mit 8 Prozent Fehlerquote hinzu und verursacht jeder Fehler im Schnitt 30 Euro Nacharbeit, Rückfrage oder Korrektur, entstehen weitere 57.600 Euro pro Jahr.

Damit ist die Rechnung noch nicht vollständig. Aufgabenwechsel kosten Fokus. Wenn Mitarbeiter zwischen Kernaufgabe, Datenerfassung, Rückfragen und Korrekturen springen, sinkt die tatsächliche Produktivität spürbar. Der genannte Benchmark von 15 bis 20 Prozent Produktivitätsverlust ist für viele Teams plausibler als spektakuläre Einsparversprechen, weil er den Alltag realistisch abbildet.

Für die Geschäftsführung ist vor allem relevant, dass diese Kosten jeden Monat erneut anfallen. Anders als ein Investitionsprojekt verschwinden sie nicht nach der Budgetfreigabe. Sie laufen weiter, solange der Prozess unverändert bleibt.

Dieses Modell hilft, manuelle Prozesse vor einer Make-or-Buy-Entscheidung sauber zu bewerten. Es ist einfach genug für eine erste Managemententscheidung und präzise genug, um Prioritäten zu setzen.

Gerade der dritte Hebel wird in vielen ROI-Berechnungen weggelassen. Dabei ist gebundene Liquidität in Freigabe- und Verwaltungsprozessen oft der Punkt, der aus einem kleinen Effizienzthema ein relevantes Managementthema macht.

| Kostenblock | Annahme | Jahreswert |

|---|---|---|

| Direkte Personalkosten | 8.800 Stunden x 35 Euro | 308.000 Euro |

| Fehlerfolgekosten | 2.000 Datensätze/Monat x 8 % x 30 Euro x 12 | 57.600 Euro |

| Gebundene Liquidität | Verzögerte Freigaben und langsame Durchlaufzeiten | individuell, oft fünfstellig |

| Produktivitätsverlust | 15-20 % durch Aufgabenwechsel | zusätzlicher indirekter Verlust |

Die Tabelle zeigt, warum eine reine Stundensatzrechnung zu kurz greift. Selbst wenn der direkte Aufwand noch tragbar wirkt, kippt die Wirtschaftlichkeit durch Fehler, Verzögerungen und Fokusverlust. In vielen Projekten ist nicht die Datenerfassung der teuerste Teil, sondern die Summe aus Rückfragen, Freigabestau und Nacharbeit.

Eine brauchbare ROI-Berechnung für Prozessautomatisierung beginnt nicht mit Technologie, sondern mit Prozessvolumen. Wie viele Vorgänge pro Monat? Wie viele Minuten pro Vorgang? Wie viele Rückfragen? Wie viele Freigabeschritte? Erst daraus lässt sich ableiten, ob Buy, Eigenentwicklung oder eine externe individuelle Umsetzung sinnvoll ist.

Bei Rechnungsfreigaben etwa liegen manuelle Bearbeitungskosten laut den vorliegenden Benchmarks bei 15 bis 16 Euro pro Rechnung, automatisierte Abläufe bei 2,50 bis 3,00 Euro. Die Differenz ist groß genug, um selbst bei moderatem Volumen einen klaren Business Case zu erzeugen. Entscheidend ist aber, ob der Prozess in der Realität wirklich so sauber strukturiert ist, dass diese Werte erreichbar sind.

Wer hier zu optimistisch rechnet, baut einen Business Case auf Idealannahmen. Wer konservativ rechnet, trifft bessere Entscheidungen. Deshalb lohnt es sich, mit realen Durchlaufzeiten, echten Ausnahmequoten und vorhandenen Systembrüchen zu kalkulieren statt mit Wunschwerten.

Wenn Ihr Team wiederkehrende Freigaben, Datentransfers oder Prüfungen noch manuell abarbeitet, lässt sich der monatliche Verlust meist in wenigen Kennzahlen sichtbar machen. Schon eine grobe Prozessanalyse zeigt, ob Sie eher ein kleines Optimierungsthema oder einen sechsstelligen Hebel vor sich haben.

Automatisierungspotenzial im eigenen Prozess prüfen →

Bei Make-or-Buy-Automatisierung wird vieles als KI bezeichnet, obwohl in vielen Fällen klassische Automatisierung völlig ausreicht. Der Unterschied ist wichtig, weil er Kosten, Komplexität und Erwartungshaltung direkt beeinflusst. Wer jede Prozessverbesserung als KI-Projekt plant, macht die Entscheidung unnötig teuer.

In den meisten kaufmännischen Abläufen besteht der größte Hebel aus sauberer Regelverarbeitung, verlässlicher Datenübergabe und robuster Fehlerbehandlung. KI im engeren Sinn wird erst relevant, wenn Inhalte unstrukturiert sind, Zuordnungen variieren oder Muster erkannt werden müssen, die sich nicht sinnvoll in feste Regeln übersetzen lassen.

Für eine Make-or-Buy-Entscheidung ist diese Trennung zentral. Ein Prozess, der überwiegend regelbasiert ist, kann mit deutlich geringerem Risiko umgesetzt werden als ein Prozess, der stark von lernender Logik abhängt. Das beeinflusst sowohl die Eigenentwicklung als auch den Zukauf.

OCR liest Texte aus Dokumenten aus. Das ist nützlich, aber noch keine KI im engeren Sinn. In vielen Verwaltungsprozessen reicht diese Stufe bereits aus, wenn Formate stabil sind und die benötigten Felder klar erkennbar bleiben.

Regelbasierte Automatisierung arbeitet mit festen Bedingungen, Schwellwerten und Workflows. Wenn Eingangsrechnung A von Lieferant B kommt und Betrag C unter einer Grenze liegt, folgt Freigabepfad D. Für einen großen Teil kaufmännischer Prozesse ist das der eigentliche Leistungsträger.

Hier werden Inhalte Feldern oder Kategorien zugeordnet, etwa Kostenstellen, Dokumenttypen oder Prioritäten. Diese Ebene liegt zwischen klassischer Logik und echter KI. Sie ist besonders wertvoll, wenn Dokumente ähnlich, aber nicht identisch aufgebaut sind.

Anomalieerkennung identifiziert Abweichungen von Mustern, etwa ungewöhnliche Beträge, doppelte Einreichungen oder atypische Bearbeitungszeiten. Das ist dort sinnvoll, wo Fehler teuer sind und nicht jede Abweichung vorab als Regel definiert werden kann.

Echtes Machine Learning verbessert sich mit neuen Daten. Das lohnt sich nur, wenn genügend Volumen, ausreichend Trainingsdaten und ein klarer wirtschaftlicher Nutzen vorhanden sind. Für viele mittelständische Prozesse ist der Mehrwert kleiner als vermutet. Dort bringt eine sauber gebaute klassische Prozessautomatisierung oft schneller und günstiger das bessere Ergebnis.

KI in Geschäftsprozessen hilft, diese Begriffe sauber einzuordnen. Für die Make-or-Buy-Entscheidung zählt am Ende nicht das Etikett, sondern welche Logik den Prozess zuverlässig abbildet.

Die verbreitete Kurzform lautet: Wenn Know-how intern vorhanden ist, selbst bauen. Wenn es schnell gehen muss, kaufen. Diese Logik ist zu grob. Sie ignoriert Prozessrealität, Ausnahmequoten und die Folgekosten nach dem Go-live.

Ein standardisiertes Produkt kann in einer Demo überzeugend wirken und im Alltag trotzdem scheitern, weil Freigaben nicht linear verlaufen, Daten aus mehreren Quellen kommen oder einzelne Kunden Sonderregeln haben. Umgekehrt kann eine interne Lösung fachlich gut gedacht sein und trotzdem zu langsam entstehen, weil das Team neben dem Tagesgeschäft keine stabile Umsetzungskapazität hat.

Die eigentliche Schwäche vieler Make-or-Buy-Entscheidungen liegt darin, dass sie aus Sicht der Beschaffung oder IT getroffen werden, nicht aus Sicht des Gesamtprozesses. Dann gewinnt die scheinbar günstigste Variante, obwohl sie betriebswirtschaftlich die teuerste ist.

Fertiglösungen funktionieren am besten, wenn Prozesse bereits stark vereinheitlicht sind. In vielen Unternehmen ist das nicht der Fall. Dort gibt es historische Sonderwege, unterschiedliche Freigaberegeln nach Standort, abweichende Datenformate von Kunden oder Lieferanten und manuelle Prüfschritte, die aus guten Gründen entstanden sind.

Wenn eine Standardlogik diese Realität nicht sauber abbildet, entstehen neue manuelle Inseln. Der Prozess wirkt dann digitaler, aber die entscheidenden Reibungsverluste bleiben bestehen. Besonders teuer wird das, wenn Mitarbeiter zusätzlich das System pflegen müssen, während Sonderfälle weiterhin per E-Mail oder Excel gelöst werden.

In Projekten mit hohem Belegvolumen zeigt sich oft ein unscheinbarer Effekt: Nicht die häufigen Standardfälle bremsen den Betrieb, sondern die wenigen problematischen Vorgänge, die täglich Rückfragen auslösen. Genau an diesen Stellen entscheidet sich, ob eine Automatisierung wirklich entlastet oder nur eine neue Oberfläche über alte Probleme legt.

Eigenentwicklung klingt attraktiv, weil sie maximale Kontrolle verspricht. In der Realität fehlt jedoch oft nicht die Programmierung, sondern das belastbare Prozessdesign. Welche Datenquelle ist führend? Wann wird eskaliert? Wer darf Ausnahmen freigeben? Was passiert bei widersprüchlichen Informationen? Diese Fragen kosten mehr Zeit als viele Teams anfangs annehmen.

Hinzu kommt die Wartung. Sobald sich Freigaberegeln ändern, neue Dokumenttypen auftauchen oder ein Drittsystem angepasst wird, muss die Automatisierung nachgezogen werden. Wenn das Wissen auf wenige interne Personen konzentriert ist, entsteht ein neues Betriebsrisiko. Das fällt in der ersten Wirtschaftlichkeitsrechnung selten auf, wirkt aber über Jahre.

Eigenentwicklung vs externe Automatisierung ist deshalb kein reines Kostenthema. Es geht um Umsetzungstempo, personelle Abhängigkeit und die Frage, ob das Unternehmen dauerhaft selbst Betreiber einer Prozesslösung sein will.

Eine gute Make-or-Buy-Entscheidung reduziert nicht nur Stunden. Sie verkürzt Durchlaufzeiten, senkt Fehlerkosten und entlastet Schlüsselrollen. Der Unterschied wird sichtbar, wenn man denselben Prozess vor und nach einer passenden Automatisierungsstrategie betrachtet.

Nehmen wir das oben gerechnete Beispiel mit 8.800 Stunden manueller Arbeit und 57.600 Euro Fehlerkosten pro Jahr. Wenn durch eine individuell passende Prozessautomatisierung 60 Prozent des manuellen Aufwands entfallen und die Fehlerkosten um 70 Prozent sinken, reduziert sich der direkte Aufwand auf 3.520 Stunden. Die Personalkosten fallen damit von 308.000 Euro auf 123.200 Euro. Die Fehlerkosten sinken von 57.600 Euro auf 17.280 Euro. Zusammen ergibt das eine jährliche Entlastung von 225.120 Euro - ohne den zusätzlichen Effekt aus weniger Aufgabenwechseln und schnelleren Freigaben einzurechnen.

Diese Zahlen sind bewusst konservativ. Sie setzen keine Vollautomatisierung voraus. Sie unterstellen lediglich, dass wiederkehrende Schritte, Datenübergaben und Standardprüfungen zuverlässig übernommen werden, während Sonderfälle gezielt an Menschen gehen.

Der wirtschaftliche Hebel liegt also nicht darin, jeden Einzelfall zu eliminieren. Er liegt darin, den Großteil des Volumens sauber durch den Prozess zu führen und problematische Fälle kontrolliert auszusortieren.

| Kennzahl | Vorher | Nachher |

|---|---|---|

| Manueller Aufwand | 8.800 Stunden/Jahr | 3.520 Stunden/Jahr |

| Direkte Personalkosten | 308.000 Euro | 123.200 Euro |

| Fehlerkosten | 57.600 Euro | 17.280 Euro |

| Jährliche Entlastung | - | 225.120 Euro |

Ein Handelsunternehmen mit rund 45 Mitarbeitern bearbeitete eingehende Bestellungen, Rückfragen und Freigaben über drei getrennte Systeme und mehrere Excel-Listen. Die Ausgangslage war nicht chaotisch, aber langsam. Zwei Mitarbeiter im Innendienst verbrachten einen großen Teil ihrer Woche mit Datenübertragungen, Statusabgleichen und Rückfragen an Einkauf und Buchhaltung. Der Engpass lag nicht in einem einzelnen Schritt, sondern in den Übergängen zwischen den Systemen.

Statt eine starre Standardlogik über den Prozess zu legen, wurde zuerst die tatsächliche Reihenfolge der Entscheidungen aufgenommen: Welche Informationen müssen vollständig sein, welche Abweichungen dürfen automatisch weiterlaufen und wann ist eine Eskalationslogik nötig? Danach wurden die wiederkehrenden Übergaben, Prüfungen und Benachrichtigungen automatisiert, während unklare Fälle gezielt an die zuständigen Rollen gingen.

Das Ergebnis war keine spektakuläre Vollautomatisierung, sondern eine spürbare Entlastung im Alltag. Die Bearbeitungszeit pro Vorgang sank im Mittel um knapp die Hälfte. Rückfragen gingen deutlich zurück. Auf das Jahr gerechnet wurden rund 900 Arbeitsstunden frei, und die Zahl fehlerbedingter Korrekturen sank um etwa zwei Drittel. Der wichtigste Effekt war jedoch organisatorisch: Das Team konnte steigendes Auftragsvolumen abfangen, ohne sofort zusätzliche Kapazität aufzubauen.

Eine belastbare Make-or-Buy-Entscheidung braucht ein Framework, das Prozessrealität und Wirtschaftlichkeit zusammenführt. Der 4-Stufen-Check für Automatisierbarkeit ist dafür besonders geeignet, weil er nicht nur technische Machbarkeit, sondern auch Umsetzungsrisiko sichtbar macht. So wird aus einer Bauchentscheidung eine nachvollziehbare Managemententscheidung.

Das Modell eignet sich für kaufmännische, operative und administrative Prozesse gleichermaßen. Es hilft, zwischen Eigenentwicklung, Outsourcing, standardisiertem Zukauf und individueller externer Umsetzung zu unterscheiden. Vor allem zeigt es, wann ein Prozess noch nicht reif für Automatisierung ist.

Wenn drei dieser vier Punkte kritisch sind, ist ein schneller Produktkauf selten die beste Wahl. Wenn dagegen Standardisierbarkeit und Datenqualität hoch sind und die Ausnahmequote niedrig bleibt, kann ein stärker standardisierter Ansatz wirtschaftlich sinnvoll sein.

Buy passt dort, wo Prozesse weitgehend vereinheitlicht sind, regulatorische Anforderungen klar definiert sind und die Anpassungstiefe begrenzt bleibt. Das gilt etwa für klar strukturierte Freigaben mit wenigen Varianten. In solchen Fällen kann ein externer Bezug die Time-to-Value deutlich verkürzen.

Wichtig ist jedoch, die Folgekosten sauber zu prüfen. Lizenzlogik, Volumenpreise, Anpassungsgrenzen und spätere Erweiterungen gehören in jede Kostenanalyse. Ein niedriger Einstiegspreis sagt wenig über die Kosten nach zwei Jahren aus.

Eigenentwicklung ist sinnvoll, wenn ein Unternehmen bereits belastbare interne Ressourcen für Prozessdesign, Integration und Betrieb hat und wenn der Prozess einen echten strategischen Kern darstellt. Das ist seltener der Fall, als viele annehmen. Ein internes Entwicklerteam allein reicht nicht. Es braucht auch Fachverantwortung, klare Priorisierung und Kapazität für Wartung.

Besonders geeignet ist Make bei sehr spezifischen Abläufen mit stabilen Anforderungen und langfristigem internem Ownership-Modell. Wer dagegen nur einen akuten Engpass lösen will, zahlt für diese Kontrolle oft einen unnötig hohen Preis.

Zwischen Buy und Make liegt häufig die wirtschaftlich stärkste Variante: eine passgenaue Umsetzung durch externe Spezialisten, die den bestehenden Prozess aufnehmen, anpassen und betriebsfähig machen. Dieser Weg ist vor allem dann sinnvoll, wenn das Unternehmen schnelle Ergebnisse braucht, aber seine Arbeitsweise nicht an ein starres Produkt anpassen will.

Der Vorteil liegt in der Kombination aus Tempo, Prozessverständnis und geringerer interner Belastung. Gleichzeitig bleibt die Fachlogik am tatsächlichen Ablauf orientiert. Das ist besonders wertvoll, wenn mehrere Systeme beteiligt sind und der Prozess an den Übergängen bricht.

Die größte Fehleinschätzung bei Make-or-Buy-Automatisierung betrifft nicht die Technik, sondern die Randbedingungen des Betriebs. Eine Automatisierung ist erst dann wirtschaftlich, wenn sie auch bei unvollständigen Daten, abweichenden Dokumenten, geänderten Freigaberegeln und steigenden Volumina stabil bleibt. Genau dort trennt sich ein Demo-Erfolg von einer belastbaren Lösung.

Viele Teams planen den Normalfall und merken erst später, dass der Normalfall nicht der eigentliche Kostentreiber ist. Teuer werden die Vorgänge, die hängen bleiben, falsch zugeordnet werden oder unbemerkt in einer Schleife landen. Deshalb gehören Fehlerbehandlung, Monitoring und Eskalationslogik von Anfang an in die Entscheidung.

Wer diese Punkte ignoriert, baut sich neue manuelle Arbeit auf. Dann prüft das Team nicht mehr nur Vorgänge, sondern zusätzlich die Automatisierung selbst. Das ist einer der häufigsten Gründe, warum interne Projekte ihren ROI später erreichen als geplant.

Wenn ein Datensatz unvollständig ist, ein Beleg doppelt eingeht oder ein Freigabewert nicht plausibel erscheint, braucht der Prozess eine definierte Reaktion. Ohne diese Logik entstehen stille Fehler oder unnötige Stopps. In Unternehmen mit mehreren Standorten oder Gesellschaften wird dieser Punkt besonders schnell kritisch, weil Regeln nicht überall identisch sind.

Ein belastbares Design entscheidet daher nicht nur, was automatisch weiterläuft, sondern auch, was bewusst gestoppt und an wen eskaliert wird. Diese Klarheit reduziert Fehlerreduktion nicht nur technisch, sondern organisatorisch.

Ein Prozess, der bei 300 Vorgängen im Monat noch beherrschbar wirkt, kann bei 1.500 Vorgängen kippen. Dann steigen Rückfragen, Liegezeiten und Priorisierungskonflikte. In mehreren Projekten war nicht die erste Automatisierung die Herausforderung, sondern die zweite Wachstumsstufe, wenn neue Standorte, zusätzliche Produktlinien oder mehr Kundenvarianten hinzukamen.

Deshalb sollte jede Make-or-Buy-Entscheidung die Skalierungsfrage mitdenken. Kann die Lösung mehr Volumen verarbeiten, ohne dass die Kosten proportional mitsteigen? Wenn nicht, wird aus einer kurzfristig günstigen Entscheidung später ein teurer Umbau.

Ein manuell kopierter Wert kostet vielleicht nur wenige Minuten. Der eigentliche Schaden entsteht aber durch den Kontextwechsel, die spätere Rückfrage und die fehlende Transparenz im Gesamtprozess. Besonders in Vertrieb, Einkauf, Finance und Service summieren sich diese Brüche zu einem strukturellen Effizienzverlust.

Fraunhofer weist im Kontext logistischer Informationsflüsse darauf hin, dass digitale Schnittstellen und automatisierte Datenverarbeitung manuelle Eingaben und Fehlerkorrekturen deutlich reduzieren. Dieser Gedanke lässt sich auf viele Verwaltungsprozesse übertragen: Nicht der einzelne Klick ist teuer, sondern die Kette aus Medienbruch, Verzögerung und Nacharbeit.

Die Entscheidung zwischen Eigenentwicklung, Kauf und externer Umsetzung sollte nach Time-to-Value, internem Betriebsaufwand und Anpassungstiefe getroffen werden. Wer diese drei Kriterien sauber bewertet, vermeidet die typischen Fehlentscheidungen. Ein günstiger Start ist wertlos, wenn die Lösung später nicht zum Prozess passt.

Für viele mittelständische Unternehmen ist die Frage nicht, ob intern Kompetenz vorhanden ist. Die wichtigere Frage lautet, ob diese Kompetenz in den nächsten Monaten an genau diesem Thema arbeiten kann, ohne das Kerngeschäft auszubremsen. Das verändert die Bewertung von Make or Buy erheblich.

Outsourcing wird in diesem Zusammenhang oft missverstanden. Es geht nicht darum, Verantwortung abzugeben. Es geht darum, spezialisierte Umsetzungskapazität einzukaufen, wenn dadurch schneller ein belastbares Ergebnis entsteht und die internen Teams sich auf ihr Geschäft konzentrieren können.

Wer diese drei Wege gegeneinander stellt, sollte nicht nur Implementierungskosten vergleichen. Entscheidend sind auch Anlaufzeit, interne Bindung von Schlüsselpersonen, spätere Änderbarkeit und die Frage, ob der Prozess nach der Einführung wirklich weniger manuelle Arbeit erzeugt.

Eine strukturierte Bewertung zeigt oft überraschend klar, dass die vermeintlich günstigste Lösung nur deshalb billig wirkt, weil Wartung, Anpassung und interne Koordination nicht eingerechnet wurden. Erst mit vollständiger ROI-Berechnung wird sichtbar, welche Variante wirtschaftlich trägt.

Professionelle Begleitung ist sinnvoll, wenn ein Prozess mehrere Systeme verbindet, wirtschaftlich relevant ist und nicht ohne Weiteres in eine Standardlogik passt. Dann spart externe Erfahrung nicht nur Zeit, sondern verhindert teure Fehlentscheidungen im Design. Besonders bei Make-or-Buy-Automatisierung ist dieser Punkt wichtig, weil die falsche Grundentscheidung Monate kosten kann.

Nicht jeder Prozess braucht externe Hilfe. Wenn ein Ablauf sehr klein ist, nur wenige Vorgänge pro Monat umfasst und kaum Ausnahmen kennt, kann eine interne pragmatische Lösung ausreichen. Auch bei einmaligen Sonderprojekten ohne Wiederholungscharakter lohnt sich Automatisierung oft nicht.

Anders sieht es aus, wenn 5 bis 20 Stunden pro Woche in wiederkehrende Tätigkeiten fließen, mehrere Rollen beteiligt sind und Fehler direkte Kosten oder Verzögerungen auslösen. Dann zahlt sich professionelle Begleitung häufig schon deshalb aus, weil die wirtschaftlich richtige Priorisierung schneller gefunden wird als im internen Trial-and-Error.

Der sinnvollste erste Schritt ist keine Toolentscheidung, sondern eine strukturierte Betrachtung des Prozesses: Volumen, Varianten, Ausnahmen, Systemübergänge, Freigabelogik und wirtschaftlicher Schaden. Daraus ergibt sich meist sehr klar, ob Buy, Make oder eine individuelle externe Umsetzung die bessere Wahl ist.

Die in diesem Artikel genannten Zahlen dienen der Veranschaulichung und basieren auf unterschiedlichen Grundlagen:

Die konkreten Ergebnisse hängen von der Unternehmensgröße, der Branche, den bestehenden Prozessen und der Komplexität der Sonderfälle ab. Eine strukturierte Analyse der eigenen Prozesse liefert die belastbarsten Zahlen für den individuellen Fall.

Neben Arbeitszeit entstehen oft Suchkosten, Wartezeiten zwischen Abteilungen, Rückfragen an Kunden oder Lieferanten und Kosten durch verspätete Entscheidungen. Ein zusätzlicher Punkt ist Fluktuationsrisiko: Wenn Prozesswissen nur in Köpfen einzelner Mitarbeiter steckt, wird jeder Ausfall teuer. In internen Bewertungen lohnt es sich, auch Einarbeitungszeit und Vertretungsaufwand als Kostenblock aufzunehmen.

Sie beeinflussen nicht nur das Budget, sondern auch die Kostenstruktur. Make verschiebt mehr Aufwand in interne Personalkosten und spätere Wartung, Buy verlagert Kosten stärker in laufende Gebühren und Anpassungsgrenzen. Eine hybride oder individuell externe Umsetzung kann die Anfangskosten höher wirken lassen, aber den Break-even beschleunigen, wenn dadurch monatelange interne Abstimmung entfällt.

Zusätzlich zu Kosten und Zeit sollten Unternehmen prüfen, wie oft sich der Prozess voraussichtlich ändert. Wenn Freigaberegeln, Rollen oder Datenquellen häufig angepasst werden, steigt der Wert flexibler Prozesslogik deutlich. Ebenfalls wichtig ist Governance: Wer dokumentiert Änderungen, wer testet sie und wer trägt die Verantwortung im laufenden Betrieb?

Eine feste Schwelle gibt es nicht, aber wiederkehrende Prozesse mit mindestens 200 bis 300 Vorgängen pro Monat oder 5 Stunden manueller Arbeit pro Woche sind oft prüfenswert. Entscheidend ist nicht nur das Volumen, sondern die Kombination aus Wiederholung, Fehlerkosten und Medienbrüchen. Ein kleiner Prozess mit hoher Fehlerwirkung kann wirtschaftlich relevanter sein als ein großer, aber stabiler Ablauf.

Für die meisten Entscheidungen ist ein Horizont von 24 bis 36 Monaten sinnvoll. Ein kürzerer Zeitraum unterschätzt Wartung und Änderungsbedarf, ein deutlich längerer Zeitraum wird schnell spekulativ. Wer zusätzlich mit einem konservativen, realistischen und ambitionierten Szenario rechnet, bekommt eine deutlich belastbarere Entscheidungsgrundlage.

Wenn Ihr Unternehmen heute bereits spürbar Zeit in Freigaben, Datentransfers, Rückfragen oder Korrekturen verliert, kostet Warten jeden Monat weiter Geld. Eine strukturierte Prozessanalyse zeigt schnell, wo der wirtschaftliche Hebel liegt, welche Variante zu Ihrem Ablauf passt und wie sich der ROI realistisch berechnen lässt.

Sed at tellus, pharetra lacus, aenean risus non nisl ultricies commodo diam aliquet arcu enim eu leo porttitor habitasse adipiscing porttitor varius ultricies facilisis viverra lacus neque.