Erhalte unsere neuesten Artikel und Updates bequem per E-Mail

Chinesische Open-Source-Modelle sind nicht mehr die günstige Notlösung für Bastler. DeepSeek V4 und Alibabas Qwen 3.5 erreichen in mehreren Benchmarks das Niveau westlicher Frontier-Modelle — bei einem Bruchteil der Kosten. Das verschiebt die Kalkulation für jedes Unternehmen, das KI im operativen Betrieb einsetzt.

Seit DeepSeek im Januar 2025 mit seinem R1-Reasoning-Modell die Tech-Welt erschütterte, hat sich ein klares Muster herausgebildet: Chinesische KI-Labs veröffentlichen Open-Weight-Modelle, die in der Leistung an westliche Spitzenmodelle heranreichen, aber 10- bis 20-mal weniger kosten. Und das Tempo zieht an.

DeepSeek V4 steht unmittelbar vor der Veröffentlichung – laut Financial Times geplant für Anfang März, passend zu Chinas parlamentarischen „Two Sessions“. Die Spezifikationen, soweit aus Primärquellen bekannt: ein Billionen-Parameter-Modell mit Mixture-of-Experts-Architektur, etwa 32 Milliarden aktive Parameter pro Token, natives Multimodal-Processing (Text, Bild, Video) und ein Kontextfenster von 1 Million Tokens. Parallel hat Alibaba mit Qwen 3.5 ein 397-Milliarden-Parameter-Modell unter Apache-2.0-Lizenz veröffentlicht, das 201 Sprachen unterstützt und in einigen Vision-Benchmarks GPT-5.2 übertrifft.

Der eigentliche Punkt ist nicht die Technik, sondern die Ökonomie. DeepSeeks aktuelle API-Preise liegen bei etwa 0,14 bis 0,25 USD pro Million Input-Tokens. Zum Vergleich: GPT-5.4 kostet 2,50 USD, Claude Opus 4.6 liegt bei 5 USD. Das ist ein Faktor von 10 bis 20. Ein konkretes Beispiel, das die Beratungsfirma Particula Tech dokumentiert: Ein Kunde klassifizierte und fasste täglich 50 000 Finanzdokumente zusammen – Kosten mit GPT-5 bei 4 200 USD monatlich. Dieselbe Aufgabe über DeepSeek V4 kostete 210 USD bei vergleichbarer Genauigkeit.

Drei Entwicklungen machen den Trend greifbar.

Erstens die Downloads: Auf Hugging Face hat die Qwen-Modellfamilie von Alibaba über 700 Millionen kumulative Downloads erreicht – laut heise.de die am häufigsten heruntergeladene KI-Modellfamilie weltweit, noch vor Metas Llama. Das sind keine Forschungsexperimente. Unternehmen laden diese Modelle herunter, weil die Kostenanalyse den Einsatz rechtfertigt.

Zweitens der Marktanteil: Laut einer Analyse von Particula Tech sind DeepSeek und Qwen zusammen von 1 % globalem KI-Marktanteil im Januar 2025 auf etwa 15 % im Januar 2026 gewachsen – die schnellste Adoptionskurve in der Geschichte der KI-Branche. OpenAI fiel im selben Zeitraum von 55 % auf 40 %. Diese Zahlen stammen aus einer einzelnen Quelle und sollten mit Vorsicht behandelt werden, aber die Richtung wird durch die Download-Zahlen und die öffentlich sichtbare Verbreitung bestätigt.

Drittens die Hardwareunabhängigkeit: DeepSeek V4 wurde laut Financial Times und Capacity explizit für Huawei Ascend und Cambricon-Chips optimiert – nicht für Nvidia. Das ist eine bewusste strategische Entscheidung: DeepSeek hat Nvidia und AMD den Pre-Release-Zugang verweigert. Für Unternehmen bedeutet das, dass Frontier-KI erstmals auf einem parallelen Hardware-Ökosystem läuft, unabhängig von der Nvidia-Dominanz.

Drei Faktoren treiben die Relevanz gerade jetzt.

Der erste ist regulatorisch: Die US-Exportkontrollen für KI-Chips sollten China bremsen – stattdessen haben sie die Entwicklung effizienterer Architekturen beschleunigt. DeepSeek V3 wurde für geschätzte 5,6 Millionen USD trainiert, während westliche Frontier-Modelle Hunderte Millionen kosten. Dieser Effizienzvorsprung setzt sich mit V4 fort.

Der zweite ist das Ökosystem: Open-Weight-Modelle lassen sich mittlerweile mit denselben Tools betreiben wie proprietäre APIs – vLLM, Ollama und TensorRT-LLM bieten OpenAI-kompatible Schnittstellen. Die technische Hürde, ein Open-Source-Modell in einen bestehenden Arbeitsablauf zu integrieren, ist drastisch gesunken.

Der dritte ist geopolitisch: Der Anthropic-Pentagon-Konflikt zeigt, dass die Abhängigkeit von einem einzelnen US-Anbieter zum Risiko werden kann. Europäische Unternehmen, die KI-Souveränität als strategisches Ziel haben, finden in Open-Weight-Modellen eine Alternative, die sie vollständig kontrollieren können – bis zum Air-Gapped-Betrieb auf eigener Infrastruktur, komplett ohne externe API-Aufrufe.

Die Gewinner sind klar: Unternehmen mit hohem KI-Volumen — Dokumentenverarbeitung, Code-Generierung, Klassifikation, Übersetzung — können ihre Kosten um 60 bis 70 % senken, wenn sie Routineaufgaben auf Open-Source-Modelle verlagern. Die Infrastruktur dafür existiert bereits.

Unter Druck geraten proprietäre Anbieter, die Commodity-Aufgaben zu Premium-Preisen anbieten. Wenn ein Open-Source-Modell 95 % der Leistung bei 5 % der Kosten liefert, wird der Business-Case für teure API-Abonnements bei Standardaufgaben zunehmend schwer zu rechtfertigen. OpenAI, Anthropic und Google müssen sich entweder über Qualität bei komplexen Aufgaben differenzieren – oder über das Ökosystem (Tools, Integrationen, Support).

Eine Einschränkung ist dabei nicht zu ignorieren: Chinesische Open-Source-Modelle unterliegen Zensurfiltern, die bestimmte politische Themen betreffen. heise.de und The Decoder haben wiederholt dokumentiert, dass Modelle wie DeepSeek bei Fragen zu Taiwan, Tiananmen oder Tibet staatskonforme Antworten liefern. Für rein technische Anwendungen wie Code-Generierung oder Datenverarbeitung ist das meist irrelevant. Für Unternehmen, die Modelle im Kundenkontakt oder für Content-Erstellung einsetzen, ist es ein realer Faktor, der in die Evaluierung gehört.

Zudem stehen die Distillations-Vorwürfe im Raum: Anthropic hat dokumentiert, dass chinesische Labs – darunter DeepSeek – über 24.000 betrügerische Accounts erstellt und 16 Millionen Interaktionen mit Claude durchgeführt haben, um dessen Fähigkeiten zu extrahieren. OpenAI erhebt ähnliche Vorwürfe. Das wirft Fragen zur Innovationsquelle auf, ändert aber nichts an der praktischen Verfügbarkeit der Modelle.

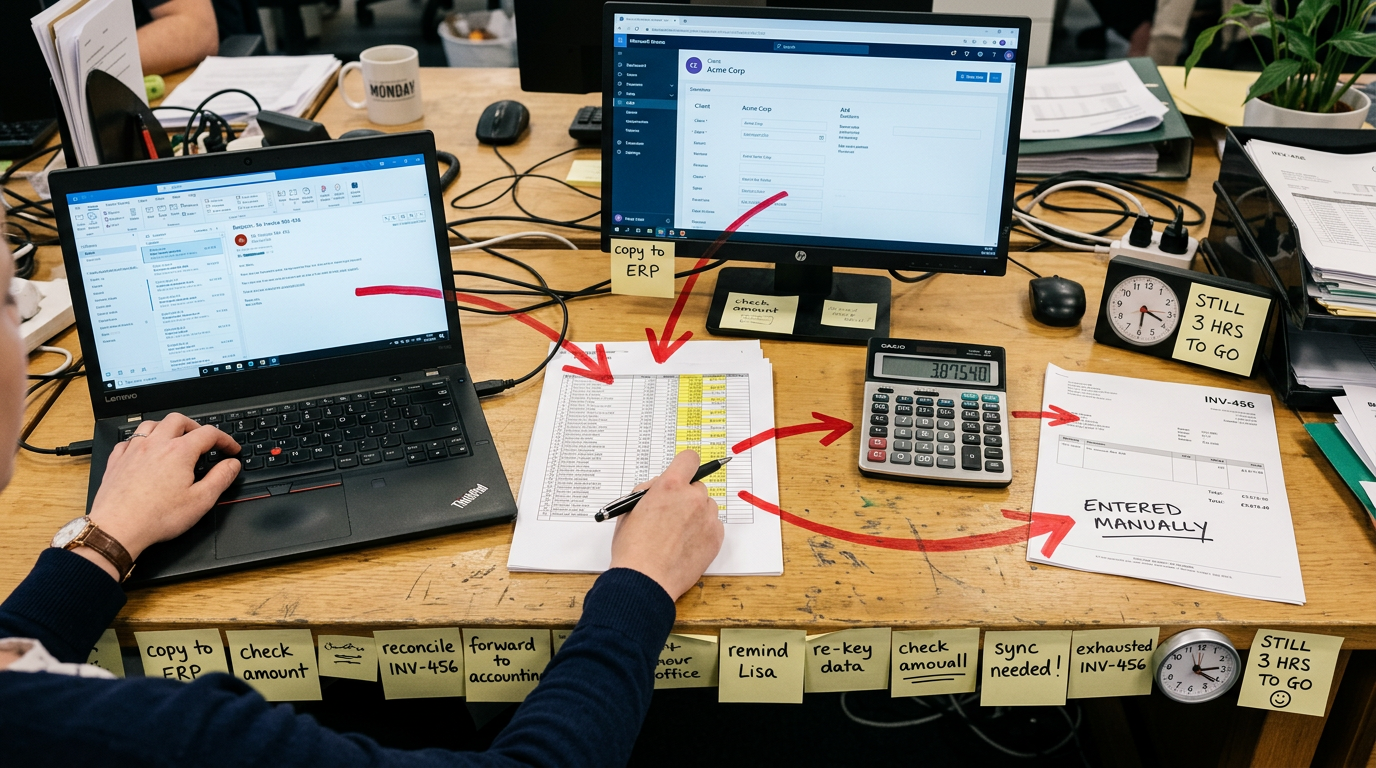

Die optimale KI-Architektur für Unternehmen im Jahr 2026 ist keine Entweder-oder-Entscheidung. Sie ist ein Routing-Layer: 80 % der Anfragen – Klassifikation, Extraktion, Zusammenfassung, Übersetzung – werden an kostengünstige Open-Weight-Modelle delegiert. Die verbleibenden 20 % – komplexes Reasoning, kreative Aufgaben, nuancierte Analyse – gehen an GPT-5.4 oder Claude Opus 4.6, wo der Qualitätsaufschlag den Preis rechtfertigt.

Konkret sollten Entscheider jetzt drei Dinge tun. Erstens: Lassen Sie Ihr Team einen direkten Vergleich zwischen Ihrem aktuellen KI-Anbieter und DeepSeek oder Qwen auf Ihren tatsächlichen Aufgaben durchführen – nicht auf Benchmarks, sondern auf Ihren echten Daten. Zweitens: Prüfen Sie, ob Ihre KI-Architektur bereits einen Model-Router unterstützt, der Anfragen je nach Komplexität und Kosten an unterschiedliche Modelle verteilen kann. Falls nicht: Bauen Sie diese Abstraktionsschicht jetzt – sie ist die wichtigste Investition in KI-Flexibilität für die kommenden Jahre. Drittens: Wenn Datensouveränität ein Thema ist – etwa im Gesundheitswesen, bei Finanzdienstleistern oder im öffentlichen Sektor –, evaluieren Sie, ob ein Open-Weight-Modell auf eigener Infrastruktur die Compliance-Anforderungen besser erfüllt als eine externe API.

Die Frage ist nicht mehr, ob Open-Source-Modelle gut genug sind. Die Frage ist, ob Ihr Unternehmen die Kostenersparnis ignorieren kann.

Sed at tellus, pharetra lacus, aenean risus non nisl ultricies commodo diam aliquet arcu enim eu leo porttitor habitasse adipiscing porttitor varius ultricies facilisis viverra lacus neque.