Erhalte unsere neuesten Artikel und Updates bequem per E-Mail

Die Pro-Human-Erklärung ist mehr als ein weiterer offener Brief aus dem KI-Umfeld. Laut TechCrunch wurde sie von Hunderten Experten, ehemaligen Beamten und öffentlichen Persönlichkeiten unterzeichnet. Das macht sie nicht automatisch zur neuen Leitlinie für Regulierung. Aber es macht sie relevant für jede Unternehmensführung, die KI nicht nur testen, sondern belastbar in Prozesse, Produkte und Entscheidungen integrieren will.

Der Kern der Erklärung ist klar. Laut TechCrunch fordert sie unter anderem ein Verbot der Entwicklung von Superintelligenz, bis ein wissenschaftlicher Konsens über deren Sicherheit besteht. Gleichzeitig formuliert sie fünf zentrale Säulen: menschliche Kontrolle, Vermeidung von Machtkonzentration, Schutz der menschlichen Erfahrung, Wahrung der individuellen Freiheit und rechtliche Verantwortlichkeit von KI-Unternehmen. Das ist keine technische Detaildebatte. Das ist ein Governance-Rahmen mit direkten Folgen für Einkauf, Produktentwicklung, Compliance und Haftung.

Für Unternehmen ist deshalb nicht die Frage entscheidend, ob jede Forderung der Erklärung politisch durchsetzbar ist. Entscheidend ist, welche Richtung sie vorgibt. Wer heute KI-Strategie plant, muss damit rechnen, dass genau diese Themen in den nächsten Quartalen stärker in Verträge, Audits, Beschaffungsvorgaben und interne Freigabeprozesse einfließen. Die Erklärung ist damit weniger ein Endpunkt als ein Frühindikator.

Die übliche Reaktion auf solche Initiativen ist vorhersehbar. Die eine Seite sagt, strengere Regeln bremsen Innovation. Die andere Seite sagt, ohne harte Regulierung drohen unkontrollierbare Risiken. Beide Positionen greifen zu kurz, weil sie Unternehmen in eine falsche Entweder-oder-Logik drängen. In der Praxis geht es nicht um Innovation oder Kontrolle, sondern um die Fähigkeit, Innovation unter kontrollierbaren Bedingungen zu skalieren.

Gerade im Management wird KI oft in zwei Schubladen sortiert. Entweder als Effizienzhebel für bestehende Workflows oder als strategische Plattform für neue Produkte und Geschäftsmodelle. Die Pro-Human-Erklärung zwingt dazu, eine dritte Dimension ernst zu nehmen: institutionelle Verantwortung. Wenn ein Modell Entscheidungen vorbereitet, Inhalte erzeugt oder mit Kunden interagiert, reicht es nicht mehr, nur auf Output-Qualität und Kosten pro Inference zu schauen. Dann zählen auch Eingriffsmöglichkeiten, Nachvollziehbarkeit, Eskalationswege und Verantwortlichkeiten.

TechCrunch ordnet die Veröffentlichung zudem in einen Moment ein, in dem die Debatte über die Kontrolle von KI-Systemen an Bedeutung gewinnt, insbesondere nach dem Konflikt zwischen dem Pentagon und Anthropic. Genau dieser Kontext ist wichtig. Die Diskussion verschiebt sich weg von abstrakten Zukunftsrisiken hin zu konkreten Fragen der Steuerbarkeit. Für Unternehmen heißt das: Wer Governance erst aufbaut, wenn Regulierer oder Großkunden sie einfordern, ist zu spät.

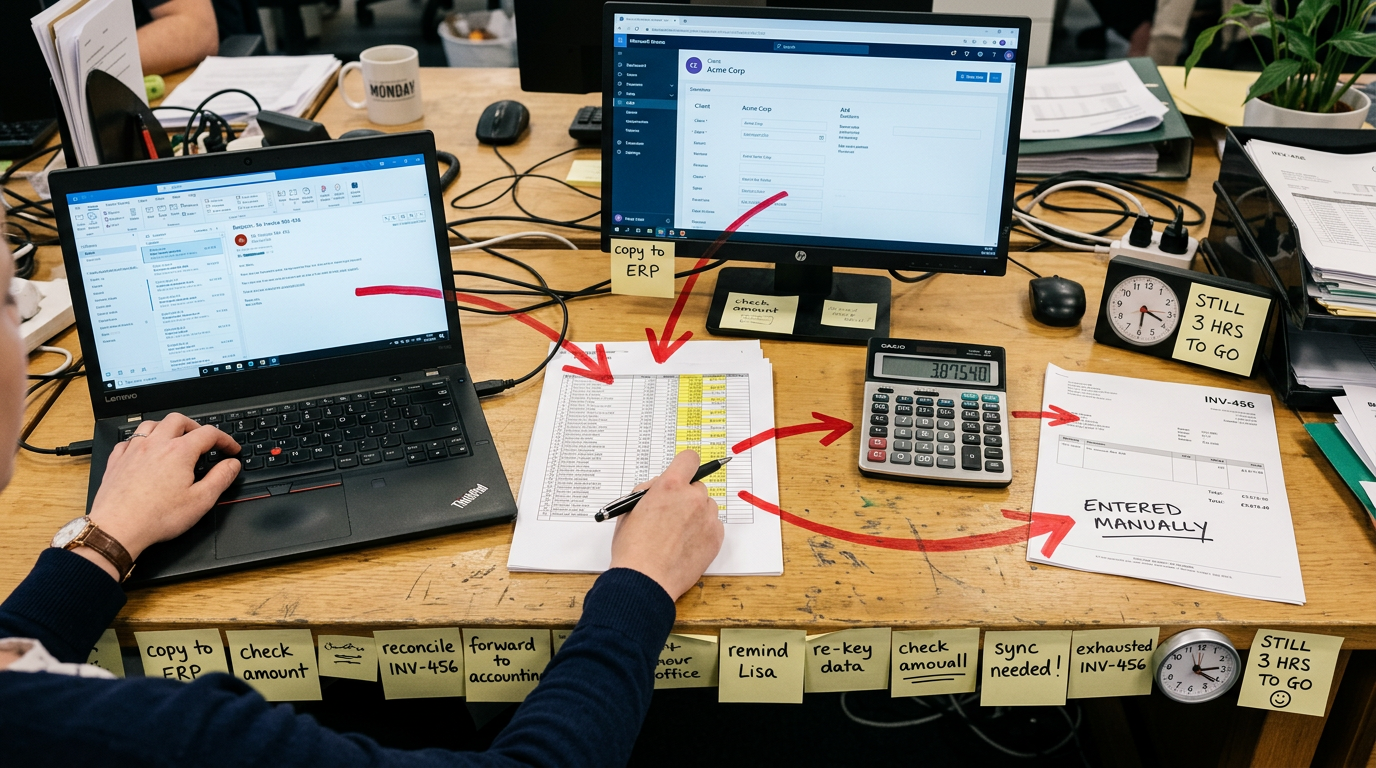

Verantwortungsvolle KI-Entwicklung klingt auf den ersten Blick konsensfähig. Kaum ein Unternehmen würde öffentlich das Gegenteil vertreten. Das Problem beginnt bei der operativen Übersetzung. Was bedeutet menschliche Kontrolle in einem Support-Workflow mit hohem Ticketvolumen? Was bedeutet individuelle Freiheit bei personalisierten Empfehlungen? Und was bedeutet rechtliche Verantwortlichkeit, wenn mehrere Anbieter in einer Modellkette beteiligt sind?

Die fünf Säulen der Pro-Human-Erklärung sind deshalb strategisch interessant, weil sie unterschiedliche Ebenen gleichzeitig adressieren. Menschliche Kontrolle betrifft Produktdesign und Prozessarchitektur. Die Vermeidung von Machtkonzentration betrifft Marktstruktur, Beschaffung und Abhängigkeiten von wenigen Foundation-Model-Anbietern. Der Schutz der menschlichen Erfahrung und der individuellen Freiheit betrifft Nutzerführung, Datenverarbeitung und Interaktionsdesign. Die rechtliche Verantwortlichkeit von KI-Unternehmen betrifft Verträge, Dokumentation und Haftungslogik.

Viele Unternehmen unterschätzen diese Mehrdimensionalität. Sie führen ein Modell ein, definieren ein paar Prompt-Regeln und ergänzen eine Richtlinie. Das reicht für einen Pilotversuch. Es reicht nicht für einen belastbaren Rollout in kritischen Prozessen. Die Pro-Human-Erklärung ist deshalb vor allem ein Hinweis darauf, dass KI-Governance nicht als Compliance-Anhang behandelt werden darf. Sie gehört in die Kernarchitektur der Umsetzung.

Aus Sicht von Risikomanagement und Unternehmenssteuerung ist die Stoßrichtung der Erklärung nachvollziehbar. Wenn Systeme leistungsfähiger werden, steigen nicht nur die Chancen, sondern auch die Kosten von Fehlentscheidungen. Das gilt besonders dort, wo KI nicht nur assistiert, sondern priorisiert, filtert, formuliert oder autonom handelt. Ein Rahmen, der menschliche Kontrolle und rechtliche Verantwortlichkeit betont, schafft hier keine Innovationsbremse, sondern Mindeststandards für Skalierung.

Besonders relevant ist der Punkt Kinder- und Jugendschutz. Laut TechCrunch ist ein zentrales Anliegen der Erklärung der Schutz von Kindern vor potenziellen Schäden durch KI-Produkte, einschließlich verpflichtender Tests vor der Markteinführung. Auch Unternehmen, die nicht direkt im Consumer-Markt aktiv sind, sollten das ernst nehmen. Denn diese Logik lässt sich leicht auf andere sensible Zielgruppen und Einsatzfelder übertragen, etwa Bildung, Gesundheit, Recruiting oder Finanzkommunikation. Wer in solchen Bereichen KI einsetzt, muss mit höheren Prüfanforderungen rechnen.

Auch die Forderung, Machtkonzentration zu vermeiden, hat eine klare betriebswirtschaftliche Seite. Abhängigkeit von wenigen Modellanbietern erhöht Preisrisiken, Verfügbarkeitsrisiken und strategische Verwundbarkeit. Wenn ein Anbieter Preise ändert, Nutzungsbedingungen verschärft oder bestimmte Funktionen einschränkt, trifft das direkt die eigene Wertschöpfung. Die Erklärung adressiert damit nicht nur gesellschaftliche Machtfragen, sondern auch ein handfestes Vendor-Risk-Thema.

Trotzdem hat die Pro-Human-Erklärung aus Unternehmenssicht eine Schwäche. Sie formuliert normative Leitplanken, aber keine operative Priorisierung. Das zeigt sich besonders bei der Forderung nach einem Verbot der Entwicklung von Superintelligenz, bis ein wissenschaftlicher Konsens über deren Sicherheit besteht. Laut TechCrunch ist das eine der zentralen Forderungen. Für politische Debatten ist das verständlich. Für Unternehmen mit aktuellen GenAI-Projekten ist es jedoch nur begrenzt handlungsleitend, weil ihre realen Risiken heute meist deutlich früher in der Wertschöpfungskette entstehen.

Die meisten Unternehmen kämpfen nicht mit Superintelligenz. Sie kämpfen mit unklaren Verantwortlichkeiten, schwachen Freigabeprozessen, fehlender Output-Kontrolle, unzureichender Dokumentation und überzogenen Erwartungen an Automatisierung. Das sind keine futuristischen Probleme. Das sind operative Probleme im Hier und Jetzt. Eine Erklärung, die vor allem auf die äußerste Spitze möglicher Systemfähigkeiten zielt, hilft nur, wenn Unternehmen sie in konkrete Governance-Fragen übersetzen.

Hinzu kommt ein zweiter Punkt. Begriffe wie Schutz der menschlichen Erfahrung oder Wahrung der individuellen Freiheit sind wichtig, aber auslegungsbedürftig. In einem Unternehmen müssen sie in überprüfbare Kriterien übersetzt werden. Sonst bleiben sie Kommunikationsformeln. Die eigentliche Managementaufgabe besteht deshalb nicht darin, die Erklärung zu bewerten, sondern sie in Entscheidungsregeln zu überführen.

Für die Praxis hilft ein einfacher Rahmen mit vier Ebenen. Erstens die Ebene Use Case. Hier klären Sie, welche Entscheidungen oder Interaktionen die KI tatsächlich beeinflusst. Zweitens die Ebene Kontrolle. Hier definieren Sie, wo ein Mensch freigibt, korrigiert oder stoppt. Drittens die Ebene Verantwortung. Hier legen Sie fest, wer fachlich, technisch und rechtlich zuständig ist. Viertens die Ebene Nachweis. Hier dokumentieren Sie, wie das System getestet, überwacht und verbessert wird.

Die fünf Säulen der Pro-Human-Erklärung lassen sich sauber auf diesen Rahmen abbilden. Menschliche Kontrolle gehört in die Kontrollarchitektur. Vermeidung von Machtkonzentration gehört in Beschaffungsstrategie und Anbieterportfolio. Schutz der menschlichen Erfahrung und individuelle Freiheit gehören in Produktdesign, Datenpolitik und UX. Rechtliche Verantwortlichkeit gehört in Verträge, Governance und Auditierbarkeit. So wird aus einer politischen Erklärung ein operatives Steuerungsmodell.

Für C-Level-Teams ist vor allem wichtig, dass diese Ebenen nicht getrennt voneinander funktionieren. Ein technisch gutes Modell ohne klare Verantwortlichkeit ist ein Governance-Risiko. Ein sauber dokumentierter Prozess ohne echte Eingriffsmöglichkeit ist nur Scheinsicherheit. Und eine gute Policy ohne belastbare Tests vor dem Rollout bleibt Papier. Genau deshalb ist die Erklärung nützlich: Sie zwingt dazu, diese Lücken sichtbar zu machen.

Erstens sollten Unternehmen ihre KI-Initiativen nach Risikoklassen sortieren. Nicht jeder Use Case braucht dieselbe Tiefe an Prüfung. Ein interner Schreibassistent ist anders zu behandeln als ein System, das Kundenkommunikation automatisiert oder Entscheidungen vorbereitet. Die Pro-Human-Erklärung liefert dafür keinen vollständigen Standard, aber sie setzt die richtigen Prioritäten: Kontrolle, Schutz, Freiheit und Verantwortung. Diese Begriffe müssen in eine eigene Risikomatrix übersetzt werden.

Zweitens sollten Sie für jeden produktiven KI-Use-Case einen klaren Human-in-the-Loop-Mechanismus definieren. Das ist keine Formalie. Es geht um die Frage, wer im Fehlerfall eingreift, wer Grenzfälle entscheidet und wo Automatisierung bewusst endet. Laut TechCrunch stellt die Erklärung menschliche Kontrolle in den Mittelpunkt. Für Unternehmen ist das der direkteste und am schnellsten umsetzbare Teil der Agenda.

Drittens sollten Sie Ihre Anbieterabhängigkeiten offenlegen. Wenn zentrale Prozesse auf einem einzelnen Modellanbieter, einer einzelnen API oder einer einzelnen Hosting-Architektur beruhen, ist das ein strategisches Risiko. Die in der Erklärung geforderte Vermeidung von Machtkonzentration ist deshalb nicht nur ein politischer Wunsch, sondern ein sinnvoller Prüfpunkt für Procurement und IT-Strategie. Wer Alternativen, Exit-Szenarien und technische Portabilität nicht mitdenkt, baut sich eine stille Abhängigkeit auf.

Viertens sollten Sie Test- und Freigabeprozesse vor dem Rollout verschärfen, vor allem bei sensiblen Zielgruppen. TechCrunch berichtet, dass die Erklärung verpflichtende Tests vor der Markteinführung fordert, insbesondere zum Schutz von Kindern. Auch wenn diese Vorgabe nicht unmittelbar für jeden B2B-Anwendungsfall gilt, ist die Logik übertragbar. Je sensibler der Kontext, desto höher muss die Testtiefe sein. Dazu gehören Red-Teaming, Fehlerszenarien, Eskalationspfade und dokumentierte Abbruchkriterien.

Fünftens sollten Sie rechtliche Verantwortlichkeit nicht an den Anbieter delegieren. Selbst wenn ein externer Modellanbieter zentrale Teile der Technologie liefert, bleibt die Verantwortung für den konkreten Einsatz im eigenen Unternehmen. Die Erklärung betont laut TechCrunch die rechtliche Verantwortlichkeit von KI-Unternehmen. Für Anwenderunternehmen bedeutet das in der Praxis: Verträge prüfen, Verantwortlichkeiten intern benennen, Entscheidungen dokumentieren und Governance nicht outsourcen.

Die Erklärung ist besonders relevant, wenn Ihr Unternehmen KI in kundennahe, markenprägende oder regulierte Prozesse einführt. Dazu zählen Kundenservice, Vertriebskommunikation, HR, Bildung, Gesundheit, Finanzprozesse und alle Anwendungen mit Minderjährigen oder anderen schutzbedürftigen Gruppen. In diesen Bereichen reichen gute Benchmarks und niedrige Kosten pro Inference nicht aus. Hier zählt, ob das System steuerbar, überprüfbar und im Fehlerfall beherrschbar bleibt.

Weniger relevant ist die Erklärung dort, wo KI klar begrenzt und intern eingesetzt wird, etwa bei unkritischen Assistenzaufgaben ohne Außenwirkung. Aber auch dann ist sie als Frühwarnsignal nützlich. Denn viele Projekte starten als interne Produktivitätshilfe und wachsen später in kritische Prozesse hinein. Wer Governance erst dann nachzieht, muss Architektur, Rollen und Freigaben oft teuer umbauen. Frühzeitige Leitplanken sind deshalb günstiger als spätere Korrekturen.

Die eigentliche Entscheidungshilfe lautet daher nicht, ob Sie die Pro-Human-Erklärung politisch unterstützen. Die wichtigere Frage ist, ob Ihre aktuelle KI-Strategie den dort benannten Prüfsteinen standhält. Können Menschen wirksam eingreifen? Vermeiden Sie unnötige Abhängigkeiten. Schützen Sie sensible Nutzergruppen. Können Sie Verantwortung klar zuordnen? Wenn Sie diese Fragen nicht sauber beantworten können, ist nicht die Erklärung Ihr Problem, sondern Ihre Governance.

Die Pro-Human-Erklärung zeigt vor allem eines: Die Debatte verschiebt sich von Modellleistung zu Steuerbarkeit und Verantwortung. Für Unternehmen ist das der richtige Moment, die eigenen Use Cases, Freigabeprozesse und Anbieterabhängigkeiten systematisch zu prüfen. Wer diese Fragen früh strukturiert angeht, verkürzt spätere Korrekturschleifen und schafft eine belastbare Grundlage für den produktiven KI-Einsatz.

Wenn Sie das Thema umsetzen wollen, ist ein sinnvoller nächster Schritt kein Grundsatzpapier, sondern ein Governance-Check der laufenden und geplanten KI-Anwendungen. Eine strukturierte Bewertung nach Risiko, menschlicher Kontrolle, Testtiefe und Verantwortlichkeit macht schnell sichtbar, wo Handlungsbedarf besteht und welche Maßnahmen zuerst Wirkung bringen.

Sed at tellus, pharetra lacus, aenean risus non nisl ultricies commodo diam aliquet arcu enim eu leo porttitor habitasse adipiscing porttitor varius ultricies facilisis viverra lacus neque.